Journal: Philosophie Jetzt – Menschenbild, ISSN 2365-5062

17.Juni 2018

URL: cognitiveagent.org

Email: info@cognitiveagent.org

Autor: Gerd Doeben-Henisch

Email: gerd@doeben-henisch.de

ÜBERSICHT

In Fortsetzung der vorausgehenden Teile 1 und 2 wird hier das Kap.4 besprochen. In ihm beschreibt Stace die Entstehung des modernen wissenschaftlichen Weltbildes am Beispiel der Astronomie. Bei genauerem Hinsehen kann man schon hier die ’Bruchstelle’ erkennen, wo heute (mehr als 60 Jahre nach Staces Buch) eine ’Wiedervereinigung’ von Wissenschaft und ’Moral’ (oder gar ’Religion’) nicht nur möglich, sondern geradezu ’notwendig’ erscheint.

I. KAPITEL 4

Entstehung der neuzeitlichen Wissenschaft

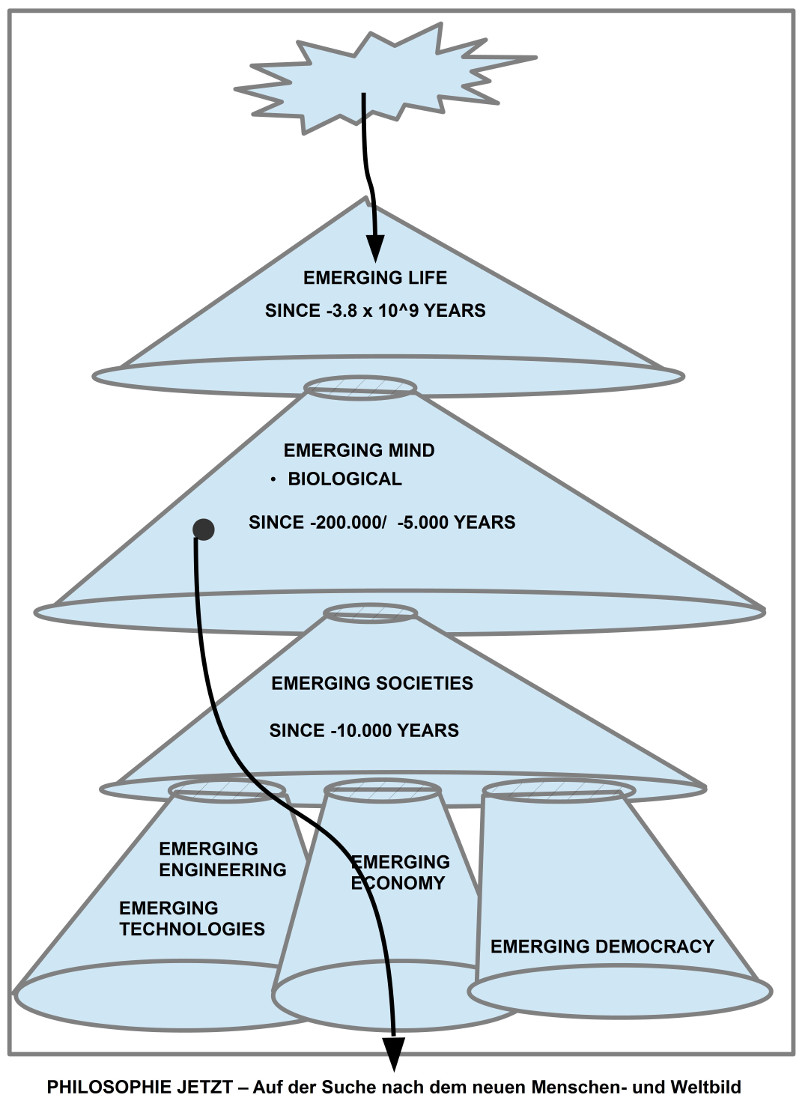

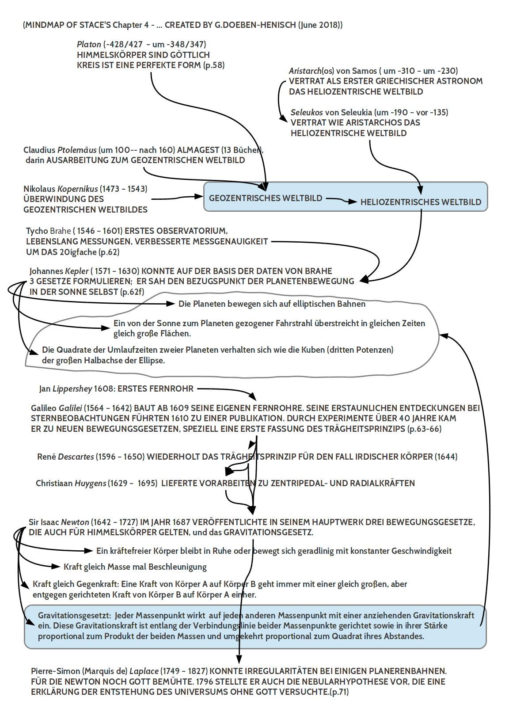

Die Entstehung der neuzeitlichen Wissenschaft ist eine langwierige und – wenn man sie voll aufschreiben wollte – eine komplexe Geschichte, die sich, je mehr man sich der Gegenwart nähert, in immer mehr Verfeinerungen aufspaltet und heute den Charakter einer ’großen Unübersichtlichkeit’ hat. Stace konzentriert sich auf ein Thema, lange Zeit das Hauptthema schlechthin, die ’Astronomie’, die Himmelskunde, und entwirft anhand der führenden Wissenschaftler dieser Zeit (15.Jh bis 20.Jh, kleine Rückblicke bis in die klassische Griechische Periode) holzschnittartig ein Bild der Entstehung des Neuen.

Ein Hauptcharakteristikum des neuen wissenschaftlichen Weltbildes ist der Übergang vom dominierenden ’geozentrischen Weltbild’ (die Erde als Mittelpunkt von allem) zum ’heliozentrischen Weltbild’ (die Erde dreht sich um die Sonne; die Sonne ist nicht mehr der einzige Bezugspunkt).

Vorgeschichten sind üblich

Für den Charakter von Weltbildern, die eine Kultur, eine ganze Epoche beherrschen, ist es bezeichnend, dass viele der wichtigen Grundüberzeugungen nicht einfach so ’vom Himmel gefallen sind’, sondern einen meist viele hundert Jahre andauernden ’Vorlauf’ haben, bisweilen tausende von Jahren. So auch im Fall der Diskussion ob ’geozentrisch’ oder ’heliozentrisch’. Schon lange vor dem Beginn der modernen Diskussion um ’geozentrisch’ oder ’heliozentrisch’, nämlich ca. 1800 Jahre (!) vor Kopernikus, gab es zwei griechische Mathematiker und Astronomen (Aristarch von Samos (um -310 bis um -230) und Seleukos von Seleukia (um -190 bis vor -135) ) die aufgrund ihrer Beobachtungen und Berechnungen ein klares heliozentrisches Weltbild vertraten. Für den damaligen ’Main Stream’ war das aber so ’unglaubwürdig’, dass Aristarch in die Rolle eines ’Ketzers’ gerückt worden sein soll, den man wegen ’Gottlosigkeit’ anklagen müsse.

Die Wiederkehr dieses Musters im Fall von Galileo Galilei und noch lange nach ihm (in manchen Teilen von religiösen Strömungen bis in die Gegenwart) mag als Indiz dafür gesehen werden, dass ’herrschende Weltanschauungen’ in ihrem eigenen Selbstverständnis, in ihrer Selbstbegründung, die Tendenz haben, sich ohne wirkliche Begründung ’absolut zu setzen’. Auf den ersten Blick erscheint solch ein Verhalten als ’Schutz der bestehenden Ordnung’, aber bei längerer Betrachtung ist dies ein gefährliches Spiel mit der Wahrheit, das eine ganze Kultur in die Irre und dann in den Abgrund führen kann. ’Sicherheit’ ist kein Ersatz für ’Freiheit’ und ’Wahrheit’.

Die Theoretiker

Bezeichnend für die Entwicklung von etwas Neuem ist auch, dass es letztlich nicht die ’Praktiker’ waren, nicht die ’Datensammler’, durch die das ’Neue’ sichtbar wurde, sondern eher die ’Theoretiker’, also jene Menschen, die über all die vielen ’Phänomene’ ’nachgedacht’ haben, nach irgendwelchen ’Regelhaftigkeiten’, ’Muster’ Ausschau gehalten haben, und die dies letztlich auch nur geschafft haben, weil sie in der Lage waren, die wichtigste Sprache der Menschheit zu benutzen, die es gibt, die Sprache der Mathematik. Kopernikus, Kepler, Galileo, Descartes, Huygens, Newton, Laplace – dies waren Menschen mit einer starken, primären Bildung in Mathematik. Ohne die mathematischen Kenntnisse hätten sie niemals die neue Sicht der Welt entwickeln können.

Andererseits, das gilt auch, ohne die Daten eines Tycho Brahe oder ohne bessere Messgeräte (z.B.Fernrohr), die Handwerker (und heute Ingenieure) bauen und gebaut haben, gäbe es auch nicht die Daten, die Fakten, anhand deren die Theoretiker jene Muster herauslesen konnten, die sie dann in der Sprache der Mathematik soweit ’idealisieren’, ’veredeln’ konnten, dass daraus die neuen unfassbaren Sichten entstanden, mit denen wir auch heute noch die Wirklichkeit um uns herum, das ’Rauschender Phänomene’ gedanklich sortieren, filtern, so neu anordnen können, dass wir darin und dadurch weitreichende Strukturen und Dynamiken erkennen können, die Jahrtausende unsichtbar waren, obwohl sie schon Milliarden Jahre da waren und wirkten.

Politisch Inkorrekt …

Während Kopernikus Zeit seines Lebens nur Ausschnitte aus seinem Hauptwerk ’De revolutionibus orbium coelestium’ veröffentlichte, da er damit rechnen konnte, von der Kirche als Ketzer angeklagt zu werden (der volle Text also erst 1543 erschien), legte sich Galileo Galilei (1564 – 1642) schon zu Lebzeiten mit den Vertretern der Kirche an und bewegte sich immer nah vor einer vollen Verurteilung als Ketzer mit dem dazugehörigen Tod durch Verbrennen.

Theoriebildung – Ein Muster

An der Theoriebildung von Galileo wird eine Eigenschaft sichtbar, die sich auch bei allen späteren wissenschaftlichen Theorien finden wird. Es ist das Moment der ’kreativen Irrationalität’, wie ich es mal nennen möchte. Dieses Moment findet sich in jeder wissenschaftlichen Theorie, und zwar notwendigerweise (Was heute gerne übersehen oder verschwiegen wird.). Seine Experimente zur Bewegung mit Körpern führten ihn zur Formulierung seines ersten Bewegungsgesetzes (das sich später auch in Newtons Hauptwerk ”Philosophiae Naturalis Principia Mathematica” als Teil seiner Mechanik findet) . Es besagt letztlich, dass kräftefreie Körper entweder in Ruhe bleiben oder sich geradlinig mit konstanter Bewegung bewegen (vgl. Stace (1952) [1]:64ff). Als ’Gesetz’ kann man diese Aussage nicht beweisen, man kann nur aufgrund von ’endlichen Daten’ eine ’Vermutung’ äußern, eine ’Hypothese’ formulieren, dass die bekannten Beispiele einen ’Wirkzusammenhang’ nahelegen, der sich eben auf die zuvor formulierte Weise beschreiben lässt. Solange dieser ’hypothetische Wirkzusammenhang’ sich im Experiment ’bestätigt’, so lange ist dieses Gesetz ’gültig’. Es kann im Laufe der Zeit aber auch durch neue, bisweilen ’feinere’ Beobachtungen, in ’Frage gestellt’ werden und dann –was oft geschehen ist – durch neue Formulierungen abgelöst werden.

Wichtig ist die grundlegende Figur, die sich hier zeigt: (i) Es gibt aktuell Phänomene (meistens aus der Vergangenheit), die man ’erklären möchte. Noch fehlen passende ’Regeln’. (ii) Aufgrund eines kreativen, irrationalen Denkprozesses entstehen ’Bilder von möglichen Mustern/ Regeln’, die mit den bekannten Phänomenen so ’passen’, dass man mit diesen Regeln das Auftreten der Phänomene so ’erklären’ kann, dass man ’zukünftige Phänomene’ voraussagen kann. (iii) Man erhebt diese kreativ gewonnenen Regeln in den Status von offiziellen ’Arbeitshypothesen’. (iv) Man macht Experimente mit diesen Arbeitshypothesen und ’überprüft’, ob die Arbeitshypothesen auch bei neuen, zukünftigen Phänomenen ’gültig’ bleiben. (v) Solange sich keine’ widersprüchlichen Befunde’ ergeben, gelten die Arbeitshypothesen als akzeptierte Regel.

Kreativität ist Fundamental – Logik Sekundär

Anders formuliert, mittels eines ’kreativen irrationalen’ Denkprozesses gewinnt man aus gegebenen Phänomenen ’induktiv’/ ’bottom-up’ mögliche ’erklärende Hypothesen’. Sofern man diese hat, kann man ’deduktiv’/ ’top-down’ gezielt Experimente durchführen, um die ’Gültigkeit’ dieser Arbeitshypothese zu überprüfen. Arbeitshypothesen kann man aber ’nicht logisch beweisen’, da dies voraussetzen würde, dass man über eine noch ’allgemeinere’ Hypothese verfügt, aus der man eine ’speziellere’ Hypothese ableiten kann (So hat sich gezeigt, dass man z.B. die drei Planetengesetze von Kepler durch das spätere Gravitationsgesetz von Newton

als ’Spezialfall’ ’ableiten’ kann). Das menschliche Gehirn verfügt aber als solches nicht ’von vornherein’ (nicht ’a priori’) über irgendwelche allgemeinen Gesetze. Das Gehirn scheint aber sehr wohl in der Lage zu sein, anscheinend beliebig viele (genauer Umfang ist unbekannt) ’Regelmäßigkeiten’, sofern sie sich anhand von Phänomenen zeigen, zu erkennen und weiter zu ’verallgemeinern’. Die Geschichte zeigt, dass das ’Zusammenwirken’ von vielen Gehirnen einerseits den einzelnen bei weitem übertreffen kann, ohne allerdings — andererseits — die kreativ-irrationale Kraft des einzelnen dadurch zu ersetzen. Es bleibt immer ein spannungsvolles Wechselspiel von individueller Kreativität und kulturellem Main-Stream. Individuelle Abweichungen werden eher nicht toleriert, werden eher an die Seite gedrückt. Der ’aktuelle’ Erfolg wirkt stärker als der ’vermeintliche’. Insofern sind Kulturen große ’Echokammern’, die beständig in Gefahr sind, sich selbst zu lähmen.

Entzauberung – Entmystifizierung

Kopernikus, Galileos Fernrohr und Bewegungsgesetze, Keplers Planetengesetze, Newtons Mechanik samt dem Gravitationsgesetz, dies alles verhalf dem Denken durch neue Erklärungsmuster und unter Einsatz der mathematischen Sprache, zu einer Sicht der Dinge, die ein direktes Eingreifen ’anderer Mächte’ oder ’Gottes’ überflüssig erscheinen liesen. Im Fall von Newton ist aber zu beobachten, dass er trotz so großartiger Erklärungserfolge ’in seinem Innern’ noch eine Vorstellung von ’Gott’ hatte, die ihn dazu verleitete, einige Unregelmäßigkeiten bei den Planetenbahnen, die er nicht mit seinen Formeln erklären konnte, dann doch einem ’direkten Wirken Gottes’ zuzuschreiben. (vgl. Stace (1952) [1]:69ff) Es war dann Laplace, der die Unregelmäßigkeiten mathematisch einordnen konnte und der mit einer eigenen Theorie zur Entstehung der Sterne (bekannt als ’Nebularhypothese’) sogar meinte, er habe damit die Annahme Gottes als notwendiger erster Ursache ’erledigt’.

QUELLEN

[1] W. Stace, Religion and the Modern Mind, 1st ed. Westport (Connecticut): Greenwood Press, Publishers, 1952, reprint 1980

from Lippincott and Crowell, Publishers.

Eine Fortsetzung findet sich HIER.

KONTEXT BLOG

Einen Überblick über alle Blogeinträge von Autor cagent nach Titeln findet sich HIER.

Einen Überblick über alle Themenbereiche des Blogs findet sich HIER.

Das aktuelle Publikationsinteresse des Blogs findet sich HIER