VORGESCHICHTE

1. In einem ersten Beitrag AVICENNAS ABHANDLUNG ZUR LOGIK – Teil 1 hatte ich geschildert, wie ich zur Lektüre des Textes von Avicenna gekommen bin und wie der Text grob einzuordnen ist.

2. In einem zweiten Beitrag AVICENNAS ABHANDLUNG ZUR LOGIK – Teil 2 ging es um die Frage, warum überhaupt Logik? Avicenna führt erste Unterscheidungen zu verschiedenen Wissensformen ein, lässt aber alle Detailfragen noch weitgehend im Dunkeln.

In diesem Teil geht es jetzt um einfache und zusammengesetzte Begriffe.

AUSDRÜCKE: EINFACH UND ZUSAMMENGESETZT

3. In Weiterführung seiner Redeweise von sprachlich vermitteltem Wissen $latex K_{m}$ verstanden als ein Paar bestehend aus einem Bündel von sinnlichen Eindrücken $latex k \subseteq K_{s}$ einerseits und einem Ausdruck $latex e \in E, E \subseteq K_{s}$ andererseits, also m(k,e), führt er jetzt die Unterscheidung von ‚einfachen‘ und ‚zusammengesetzten‘ Ausdrücken ein. Der Ausdruck ‚einfach‘ bezieht sich dabei auf die Menge der ‚Bedeutungsbeziehungen‘, in denen ein Ausdruck e vorkommt. Kommt der Ausdruck e nur in einer Bedeutungsbeziehung vor, also m(k,e), dann ist er einfach. Kann man aber einen Ausdruck e zerlegen, so dass einzelnen Teilen $latex e_{i}$ jeweils eine eigene Bedeutungsbeziehung zugewiesen werden kann, dann ist er ‚zusammengesetzt‘, also etwa $latex e = \langle e_{1}, …, e_{n} \rangle$ mit $latex m_{1}(k_{1}, e_{1}), … m_{n}(k_{n}, e_{n})$.

EINFACHE AUSDRÜCKE: INDIVIDUELL ODER UNIVERSELL

4. Avicenna führt dann noch die weitere Unterscheidung ein, dass ‚einfache Ausdrücke‘ entweder ‚individuell‘ sein können oder ‚universell‘.

5. Er motiviert diese neuen Begriffe so, dass er sagt, dass ein einfacher Ausdruck e mit m(k,e) nur eine einzige Entität (‚entity‘) bezeichne, wohingegen ein einfacher Ausdruck m(k*,e), der als ‚universell‘ gilt, mit seiner Bedeutungskomponente ‚k*‘ viele Entitäten (‚many entities‘) bezeichne.

DISKUSSION

6. So einfach diese neuen Begriffe ‚einfach/ zusammengesetzt‘ sowie bei ‚einfach zusätzlich ‚individuell/ universell‘ klingen, so stehen sie für ein Geflecht von Problemen, das dies heute nicht als gelöst gelten kann.

7. Wie schon in der Diskussion von Teil 2 deutlich wurde, setzt die Diskussion der Unterscheidung der verschiedenen Wissensformen einen begrifflichen Rahmen voraus, der letztlich auf generelle Annahmen zum erkennen Subjekt hinausläuft, wie es etwa im Rahmen einer Erkenntnistheorie geleistet werden könnte, also ein abstraktes Modell eines erkennenden Subjektes, das den formalen Rahmen liefert, innerhalb dessen dann über spezielle Sachverhalte wie ’sprachliches‘ oder ‚logisches‘ Wissen gesprochen werden kann.

8. Schon die Einführung der Unterscheidung von sprachlichen Ausdrücken $latex E \subseteq K_{s}$, die in einer ‚Bedeutungsbeziehung‘ M zu anderen sinnlichen Ereignissen $latex K_{s} \subseteq K$ stehen, können als $latex M \subseteq K_{s} \times E$, wirft eigentlich zusätzliche Fragen auf, die bislang von Avicenna nicht geklärt wurden.

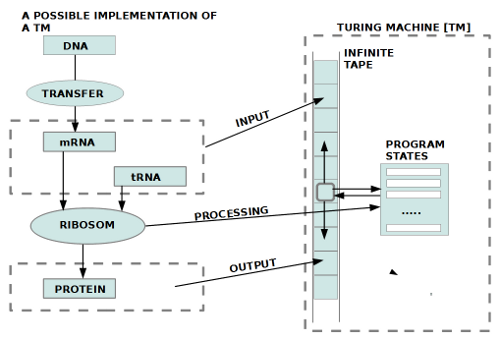

9. Nun zu sagen, dass ein einfacher Ausdruck e in genau einer Bedeutungsbeziehung m stehe, und die darin vorkommenden sinnlichen Ereignisse k genau ‚eine Entität‘ bezeichnen, legt die Vorstellung nahe, dass bestimmten Mustern sinnlicher Ereignisse k etwas ‚Abstrakteres‘ korrespondiert, nämlich ein ‚Objekt‘ o mit $latex o \in O$. Daraus würde folgen, dass die Bedeutungsbeziehung möglicherweise nicht direkt auf Muster k von sinnlichen Ereignissen abzielt, sondern auf abstrakte Objekte O, die aus den sinnlichen Mustern k durch einen Abstraktionsprozess $latex \alpha$ erzeugt werden; also $latex \alpha: KS \longrightarrow O$ und $latex M \subseteq O \times E$.

10. Nimmt man diese Interpretation an, dann ließe sich der Fall von ‚einfachen‘ Ausdrücken, die bedeutungsmäßig ‚universell‘ sind, so rekonstruieren, dass sich im Bereich der abstrakten Objekte O mehr als eine ‚Abstraktionsebene‘ denken lässt. Analog der Whitehead-Russelschen Typentheorie aus den Principia Mathematica gibt es dann Abstraktionsebenen von 1 bis n, und ein Objekt auf der Ebene j könnte alle Objekte von Abstraktionsebenen ‚kleiner als j‘ als ‚Instanzen‘ haben.

11. Dazu müsste man die Abstraktionsfunktion ein wenig verallgemeinern zu $latex \alpha: KS \cup O \longrightarrow O$, und man müsste sich noch die Hierarchie der Ebenen ‚dazudenken‘.

12. Beispiel: auf dem Tisch stehen verschiedene konkrete, einzelne Tassen $latex \{ t_{1}, …, t_{r} \}$; diese repräsentieren einzelne Entitäten (Ebene 1). Dazu gibt es den abstrakteren Begriff ‚Tasse‘ auf einer Ebenen 2. Auf dem Tisch befinden sich aber auch noch andere Gegenstände, z.B. ‚Teller‘, ‚Bestecke‘ usw. Die Begriffe ‚Teller‘ und ‚Besteck‘ bezeichnen Objekte der Ebene 2. Man könnte jetzt von diesen unterschiedlichen Objektarten weiter ‚abstrahieren‘ und z.B. den Begriff ‚Frühstücksgegenstände‘ auf Ebene 3 einführen. Die konkreten Tassen sind Instanzen des Begriffs ‚Tasse‘; die Begriffe ‚Tasse‘, ‚Teller‘, ‚Besteck‘ sind Instanzen von ‚Frühstücksgegenstände‘; es könnten aber auch natürlich die konkreten Tassen, konkreten Bestecke usw. als Instanzen des Begriffs ‚Frühstücksgegenstände‘ bezeichnet werden.

13. Dies würde bedeuten, dass man einem Ausdruck e zwar genau ‚eine Bedeutung‘ o zuordnen kann, diese Bedeutung o gehört aber zu einer Hierarchie von ‚Objekten‘ O, die, je nach Stellung in der Hierarchie der Bedeutungsobjekte, unterschiedliche andere Objekte von einer ’niedrigeren‘ Stufe/ Ebene‘ als ‚Instanzen‘ beinhalten kann. Dies führt dazu, dass man neben den bisherigen Unterscheidungen von Wissensformen noch eine weitere einführen müsste, nämlich das ‚Objektwissen‘ $latex K_{o}$, das eine Objekthierarchie umfasst, die aus dem sinnlichen Wissen $latex K_{s}$ mittels eines Abstraktionsprozesses $latex \alpha$ erzeugt wird.

Eine Fortsetzung findet sich HIER

QUELLEN

- Avicenny, ‚Avicennas Treatise on Logic‘. Part One of ‚Danesh-Name Alai‘ (A Concise Philosophical Encyclopedia) and Autobiography, edited and translated by Farang Zabeeh, The Hague (Netherlands): Martinus Nijhoff, 1971. Diese Übersetzung basiert auf dem Buch ‚Treatise of Logic‘, veröffentlicht von der Gesellschaft für Nationale Monumente, Serie12, Teheran, 1952, herausgegeben von M.Moien. Diese Ausgabe wiederum geht zurück auf eine frühere Ausgabe, herausgegeben von Khurasani.

- Digital Averroes Research Environment

- Whitehead, Alfred North, and Bertrand Russell, Principia Mathematica, 3 vols, Cambridge University Press, 1910, 1912, and 1913; Second edition, 1925 (Vol. 1), 1927 (Vols 2, 3). Abridged as Principia Mathematica to *56, Cambridge University Press, 1962.

- Alfred North Whitehead; Bertrand Russell (February 2009). Principia Mathematica. Volume One. Merchant Books. ISBN 978-1-60386-182-3.

- Alfred North Whitehead; Bertrand Russell (February 2009). Principia Mathematica. Volume Two. Merchant Books. ISBN 978-1-60386-183-0.

- Alfred North Whitehead; Bertrand Russell (February 2009). Principia Mathematica. Volume Three. Merchant Books. ISBN 978-1-60386-184-7

Eine Übersicht über alle bisherigen Blogeinträge nach Titeln findet sich HIER.