- In diesem Blog gab es in der Vergangenheit schon mehrere Einträge (z.B. den ersten großen Beitrag Kann es doch einen künstlichen Geist geben?), die sich mit der Frage beschäftigt haben, inwieweit Maschinen die Lernfähigkeit und die Intelligenz von Menschen erreichen oder sogar übertreffen können.

- In vielen wichtigen Punkten muss man diese Frage offensichtlich bejahen, obgleich es bis heute keine Maschine gibt, die das technische Potential voll ausnutzt.

- Umso bemerkenswerter ist es, welche Wirkungen Maschinen (Computer) auf die Gesellschaft erzielen können, obgleich sie noch weitab von ihrem Optimum agieren.

- In einem Blogeintrag anlässlich eines Vortrags Über Industrie 4.0 und Transhumanismus. Roboter als Volksverdummung? Schaffen wir uns selbst ab? hatte ich noch eine grundsätzlich positive Grundstimmung bzgl. dessen, was auf uns zukommt. Ich schrieb damals:

- Das Ganze endet in einem glühenden Plädoyer für die Zukunft des Lebens in Symbiose mit einer angemessenen Technik. Wir sind nicht das ‚Endprodukt‘ der Evolution, sondern nur eine Durchgangsstation hin zu etwas ganz anderem!

- Mittlerweile beschleicht mich der Verdacht, dass wir aktuellen Menschen die nächste Phase der Evolution möglicherweise unterschätzen.

- Auslöser war der persönliche Bericht eines Managers in einem weltweiten IT-Konzern, der – von Natur aus ein Naturwissenschaftler, ‚knochentrocken‘, immer sachlich, effizient – zum ersten Mal nach vielen Jahren Ansätze von Emotionen zeigte, was die Entwicklung seiner Firma angeht. Die Firma (und nicht nur diese Firma, s.u.) entwickelt seit vielen Jahren ein intelligentes Programm, das eine Unzahl von Datenbanken auswerten kann, und zwar so, dass die Anfrage von Menschen ‚interpretiert‘, die Datenbanken daraufhin gezielt abgefragt und dem anfragenden Menschen dann mitgeteilt werden. Das Ganze hat die Form eines passablen Dialogs. Das Verhalten dieses intelligenten Programms ist mittlerweile so gut, dass anfragende Menschen nicht mehr merken, dass sie ’nur‘ mit einer Maschine reden, und dass die Qualität dieser Maschine mittlerweile so gut ist, dass selbst Experten in vielen (den meisten?) Fällen schlechter sind als diese Maschine (z.B. medizinische Diagnose!). Dies führt schon jetzt dazu, dass diese Beratungsleistung nicht nur nach außen als Dienstleistung genutzt wird, sondern mehr und mehr auch in der Firma selbst. D.h. die Firma beginnt, sich von ihrem eigenen Produkt – einem in bestimmtem Umfang ‚intelligenten‘ Programm – ‚beraten‘ (und damit ‚führen‘?) zu lassen.

- Wenn man sich in der ‚Szene‘ umhört (man lese nur den erstaunlichen Wikipedia-EN-Eintrag zu deep learning), dann wird man feststellen, dass alle großen global operierenden IT-Firmen (Google, Microsoft, Apple, Facebook, Baidu und andere), mit Hochdruck daran arbeiten, ihre riesigen Datenbestände mit Hilfe von intelligenten Maschinen (im Prinzip intelligenten Algorithmen auf entsprechender Hardware) dahingehend nutzbar zu machen, dass man aus den Nutzerdaten nicht nur möglichst viel vom Verhalten und den Bedürfnissen der Nutzer zu erfahren, sondern dass die Programme auch immer ‚dialogfähiger‘ werden, dass also Nutzer ’natürlich (= menschlich)‘ erscheinende Dialoge mit diesen Maschinen führen können und die Nutzer (= Menschen) dann zufrieden genau die Informationen erhalten, von denen sie ‚glauben‘, dass es die ‚richtigen‘ sind.

- Auf den ersten Blick sieht es so aus, als ob die Manager dieser Firmen dank ihrer überlegenen Fähigkeiten die Firmen technologisch aufrüsten und damit zum wirtschaftlichen Erfolg führen.

- Tatsache ist aber, dass allein aufgrund der Möglichkeit, dass man ein bestimmtes Informationsverhalten von Menschen (den aktuellen ‚Kunden‘!) mit einer neuen Technologie ‚bedienen‘ könnte, und dass derjenige, der dies zu ‚erschwinglichen Preisen‘ als erster schafft, einen wirtschaftlichen Erfolg erzielen kann (zu Lasten der Konkurrenz), diese rein gedachte Möglichkeit einen Manager zwingt (!!!), von dieser Möglichkeit Gebrauch zu machen. Tut der Manager es nicht läuft er Gefahr, dass die Konkurrenz es tut, und zwar vor ihm, und dass er dadurch möglicherweise auf dem Markt so geschwächt wird, dass die Firma sich davon u.U. nicht mehr erholt. Insofern ist der Manager (und die ganze Firma) ein Getriebener (!!!). Er kann gar nicht anders!

- Das, was den Manager ‚treibt‘, das ist die aktuelle technische Möglichkeit, die sich aufgrund der bisherigen technischen Entwicklung ergeben hat. Für die bisherige technische Entwicklung gilt aber für jeden Zeitpunkt die gleiche Logik: als die Dampfmaschine möglich wurde, hatte nur noch Erfolg, wer sie als erster und konsequent eingesetzt hat; als die Elektrizität verfügbar, nicht anders, dann Radio, Fernsehen, Auto, Computer, ….

- Die ‚Manager‘ und ‚Unternehmensgründer‘, die wir zurecht bewundern für ihre Fähigkeiten und ihren Mut (nicht immer natürlich), sind trotz all dieser hervorstechenden Eigenschaften und Leistungen dennoch nicht autonom, nicht freiwillig; sie sind und bleiben Getriebene einer umfassenderen Logik, die sich aus der Evolution als Ganzer ergibt: die Evolution basiert auf dem bis heute nicht erklärbaren Prinzip der Entropie-Umkehr, bei dem freie Energie dazu genutzt wird, den kombinatorischen Raum möglicher neuer Zustände möglichst umfassend abzusuchen, und in Form neuer komplexer Strukturen in die Lage zu versetzen, noch mehr, noch schneller, noch effizienter zu suchen und die Strukturen und Dynamiken der vorfindlichen Welt (Universum) darin zu verstehen.

- Während wir im Falle von Molekülen und biologischen Zellen dazu tendieren, diese eigentlich ungeheuren Vorgänge eher herunter zu spielen, da sie quasi unter unserer Wahrnehmungsschwelle liegen, wird uns heute vielleicht dann doch erstmalig, ansatzweise, etwas mulmig bei der Beobachtung, dass wir Menschen, die wir uns bislang für so toll halten, dazu ganze riesige globale Firmen, die für Außenstehende beeindruckend wirken und für Firmenmitglieder wie überdimensionale Gefängnisse (? oder Irrenanstalten?), dass wir ‚tollen‘ Menschen also ansatzweise spüren, dass die wahnwitzige Entwicklung zu immer größeren Metropolen und zu immer intelligenteren Maschinen, die uns zunehmen die Welt erklären (weil wir es nicht mehr schaffen!?), uns dies alles tun lassen, weil der einzelne sich machtlos fühlt und die verschiedenen Chefs auf den verschiedenen Hierarchieebenen total Getriebene sind, die ihre Position nur halten können, wenn sie hinreichend effizient sind. Die Effizienz (zumindest in der freien Wirtschaft) wird jeweils neu definiert durch das gerade Machbare.

- Politische Systeme haben zwar immer versucht – und versuchen es auch heute – sich ein wenig vor dem Monster der Innovation abzuschotten, aber dies gelingt, wenn überhaupt, in der Konkurrenz der Gesellschaftssysteme nur für begrenzte Zeiten.

- Was wir also beobachten ist, dass die immense Informationsflut, die das einzelne Gehirn hoffnungslos überfordert, Lösungen mit intelligente Maschinen auf den Plan ruft, die das Sammeln, Sortieren, Klassifizieren, Aufbereiten usw. übernehmen und uns Menschen dann auf neue Weise servieren. So betrachtet ist es hilfreich für alle, nützlich, praktisch, Lebensfördernd.

- Beunruhigend ist einmal die Art und Weise, das Wie: statt dass es wirklich allen hilft, hat man den Eindruck, dass es die globalen Konzerne sind, die einseitig davon Vorteile haben, dass das bisherige Ideal der Privatheit, Freiheit, Selbstbestimmung, Würde usw. aufgelöst wird zugunsten einer völlig gläsernen Gesellschaft, die aber nur für einige wenige gläsern ist. Demokratische Gesellschaften empfinden dies u.U, stärker als nicht-demokratische Gesellschaften.

- Beunruhigend ist es auch, weil wir als Menschen erstmalig merken, dass hier ein Prozess in Gang ist, der eine neue Qualität im Verhältnis Mensch – Technik darstellt. In primitiveren Gesellschaften (und auch noch in heutigen Diktaturen) war es üblich , dass wenige Menschen die große Masse aller anderen Menschen quasi ‚versklavt‘ haben. Unter absolutistischen Herrschern hatten alle einem Menschen zu gehorchen, ob der nun Unsinn redete oder Heil verkündete. Nach den verschiedenen demokratischen Revolutionen wurde dieser Schwachsinn entzaubert und man wollte selbst bestimmen, wie das Leben zu gestalten ist.

- In der fortschreitenden Komplexität des Alltags merken wir aber, dass das sich selbst Bestimmen immer mehr vom Zugang zu Informationen abhängig ist und von der kommunikativen Abstimmung mit anderen, die ohne erheblichen technischen Aufwand nicht zu leisten sind. Die dazu notwendigen technischen Mittel gewinnen aber im Einsatz, im Gebrauch eine solche dominante Rolle, dass sie immer weniger nur die neutralen Vermittler von Informationen sind, sondern immer mehr ein Eigenleben führen, das sich ansatzweise und dann immer mehr auch von denen abkoppelt, die diese vermittelnden Technologien einsetzen. Kunden und Dienstleister werden werden gleichzeitig abhängig. Wirtschaftlich können die Dienstleister nicht mehr dahinter zurück und lebenspraktisch ist der Verbraucher, der Kunde immer mehr von der Verfügbarkeit dieser Leistung abhängig. Also treiben beide die Entwicklung zu noch größerer Abhängigkeit von den intelligenten Vermittlern voran.

- Eine interessante Entwicklung als Teil der übergreifenden Evolution. Wo führt sie uns hin?

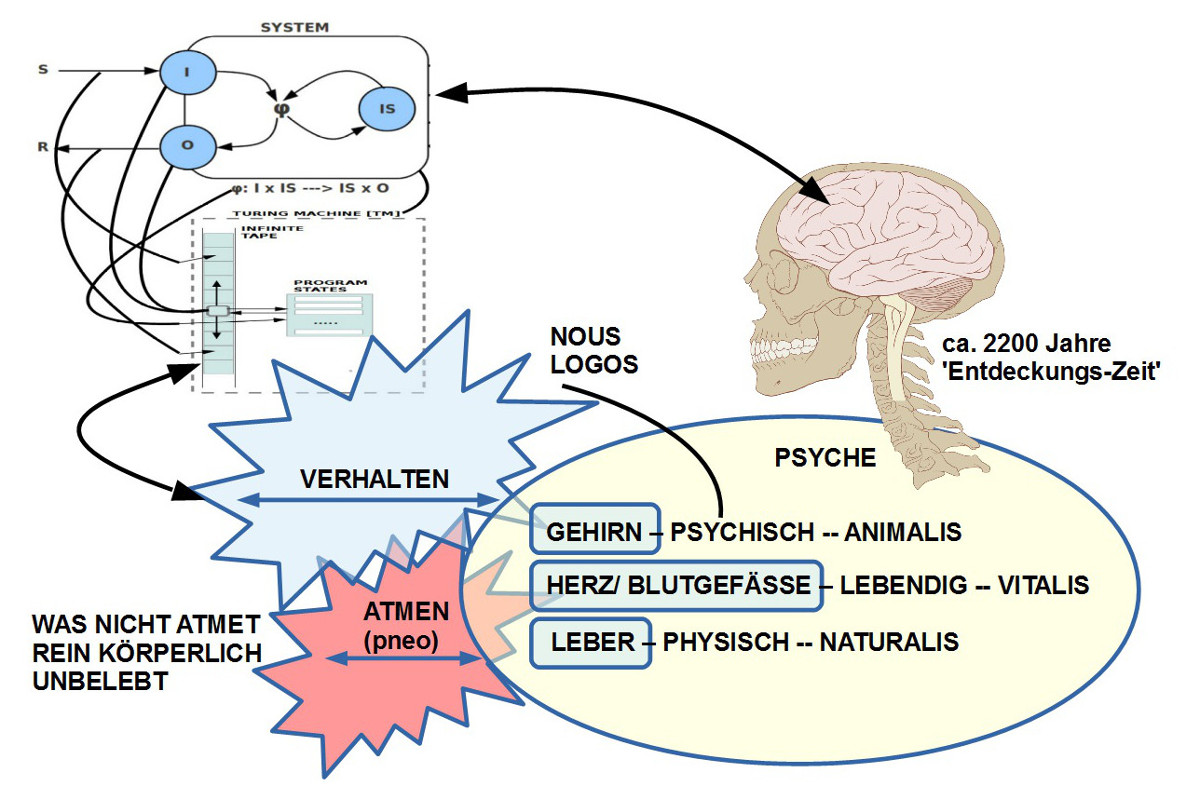

- Die Frage ist spannend, da die heute bekannten intelligenten Maschinen noch weitab von den Möglichkeiten operieren, die es real gibt. Die Schwelle ist bislang die Abhängigkeit von den begrenzten menschlichen Gehirnen. Unsere Gehirne tun sich schwer mit Komplexität. Wir brauchen Computer, um größere Komplexität bewältigen zu können, was zu noch komplexeren (für uns Menschen) Computern führt, usw. Dabei haben wir noch lange nicht verstanden, wie die etwa 200 Milliarden einzelne Nervenzellen in unserem Gehirn es schaffen, im Millisekundenbereich miteinander so zu reden, dass all die wunderbaren Leistungen der Wahrnehmens, Denkens, Erinnerns, Bewegens usw. möglich sind.

- Heutige Computer haben mittlerweile eine begrenzte lokale Lernfähigkeit realisiert, die ihnen den Zugang zu begrenzter Intelligenz erlaubt. Heutige Computer sind aber weder im lokalen wie im strukturellen voll Lernfähig.

- Einige meinen, dass die Zukunft im Sinne von technischer-Singularität zu deuten ist, dass die intelligenten Maschinen dann irgendwann alles übernehmen. Ich wäre mir da nicht so sicher. Das Hauptproblem einer vollen Lernfähigkeit ist nicht die Intelligenz, sondern die Abhängigkeit von geeigneten Präferenzsystemen (Werte, Normen, Emotionen, Bedürfnissen, …). Dieses Problem begegnen wir beim Menschen auf Schritt und Tritt. Die vielen Probleme auf dieser Welt resultieren nicht aus einem Mangel an Intelligenz, sondern aus einem Mangel an geeigneten von allen akzeptierten Präferenzsystemen. Dass Computer die gleichen Probleme haben werden ist den meisten (allen?) noch nicht bewusst, da die Lernfähigkeit der bisherigen Computer noch so beschränkt ist, dass das Problem nicht sichtbar wird. Sobald aber die Lernfähigkeit von Computern zunehmen wird, wird sich dieses Problem immer schärfer stellen.

- Das einzige wirklich harte Problem ist jetzt schon und wird in der Zukunft das Werteproblem sein. Die bisherigen Religionen haben unsere Blicke mit vielen falschen Bildern vernebelt und uns im Glauben gelassen, das Werteproblem sei ja gelöst, weil man ja an Gott glaubt (jede Religion tat dies auf ihre Weise). Dieser Glaube ist aber letztlich inhaltsleer und nicht geeignet, die realen Wertprobleme zu lösen.

- Man kann nur gespannt sein, wie die Menschheit als Teil des umfassenden Lebensphänomens mit einer immer leistungsfähigeren Technik auf Dauer das Werteproblem lösen wird. Die einzige Hoffnung ruht in der Logik des Prozesses selbst. Der Mensch in seiner unfassbaren Komplexität ist ein Produkt der Evolutionslogik; wir selbst sind weit entfernt davon, dass wir etwas Vergleichbares wie uns selbst schaffen könnten. Darf man also darauf vertrauen, dass die in allem Leben innewohnende Logik der Evolution uns Menschen als Werkzeuge benutzt zu noch mehr Komplexität, in der wir alle kleine Rädchen im Ganzen sind (als was erscheint uns ein einzelner Mensch in einer 30-Millionen Metropole?)

Einen Überblick über alle Einträge von cagent nach Titeln findet sich HIER