VORBEMERKUNG: Der folgende Text ist ein Vorabdruck zu dem Buch Die andere Superintelligenz. Oder: schaffen wir uns selbst ab?, das im November 2015 erscheinen soll

Kapitel 1

(Letzte Änderung 28.Juli 2015)

Einkapselung und Abschaffung

Start in den Tag

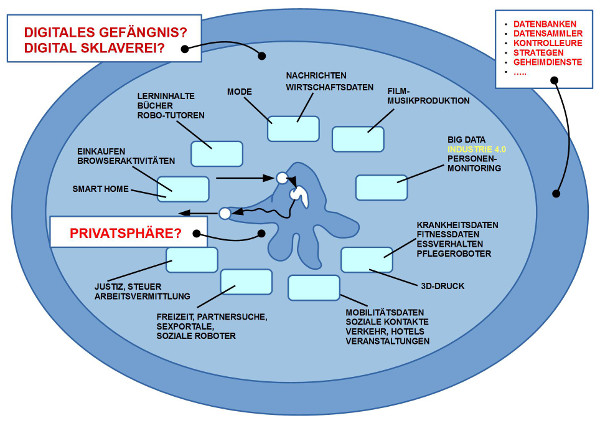

Eine leise Musik ruft mich in den Tag zurück. Der Weckcomputer kennt meine Vorlieben für Musik; er hat meinen Schlaf beobachtet, er misst regelmäßig meine aktuellen Körperdaten, und er schätzt meine mögliche Stimmung ab. Zur rechten Zeit erklingt die Weckmusik. Wenn sie zu leise ist, rufe ich ‚lauter‘; und wenn sie mir nicht passt vielleicht ‚lass das‘. Im Bad starre ich verschlafen in einen Spiegel, der sich um gute Laune bemüht, dumme Sprüche drauf hat, Bilder einblenden kann, andere Musik, oder der auch nur redet. Anhand meines Gesichtsausdrucks und meiner Stimmlage erfasst er ziemlich gut, wie ich drauf bin; besser als viele Menschen. Ich fühle mich verstanden … Unterdessen wird die Küche für ein Frühstück präpariert und das Ankleidungsprogramm erstellt anhand der Termine aus dem Kalender und meiner aktuellen Stimmungslage einen Ankleidungsvorschlag … Während dem ernährungsbewussten Frühstück aus zertifizierten Lebensmitteln höre und schaue ich mir ein paar vorsortierte Nachrichten an (es gibt stündlich mehrere hunderttausend neue Meldungen, aus denen das System die ‚wichtigen‘ herausfiltert). Nach dem Frühstück erscheint auf dem Bildschirm eine Liste der Dinge, die für die Küche nachbestellt werden müssten. Ich bestätige, verneine, oder erweitere die Liste und schicke den Auftrag ab. Sobald ich Anstalten treffe, das Haus zu verlassen, wird der Aufzug schon in die entsprechende Etage gesteuert und ein Transport-eMobil aktiviert. Wenn ich einsteige weiß dieses Transport-eMobil anhand meines Kalenders schon, welches Ziel anzufahren ist. Ich entspanne mich, lasse mir wichtige Dokumente anzeigen oder stelle eine Kommunikationsverbindung zu einem Geschäftspartner her…

Diese Vision mag den einen erschrecken, die andere begeistern; sie ist auf jeden Fall nicht mehr weit weg vom technisch Möglichen. Es sind weniger technische Gründe, die solch ein Szenario bislang noch verhindern, sondern eher Fragen der Abstimmung der technischen Systeme untereinander, Fragen der Investitions- und Betriebskosten, der Wartung, der Sicherheit, der Privatheit, und der Denk- und Lebensgewohnheiten.

Auch ist interessant, was ‚hinter den Kulissen‘ alles passiert bzw. passieren kann.

Hinter allem das Netz

Alle Daten laufen durch Netzwerke, über Server und werden von Programmen verwaltet. Technisch könnte man von jedem Punkt im Netzwerk aus alle Daten beobachten, sammeln, auswerten und darauf Entscheidungen aufbauen. Damit dies nicht ungehindert geschieht, werden die Daten partiell ‚kodiert‘ und/ oder ‚verpackt‘, so dass ein anderer als der intendierte Empfänger, die Daten nicht so ohne weiteres ‚lesen‘ kann. Aber letztlich ist es nur eine Frage des Rechenaufwandes, um alle Varianten abzuprüfen, um die ‚versteckte‘ Botschaft zu identifizieren, sie zu ‚dekodieren‘. (Oder, einfacher, man verschafft sich Zugang zu den Verschlüssungsprogrammen, oder über die Mikroprogramme in der Hardware selbst). Während die einen ein solches unautorisiertes Mitlesen direkt gegen Geld als ‚Cyberkriminelle‘ tun, gibt es die staatlich subventionierten ‚Geheimdienste‘, die ‚für sich legal‘ sind, für alle anderen aber sind sie auch nichts anderes als ‚Cyberkriminelle‘, ‚Staatsterroristen‘. In der Regel müssen sie nichts befürchten, wenn sie die Rechte anderer verletzen. Schließlich gibt es noch die Grauzone der privaten Wirtschaft, die sich auf vielen Wegen formal die Zustimmung der Benutzer erhandeln, ohne dass diese in der Regel überschauen, was alles mit ihren Daten geschieht oder geschehen kann. Dass jede Klickaktion im Web dazu führt, dass man kurz darauf tage- und wochenlang nervige Anzeigen eingeblendet bekommt, ist ärgerlich und störend, jedoch nicht notwendigerweise gefährlich. Dass die eigenen Daten über Wochen, Monate und Jahre systematisch gesammelt werden, für viel Geld an verschiedene Firmen (auch Geheimdienste) verkauft werden, und mittels dieser Daten neue Dienstleistungen, Produkte und Firmen generiert werden, das kann sehr gefährlich sein, kann den einzelnen massiv schädigen und kann ganze Märkte und Volkswirtschaften zerstören.

Datenschmarotzer

Banken und Versicherungen könnten sich auf diese Weise Kunden vorsortieren und entsprechend behandeln. Krankenversicherungen könnten z.B. vorschreiben, was man isst und wie man sich bewegen muss. Personalabteilungen von Firmen könnten (und manche tun dies schon real) die Bewerber nach ihrer Vorgeschichte im verborgenen Netz sortieren. Selbst kleinste Vergehen aus der Vergangenheit, Krankheiten, Ereignisse aus der Freizeit, Unwahre Behauptungen im Netz, sie alle können dazu führen, dass man keinen Job mehr bekommt – oder, ja, man bekommt zwar ein Angebot, aber man wird durch die Blume erpresst: man weiß ja, dass; man könnte vielleicht darüber hinwegsehen, wenn …

Diejenigen, die hinter den Oberflächen Informationen sammeln können, die gewinnen Einblicke in Marktsituationen, in potentielle Märkte und in private Aktivitäten. Sie können Dienstleistungen und Firmen anbieten, bevor jeder andere ahnt, dass dies möglich ist; die Datenmonopolisten können auf diese Weise zu Marktmonopolisten werden, und andere Firmen schleichend ‚erdrücken’… Globale Firmen im Katz und Maus Spiel mit nationalen Regierungen, oder Regierungen mit ihrer Bevölkerung.

(Anmerkung: Das Beispiel der andauernden Geheimverhandlungen zu TTIP (Transatlantic Trade and Investment Partnership) wird von vielen als Beleg genau für diesen Trend gesehen. Bis heute werden diese Verhandlungen an den nationalen Parlamenten der USA und Europas vorbei geführt, selbst nach eindeutigen Interventionen verschiedener Parlamente. Wenige EU-Bürokraten verhandeln unter Ausschluss der Öffentlichkeit mit Vertretern globaler Kapitalvertreter über die Zukunft von ca. 320 Mio US-Amerikanern und ca. 500 Mio Europäern. Die Vermutung, dass hier eine ausgewählte Schar von Firmen versucht, die Einflussmöglichkeiten der nationalen gewählten Parlamente zu ’neutralisieren‘, wurde bisher nicht widerlegt. Im Gegenteil, alle Informationen, die bekannt werden, stützen diese Vermutung und alle wichtigen deutschen Politiker geben bislang nur allgemeine Floskeln zum Besten, warum dies gut sein soll. Was unterscheidet diese Situation noch von einem Staatsstreich, in diesem Fall ein Staatsstreich von oben?)

Vom Verschwinden der Welt

Das Voranschreiten der Digitalisierung bringt es mit sich, dass der einzelne menschliche Akteur immer weniger mit realen Umweltausschnitten zu tun hat, dafür immer mehr mit digitalen Repräsentationen. Realität verwandelt sich in digitale Dateien unterschiedlichster Formate. Das Wetter erscheint als Landkarte mit Piktogrammen. Reale Unternehmen verwandeln sich in Zahlen und Kurven in einem Diagramm. Ressourcen aller Art sind nur noch einfache Zahlen. Reale Produktionsprozesse werden zu mathematischen Funktionen in Rechenblättern oder anderen Computerprogrammen. Die anderen Menschen verschwinden hinter SMS-Texten, standardisierten Bildern, werden als Videoplots formatiert; sie werden zur Stimme aus dem Kopfhörer; man kann sie hinter einem Avatar in einem Computerspiel vermuten; sie sind numerische IDs mit einer Liste von Attributen im ASCII-Format. Nahrungsmittel sind losgelöst von ihren Herstellungsprozessen; sie treten uns vor Augen in bunten Verpackungen, wo wir das sehen, was aufgedruckt ist, nicht das, was wirklich drin ist. So kann ein bestimmtes Siegel der Händlerkette riesige Gewinne bringen, obgleich das reale Produkt dahinter dem Siegel gar nicht entspricht… Die Fabrik wird zu einem Schaltplan; die Produktion erscheint als Zahlenkolonne, als Säulendiagramm. Mit Robotern wird die Produktion zuverlässiger und billiger, und die potentiellen Käufer, die durch Arbeit ihr Geld verdienen, werden abgeschafft, weil sie zu anfällig und zu teuer sind. Wer denkt darüber nach, dass die Arbeitenden mit den potentiellen Käufern korrespondieren? Wer soll noch konsumieren, wenn keiner mehr verdient? Die Umverteilung des verfügbaren Reichtums auf immer weniger Menschen ist aktenkundig. Schaffen sich die Gesellschaften selber ab?

Digitale Sklaverei

Hatte man früher ein Produkt gekauft, ging man in ein Geschäft, zahlte bar, nahm das Produkt in Empfang und ging nach Hause. Zum Händler musste man bestenfalls zurück, wenn es sich um einen Garantiefall handelte, das Produkt Mängel aufwies, die es in der Garantiezeit nicht aufweisen sollte.

Will man heute ein Produkt kaufen, bekommt man dieses vielfach gar nicht mehr direkt und ausschließlich, sondern man erwirbt im Falle von softwarebasierten Produkten eine Art Nutzungsrecht auf Zeit, das an vielerlei Bedingungen geknüpft wird. Man muss seine Adresse preisgeben, seine Kontodaten, man muss seine Nutzung über einen fremden Server registrieren und permanent kontrollieren lassen; man muss zusätzlich oft fremden Programmen erlauben, das Gerät ‚bewohnen‘ und ‚benutzen‘ zu dürfen, ohne dass man dies kontrollieren oder ändern könnte. Über Kameras und sonstige eingebaute Sensoren kann das fremde Programm jederzeit Daten aus der nächsten Umgebung messen und weiter leiten. Während ich an meinem Computer sitze und schreibe können die Bilder meines Gesichts (klar, wen interessiert dies schon; und doch, warum überhaupt?) in Bruchteilen von Sekunden über das Netz irgendwohin in die Welt reisen.

Die Frage ist, ob man noch ein Alternative hat? Könnte ich auf diese Programme verzichten? Im Berufsleben gibt es immer weniger Alternativen; allein, um die normale Arbeit machen zu können, benötige ich heute ein ganzes Bündel von Programmen, und jedes Mal muss ich mich an ein fremdes Programm auf einem fremden Server ‚verkaufen‘. Ich habe keine Alternative (Anmerkung: Ja, es gibt auch freie Programme, ich benutze solche Programme von Anbeginn an. Doch können diese Programme — von glücklichen Ausnahmen abgesehen — mit der Industrie sehr oft nicht Schritt halten, speziell nicht dort, wo Programme spezielle Hardware steuern. Hersteller von Hardware können den Entwicklern von freien Programmen die notwendigen Daten vorenthalten, z.B. weil sie sonst von den Anbietern industrieller Betriebssysteme nicht berücksichtigt würden … )

Tritt man einen Schritt zurück und schaut sich aus einer gewissen Distanz an, was hier geschieht, kann man auffällige strukturelle Ähnlichkeiten entdecken mit dem Jahrtausende alten Phänomen der Sklaverei (siehe dazu den aufschlussreichen Text des Zusatzübereinkommens über die Abschaffung der Sklaverei, des Sklavenhandels und sklavereiähnlicher Einrichtungen und Praktiken abgeschlossen in Genf am 7. September 1956, genehmigt von der Schweizer Bundesversammlung am 17. Juni 1964.

In Artikel 1 dieses Zusatzabkommens wird als ein der Sklaverei zugeordnetes Phänomen die ‚Schuldknechtschaft‘ erwähnt. Eine Schuldknechtschaft entsteht, wenn “… ein Schuldner als Sicherheit für eine Schuld seine persönlichen Dienstleistungen oder diejenigen einer von ihm abhängigen Person verpfändet, wenn der in angemessener Weise festgesetzte Wert dieser Dienstleistungen nicht zur Tilgung der Schuld dient oder wenn diese Dienstleistungen nicht sowohl nach ihrer Dauer wie auch nach ihrer Art begrenzt und bestimmt sind … “.

Im Falle der Softwarenutzung würde ich es bevorzugen, einen Betrag X zu zahlen um diese Programme nutzen zu können, ohne weitere Abhängigkeiten. Einen Betrag X muss ich in der Regel tatsächlich zahlen, dieser Betrag X reicht jedoch nicht aus; ich werde zusätzlich gezwungen, sehr viele Daten von mir ‚abzugeben‘, über die ich auf unbeschränkte Zeit jegliche Kontrolle verliere. Und nicht nur das, meine tatsächliche Nutzung wird fortwährend kontrolliert, protokolliert und könnte jederzeit vom Hersteller beendet werden, mit entsprechend schlimmen Folgen für die Arbeitsprozesse, die mit dem Programm verknüpft sind.

Rein formal versichern Hersteller auf dem Papier, dass sie die Daten ausschließlich zum Zwecke des störungsfreien Betriebes der Programme benutzen, faktisch hat jedoch der Kunde keine Kontrolle über die tatsächliche Verwendung der Daten. Außerdem berührt dies nicht die faktische ‚Schuldknechtschaft‘ der andauernden Abhängigkeit vom Hersteller.

Für diese heute gängige Form der Schuldknechtschaft könnte man den Begriff der digitalen Schuldknechtschaft einführen.

Man kann sich auch fragen, ob die ‚Leibeigenschaft‘ nicht auch noch zutrifft. Im Text heißt es unter Art.1.b “Leibeigenschaft, d. h. die Stellung einer Person, die durch Gesetz, Gewohnheitsrecht oder Vereinbarung verpflichtet ist, auf einem einer anderen Person gehörenden Grundstück zu leben und zu arbeiten und dieser Person bestimmte entgeltliche oder unentgeltliche Dienste zu leisten, ohne seine Stellung selbständig ändern zu können“. Im Fall der Programmebeziehung gibt es zwar keine Grundstücke, aber der Programmebenutzer geht mit dem Kauf eine Beziehung zum Hersteller ein, die ihn in vielfacher Weise über die Nutzung im engeren Sinne bindet: so ist die Übergabe von vielen persönlichen Daten samt der damit einhergehenden anhaltenden kontinuierlichen Kontrolle der Aktivitäten ein ‚Dienst‘ an dem Hersteller, der ‚unentgeltlich‘ geleistet wird, ohne dass man diese Beziehung (‚Stellung‘) verändern kann; würde man dies einseitig tun, bekäme man die Daten, Momente des eigenen Selbst, nicht zurück.

Auch hier bietet es sich an, den Begriff der digitalen Leibeigenschaft einzuführen.

In Art. 7.b heißt es, dass “eine Person in sklavereiähnlicher Stellung“ eine solche Person ist, die sich “in einer Rechtsstellung oder Lage [befindet], die auf einer der in Artikel 1 erwähnten Einrichtungen oder Praktiken beruht;“. Die “in Artikel 1 erwähnten Einrichtungen oder Praktiken“ sind z.B. die Schuldknechtschaft und die Leibeigenschaft.

Da mit diesem Text sowohl die ‚Schuldknechtschaft‘ wie auch ‚Leibeigenschaften‘ als Formen der Sklaverei gewertet werden, könnte man analog von der Existenz einer digitalen Schuldknechtschaft und einer digitalen Leibeigenschaft auf die Existenz digitaler Sklaverei schließen.

Nach Art 6.1 1. soll gelten, dass die „Versklavung einer Person oder die Anstiftung einer Person, sich oder eine von ihr abhängige Person durch Aufgabe der Freiheit in Sklaverei zu geben, oder der Versuch dazu oder die Teilnahme daran oder die Beteiligung an einer Verabredung zur Durchführung solcher Handlungen … eine strafbare Handlung nach den Gesetzen der Vertragsstaaten dieses Übereinkommens sein [soll]; …“.

Zu den vielen Unterzeichnerstaaten gehört auch Deutschland (1959). Bislang haben die neuen digitalen Versionen von Sklaverei die Wahrnehmungsschwelle der deutschen Justiz (auch nicht die Justiz anderer Länder) noch nicht überwunden.

Sind wir mittlerweile so an Unrecht gewöhnt, dass wir die alltägliche Praxis der digitale Versklavung einfach so hinnehmen, oder sind diese Überlegungen ‚überzogen‘?

Mensch als Restproblem

Lässt man die Faszination der Oberfläche der neuen digitalen Welt für einen Moment mal weg, und lässt die verdeckten Aushorch- und Gewaltstrukturen auf sich wirken, die neue Unübersichtlichkeit, die neue schier grenzenlosen Manipulierbarkeit, die ungeheure Ausdehnung von Kontrolle und digitaler Sklaverei, dann kann schon einmal ein Gefühl von Hilfslosigkeit entstehen, von Verratensein, von schwacher Endlichkeit. Während die Geräte immer schneller werden, immer mehr Daten mit höchster Geschwindigkeit hin und her bewegen, immer kompliziertere Rechnungen in Sekundenbruchteilen vollziehen, immer ‚gescheiter‘ daherkommen in Spielen, im Quiz, in der Diagnose, in der Beratung …. hat man das Gefühl, man ist lahm wie eine Ente; vergisst so oft so viel; ist streckenweise von Stimmungen, Gefühlen und Emotionen getrieben, fast paralysiert. Hat einen endlichen langsamen Körper; so unförmig, so wenig glanzvoll … Wie soll das enden? Werden die Maschinen in Zukunft alles machen und wir nichts mehr? Wo und wie soll ich morgen noch arbeiten, wenn Kollege Computer schrittweise alles zu übernehmen scheint?

Für Unternehmer scheint es sich allemal zu rechnen: Roboter können preisgünstiger, zuverlässiger und qualitativ besser produzieren. Sie sind viel schneller, sie meckern nicht, sie streiken nicht, sie brauchen keine krankheitsbedingten Auszeiten ….

Künftig werden sich alle Autos, Busse, Straßenbahnen, Züge, Flugzeuge ohne menschliche Fahrer und Piloten bewegen. Riesige Schiffe werden keine menschliche Besatzung haben.

Kriege werden nicht mehr von Soldaten geführt, sondern von Automaten, von Robotern, von Drohnen. Maschinen kämpfen gegen Maschinen. Computerprogramme gegen Computerprogramme. Mit einem Knopfdruck kann ein General eine ganze Armee gegen seine eigene Regierung in Bewegung setzen. Wird irgendwann dann ein durch ein Programm selbständig ausgelöster Befehl ausreichen, dass sich eine automatisierte Roboterarmee gegen ihren eigenen General wendet?

Wozu brauchen wir weiter Menschen in der digitalisierten Welt? Für die Arbeit? Nein. Für den Konsum? Menschen als Konsumenten sterben mangels Einkommen aus, da sie keine Arbeit mehr haben werden. Als Soldaten, Beamte, Verwalter, Manager wurden sie schrittweise ersetzt. Die Künstler leben schon jetzt nur noch als dreidimensionale Kunstfiguren in animierten Filmen und Computerspielen. Kompositionen und Malerei beherrschen die Software-Programme besser als die Menschen. Architektur findet nur noch im Computer statt. Neue Produkte und Pflanzen konzipiert der Computer. Menschen sind zu langsam, zu unzuverlässig, verbrauchen große Ressourcen, erzeugen Abfall, sie sind aggressiv, emotional labil, … sie kosten und sie stören.

Wird der Mensch in der digitalen Welt aussterben? Haben wir uns schon ergeben? Sind wir nicht schon längst eine willenlose meinungslose Masse, die von Regierungen und globalen Konzernen nach Belieben vor sich hergetrieben wird?

Fortsetzung mit Teil 2.

Einen Überblick über alle Artikel von cagent nach Titeln findet sich HIER.