Journal: Philosophie Jetzt – Menschenbild, ISSN 2365-5062

20.März 2018

URL: cognitiveagent.org

Email: info@cognitiveagent.org

Autor: Gerd Doeben-Henisch

Email: gerd@doeben-henisch.de

Abstract

Auf der Suche nach dem Neuen Menschenbild im Spannungsfeld von Philosophie, empirischen Wissenschaften und Computertechnologie schält sich heraus, dass ein Bindeglied in allem das Wechselspiel von Akteuren in Umgebungen ist, die sich mittels Kommunikation koordinieren. Die Anzahl hier relevanter Artikel und Bücher geht in die Hunderte, wenn nicht in die Tausende. Interessanterweise scheint der oft geschundene, vielfach wegdiskutierte Begriff der ’Wahrheit’ hier eine neue Bedeutung zu gewinnen. Die Arbeitshypothese lautet: Wahrheit ist ein unabdingbarer Rohstoff jeder nachhaltigen Gesellschaft. Diese These soll in folgenden Szenarien ’getestet’ werden: (i) Evolutionäre Zubereitung bisher; (ii) Individuum und Gesellschaft; (iii) Die Mensch-Maschine Superintelligenz. Diese Artikelserie beginnt mit einer kurzen Zusammenschau der bisherigen Artikel im Blog seit 2011, die das Thema ’Wahrheit’ im Titel hatten.

So unterschiedlich diese Artikel sind, sie sind die ’Vorboten’ einer neuen Sicht auf das Ganze, in der der einzelne gleichberechtigt ist mit dem Ganzen: das Ganze ohne den einzelnen ist Nichts, und der einzelne ohne das Ganze ist ’fast nichts’.

I. ÄLTERE BEITRÄGE ZUM WAHRHEITSBEGRIFF

Hier die Blogbeiträge, die sich in den letzten Jahren explizit mit der Bedeutung und der Rolle von ’Wahrheit’ beschäftigt hatten:

1) Nr.32 vom Juli 2011: Wahrheit im Alltag . Hier die Idee, dass die Wahrheit einerseits zwar in den Strukturen der Welt fundiert ist, andererseits dem einzelnen aber nur im Modus seines Bewusstseins zugänglich ist. Im Bewusstsein können diese Strukturen starke Modifikationen erfahren.

2) Nr.76 vom April 2012: WAHRHEIT ALS UEBERLEBENSNOTWENDIGKEIT; WEISHEIT ALS STRATEGIE

Fortführung der Idee, dass die Strukturen der Welt sich in unterschiedlichen Bildern (Modellen) im Kopf eines Menschen niederschlagen können. Durch die reale Interaktion mit seiner Umgebung wirken dann diese Modelle über das Verhalten in die Welt hinein. Wenn sie unangemessen oder ’falsch’ sind, kann dies entsprechende Folgen haben.

3) Nr.82 vom August 2012: DIE WAHRHEIT IST GANZ UND GAR NICHT KÄUFLICH Hier wird der gleitende Übergang von biologischen Systemen ohne Bewusstsein zu Systemen mit Bewusstsein angesprochen. Auch Systeme ohne Bewusstsein verfügen über Verhaltensmuster, die sich an aktuellen Sinnesreizen orientieren, die von der Umgebung ausgelöst werden. Ein Muster ist dann ’passend’, wenn es zu den Auslösereizen ’gehört’. Mit der Herausbildung von Nervensystemen nimmt die Möglichkeit zu, verschiedene Handlungsalternativen für eine Situation ’auszuwählen’. Wichtig ist hier, dass das ’Passende’, die ’Wahrheit’ als Referenzpunkt die

jeweilige Umgebung hat, die dem einzelnen System ’voraus liegt’; sie ist in diesem Sinne ’nicht käuflich’.

4) Nr.108 vom Januar 2013: EINSCHUB: WAHRHEIT vs. KAPITAL Die schon früher angesprochene Interaktion des einzelnen Systems mit seiner Umgebung und die innerhalb dieser Aktionen sich realisierende Wahrheit kann dadurch in Abhängigkeiten

von Rahmenbedingungen geraten, die für die Gewinnung von ’wahren Bildern/ Modellen’ ’abträglich’ ist. So haben z.B. Firmen sehr harte Überlebensregeln, die den Handlungsraum für ’wahre Modelle’ meistens sehr einschränken; das Gleiche gilt für allerlei Behörden und für die unterschiedlichen politischen Systeme.

5) Nr.168 vom Oktober 2013: DIE WAHRHEIT ERSCHEINT IM BETRACHTER – Oder: WARUM WIR NUR GEMEINSAM DAS ZIEL ERREICHEN KÖNNEN Hier

wird der Aspekt der Abhängigkeit des einzelnen in seinem Erkennen von der Welt von seiner Geschichte und seiner Umgebung herausgestellt. Ferner die wechselseitige Beeinflussung untereinander über die aktuellen Weltbilder. Dazu der Aspekt, dass es für die Erkenntnis der Wahrheit nicht ausreicht, einzelne Augenblicke zur Kenntnis zu nehmen, sondern man kann ’Zusammenhänge’ und ’Regelhaftigkeiten’ nur durch

Zusammenschau vieler einzelner Augenblicke erfassen. Das Erkennen der ’Wahrheit’ muss ein Projekt von allen sein. Unsere subjektive ’Falschheit’ hebt die ’objektive’ Wahrheit nicht notwendigerweise auf, kann sie aber für das erkennende Subjekt ’unsichtbar’ machen.

6) Nr. 202 vom März 2014: DIE WAHRHEIT BEGINNT IM CHAOS Da wir jenseits unserer eigenen Wahrheit die ’wahre Wahrheit’ der Welt nicht kennen, können wir auch nicht definitiv sagen, ob die Welt ein Chaos ist oder irgendeine Ordnung. Zu Beginn

ist alles erst mal Chaos. Von daher beginnt die Erkenntnis der Wahrheit im Chaos. Das jeweilige Wissen ist eine Momentaufnahme einer unbekannten Vorgabe, und muss daher grundsätzlich als versuchsweise Annäherung begriffen werden. Die scheinbare Ordnung eines Wissens kann ein Artefakt der Weltfremdheit sein.

7) Nr. 223 vom August 2014: WIEDER TRITT FINDEN – Nach einer längeren Pause

– WAHRHEIT, DEMOKRATIE, RELIGION(en)

Eine wichtige Grundeinsicht: die einzig ’wirklichen’ und ’wahrheitsfähigen’ Erkenntnisse finden sich nicht schon in den primären Ereignissendes Alltags, sondern erst und einzig im ’verarbeitenden Denken’, in den Aktivitäten der individuellen Gehirne,

soweit diese in der Lage sind, solche allgemeinen Muster zu erzeugen und damit weiter zu arbeiten. Die bisherige Geschichte hat keine funktionierende und allgemeine Wahrheitstheorie hervorgebracht. Starke Widerstände für eine moderne Sicht der Wahrheit kam von allen Religionen. Das juristische Denken ist auch wenig geeignet, Erkenntnis von Wahrheit zu fördern.

8) Nr. 263 vom Januar 2015: HYSTERIE: NEIN, SOLIDARITÄT: JA – DAHINTER WARTET DIE WAHRHEIT

Das alltägliche Überleben erzwingt Vereinfachungen im Weltverstehen; dies kann kontraproduktiv werden. Förderliche Faktoren für wahres Wissen können sein: reale Toleranz, Rechtssicherheit, umfassende Bildung, funktionierende Infrastrukturen, darin eingebettet Handel und Wirtschaft. ’Wahrheit’ und ’Falschheit’ sind entscheidbare Sachverhalte, die die Basis für unsere Weltbetrachtung bilden sollten. ’Gut’ und ’Böse’ sind hingegen ’Wertvorstellungen’ von sozialen Gruppen, die – sofern sie verstehbar sind – dazu verwendet werden können, innerhalb einer sozialen Gruppe das gemeinsame Verhalten zu ’regeln’. Eine rationale Anwendung von Gut-Böse-Regeln setzt die Möglichkeit der Wahrheitsfindung voraus. Im Konzept der religionsfreien Wissenschaft wurden die Regelsysteme ’zurückgeholt’ aus der Sphäre der Unkontrollierbarkeit und im Hier und Jetzt verankert. Damit die Menschen wieder Herr ihrer eigenen Regeln sein können, wurden Regeln ’kritisierbar’, konnte man menschlich aufgestellte Regeln ändern, wenn die Wirklichkeit ihnen entgegen stand.

9) Nr. 395 vom Juli 2017: DAS NEUE ALS PROBLEM DER WAHRHEIT – Zwischenbemerkung

Es gibt viele Gründe in der Gegenwart, warum selbst angestammte Bereiche der Wahrheit wie die empirischen Wissenschaften, Erosionserscheinungen aufweisen; … Dennoch können all diese Verformungen und Entartungen nicht gänzlich darüber hinwegtäuschen, dass – selbst wenn traditionelle Wahrheits-Begriffe möglicherweise korrigiert, justiert werden müssen (im öffentlichen Bewusstsein) – die grundlegenden

Sachverhalte der Übereinstimmung unseres virtuellen Denkens mit einer jenseits dieses Denkens unterstellten objektiven Wirklichkeit weiterhin von grundlegender Bedeutung und lebenswichtig sind… Nach dem Aufwachen folgen viele, viele Stunden von Verhaltensweisen, die sich beständig dadurch speisen, dass man Wissen über eine Welt hat, die sich in den konkreten Handlungen dann auch bestätigen. Das ist unser primärer, alltäglicher Wahrheitsbegriff: Es verhält sich im Handeln so, wie wir in unserem Denken annehmen… Zu dieser Alltagserfahrung gehört auch, dass wir uns manchmal irren…Alle diese Irrtumserfahrungen lassen uns aber nicht grundsätzlich an unserer Fähigkeit zweifeln, dass wir ein handlungstaugliches Bild von der Welt haben können. Dieses Bild, sofern es funktioniert, nennen wir ’wahr’…. ’Neues’ definiert sich … dadurch, dass es mit dem bisher Bekannten nichts oder nur wenig zu tun hat. Wirklich ’Neues’ lässt ein Stück Wirklichkeit aufbrechen, das wir so bislang nicht kennen… Innovation als Kern des biologischen Lebens…

10) Nr. 396 im Juli 2017: WAHRHEIT CONTRA WAHRHEIT. Notiz

In diesem Beitrag wird die mögliche Bedeutung des Begriffs ’Wahrheit’ sehr vielschichtig betrachtet. Nach Kapiteln mit den Überschriften ARBEITSDEFINITION VON WAHRHEIT, WAHRHEIT UND LEBENSFORM sowie GEDANKE UND REALE WELT folgt ein Schlusskapitel mit der Überschrift EINE KULTUR DER WAHRHEIT? In diesem finden sich folgende Thesen:

a) Wenn man sieht wie unglaublich stark die Tendenz unter uns Menschen ist, aktuelle, partielle Wahrheiten (die aus Sicht des einzelnen nicht partiell, sondern universell sind) mit einer bestimmten Alltagspraxis zu verknüpfen und diese fest zu schreiben, dann könnte man auf die Idee kommen, zu fragen, was wir als Menschen tun können, um dieser starken Tendenz ein natürliches Gegengewicht gegenüber zu stellen, das dem Trieb zu partiellen Wahrheit entgegenwirken könnte.

b) Innerhalb der Rechtsgeschichte kann man beobachten, wie im Laufe von Jahrtausenden das Recht des Angeklagten häppchenweise soweit gestärkt wurde, dass es in modernen Staaten mit einem funktionieren Rechtssystem üblich geworden ist, jemanden erst dann tatsächlich zu verurteilen, nachdem in nachvollziehbaren, transparenten Verfahren die Schuld bzw. Unschuld objektiv festgestellt worden ist.

Dennoch kann man sehen, dass gerade in der Gegenwart in vielen Staaten wieder eine umgekehrte Entwicklung um sich greift: der methodische Respekt vor der Gefahr partieller Wahrheiten wird einfach über Bord geworfen und Menschen werden allein aufgrund ihrer Andersartigkeit und eines blinden Verdachts vor-verurteilt, gefoltert, und aus ihren gesellschaftlichen Stellungen verjagt.

c) Innerhalb der Welt der Ideen gab es eine ähnliche Entwicklung wie im Rechtssystem: mit dem Aufkommen der empirischen experimentellen Wissenschaften in Kooperation mit mathematischen Strukturen konnte das Reden über Sachverhalte, über mögliche Entstehungsprozesse und über mögliche Entwicklungen auf ganz neue Weise transparent gemacht werden, nachvollziehbar, überprüfbar, wiederholbar, unabhängig von dem Fühlen und Meinen eines einzelnen – Anmerkung: Allerdings nicht ganz! –. Diese Art von Wissenschaft kann großartige Erfolge aufweisen, ohne die das heutige Leben gar nicht vorstellbar wäre. Doch auch hier können wir heute beobachten, wie selbst in den Ländern mit einem entwickelten Wissenschaftssystem die wissenschaftlichen Prinzipien zunehmen kurzfristigen politischen

und ökonomischen Interessen geopfert werden, die jeweils auf den partiellen Wahrheiten der Akteure beruhen.

d) Es drängt sich dann die Frage auf, ob der Zustand der vielen (partiellen) Wahrheiten generell vermeidbar wäre bzw. wie man ihn konstruktiv nutzen könnte, um auf der Basis der partiellen Wahrheiten zu einer umfassenderen Wahrheit zu kommen.

e) Die Alternative ist die berühmte offene Gesellschaft, in der eine Vielfalt von partiellen Wahrheiten möglich ist, verbunden mit dem Vertrauen, dass die Vielfalt zu entsprechend vielen neuen erweiterten partiellen Wahrheiten führen kann (nicht muss!). Hier gibt es – im Idealfall – eine Fülle unterschiedlicher Medien und keine Zensur. Entsprechend wären auch alle Lern- und Erziehungsprozesse nicht an einem Drill, einer autoritären Abrichtung der Kinder und Jugendlichen orientiert, sondern an offenen, kreativen Lernprozessen, mit viel Austausch, mit vielen Experimenten.

f) Allerdings kann man beobachten, dass viele Menschen nicht von vornherein solche offenen, kreativen Lernprozesse gut finden oder unterstützen, weil sie viel anstrengender sind als einfach einer autoritären Vorgabe zu folgen. Und es ist ein historisches Faktum, dass partielle Wahrheitsmodelle bei geeigneter Propaganda und gesellschaftlichen Druck eine große Anhängerschaft finden können. Dies war und ist eine große Versuchung für alle narzisstischen und machtorientierten Menschen. Das scheinbar Einfachere und Bequemere wird damit sprichwörtlich zum ’highway to hell’.

g) Für eine offene Gesellschaft als natürlicher Entwicklungsumgebung für das Entstehen immer allgemeinerer Wahrheiten sowohl in den Beteiligten wie auch im Alltag scheinen von daher geeignete Bildungsprozesse sowie freie, unzensierte Medien (dazu gehört heute auch das Internet) eine grundlegende Voraussetzung zu sein. Die Verfügbarkeit solcher Prozesse und Medien kann zwar keine bessere gedachte und gelebte Wahrheit garantieren, sie sind allerdings notwendige Voraussetzungen, für eine umfassendere Kultur der Wahrheit. (Anmerkung: Natürlich braucht es noch mehr Elemente, um einen einigermaßen freien Raum für mögliche übergreifende Wahrheiten zu ermöglichen.)

h) Vor diesem Hintergrund ist die weltweit zu beobachtende Erosion von freien Medien und einer offenen, kreativen Bildung ein deutliches Alarmsignal, das wir Menschen offensichtlich dabei sind, den Weg in ein wahrheitsfähige Zukunft immer mehr zu blockieren. Letztlich blockieren wir uns als Menschen damit nur selbst. Allerdings, aus der kritischen Beobachtung alleine folgen keine wirkenden konkreten Verbesserungen. Ohne eine bessere Vision von Wahrheit ist auch kein alternatives Handeln möglich.

Deswegen versuchen ja autoritäre Regierungen immer, zu zensieren und mit Propaganda und Fake-News die Öffentlichkeit zu verwirren.

11) Nr. 409 vom Oktober 2017: EIN HOMO SAPIENS – VIELE BILDER. Welches ist wahr? .

Ein sehr intensiver Artikel. Nach Kapiteln wie ’Vielfalt trotz Einheit’, ’Wahrheit, die ich meine’, ’Wahrheitsmechanismen’, ’Gegenwart, Gestern, Morgen’, ’Eigener Lebensraum, ganz woanders’, ’Interpretierte Wahrnehmung’, ’Erfahrung liefert Bilder’, ”Wie das ’Richtige’ Lernen?”, ’Mengenbegrenzungen’, ’Mustererkennen’, ’Spezialisierungen’, ’Wechselwirkungen aufdecken’, ’Geeignete Wissensformen’, ’Verloren im Fragment’, ’Fehlende Präferenzen’ sowie ’Menschenbilder’ fragt der Schlussabschnitt: ’Was Tun?’ Dort kann man lesen:

Es ist eines, einen Sachverhalt zu diagnostizieren. Es ist eine ganz andere Frage, ob man aus solch einer Diagnose irgendeinen Handlungsvorschlag generieren kann, der eine deutliche Verbesserung mit sich bringen würde.

Angesichts der zentralen Bedeutung des Wissens für das Verhalten des Menschen eingebettet in Präferenz/ Bewertungsstrukturen, die in einem Lernprozess verfügbar sein müssen, bei gleichzeitiger Berücksichtigung der quantitativen Beschränkungen des biologischen Systems bräuchte es neue Lernräume, die solch ein verbessertes Lernen unterstützen. Ganz wichtig wäre es dabei, das Wissen nicht nur ’jenseits des Individuums’ zu kumulieren (die Cloud für alle und alles), sondern den einzelnen als einzelnen zu stärken, auch als soziales Wesen. Dazu braucht es eine grundlegende Re-Analyse dessen, wie der Mensch mittels neuer digitaler und Cyber-Technologien sowie Humantechnologie seinen Möglichkeitsraum vergrößern kann. Dies wiederum setzt voraus, dass es eine Vision von Gesellschaft der Zukunft gibt, in der der homo sapiens überhaupt noch eine Rolle spielt.

Dies wird gerade von elitären Machtgruppen immer mehr in Frage gestellt.

Wo gibt es ernsthafte Visionen für humane Gesellschaften für Morgen?

Diese Aufgabenstellung ist nichts für einen allein; hier sind alle, jeder auf seine Weise, gefragt.

12) Nr. 411 vom November 2017: WAHRHEIT ALS UNABDINGBARER ROHSTOFF EINER KULTUR DER ZUKUNFT

Hier wird aufgezeigt, dass eine Kultur der Zukunft ohne Wahrheit unmöglich ist. Wahrheit ist der entscheidende, absolut unabdingbare Rohstoff für eine Kultur der Zukunft… die zentrale Bedeutung von Kommunikationsprozessen …Diese sollten so sein, dass alle Beteiligten des politischen Diskurses in der Lage sind, die möglichen Ziele und Argumente dafür und dagegen, die sie sprachlich austauschen, auf ihren Sachgehalt hin soweit klären zu können, dass alle Beteiligten nachvollziehen könnten, was damit gemeint ist und warum diese Maßnahmen mit Blick auf die Zukunft Sinn machen. … besondere Rolle des homo sapiens in der Evolution…

13) Nr. 416 vom Januar 2018: WENN PHILOSOPHISCHE SACHVERHALTE POLITISCH RELEVANT WERDEN...

Die Freilegung von Wahrheit durch philosophisches Denken bleibt wirkungslos, wenn das Alltagsdenken – und die Politik gehört dazu – sich der Wahrheit verweigert. … … Zu internen Bildern von der Welt zu kommen, die angemessen sind, die wahr sind, ist zwar nicht einfach, verlangt einen großen gemeinschaftlichen Aufwand, ist aber grundsätzlich bei aller bleibenden Vorläufigkeit möglich. Zugleich wurde auch klar, wie leicht das Erarbeiten von angemessenen Weltbildern von einer Vielzahl von Faktoren im individuellen wie auch im gemeinschaftlichen Einflussbereich gestört werden kann, so massiv, dass die Bilder unangemessen/ falsch werden können. … Obwohl Philosophen in vielen Jahrtausenden und Kulturen sich daran versucht haben, das Phänomen der Wahrheit zu fassen, gibt es bis heute kein philosophisches Konzept der Wahrheit, das in allen philosophischen Schulen, in allen Kulturen einheitlich verstanden und akzeptiert ist. Man hat eher den Eindruck, dass gerade die neuere Philosophie – sagen wir seit Ludwig Wittgenstein, um mal einen Referenzpunkt zu nennen – das Konzept von Wahrheit eher wieder aufgegeben hat…

Szenenwechsel: Demokratie in den USA: nicht die demokratischen Strukturen versagen, sondern die Akteure, die diese demokratische Strukturen leben, diese haben Weltbildern in ihren Köpfen, die hochgradig falsch erscheinen gemessen an dem Wissen, das wir heute über unsere Welt und unsere Prozesse haben können. Und von den vielen potentiellen Wählern, die durch ihre Wahlentscheidung mit entscheiden, welche Akteure zu den zeitlich begrenzten politischen Verantwortlichen werden können, scheint eine hinreichend große Menge an diesen falschen Weltbildern zu partizipieren…. die Ungleichzeitigkeit von unterschiedlichen Weltbildern, Spielmasse für Demagogen… …

Moderne, wahrheitsfähige Wissensformen entstehen zu einem großen Teil – idealerweise – in Schulen und Hochschulen. Wissen, das hier nicht vermittelt wird, wirkt sich mit seinem Fehlen oder mit seinen falschen Formaten unmittelbar auf die gesamte Gesellschaft aus. … Obwohl der Homo sapiens die erste Lebensform im beobachtbaren Universum ist, die überhaupt wahrheitsfähig ist, ringt dieser Homo sapiens bis heute damit, wie er seine Wahrheitsfähigkeit im komplexen Geflecht einer immer dichteren Weltgesellschaft mit so vielen unterschiedlichen Kulturen und der immer größeren Beschleunigung in der Technologieentwicklung erhalten, bewahren und weiter entwickeln kann. Die Besonderheit dieser Situation liegt darin, dass sich dieses Problem nicht im Alleingang lösen lässt.

Wahrheit ist ein kognitives Gebilde in einem Individuum, das mit der umgebenden Welt und den kognitiven Gebilden der anderen Individuen koordiniert werden muss…

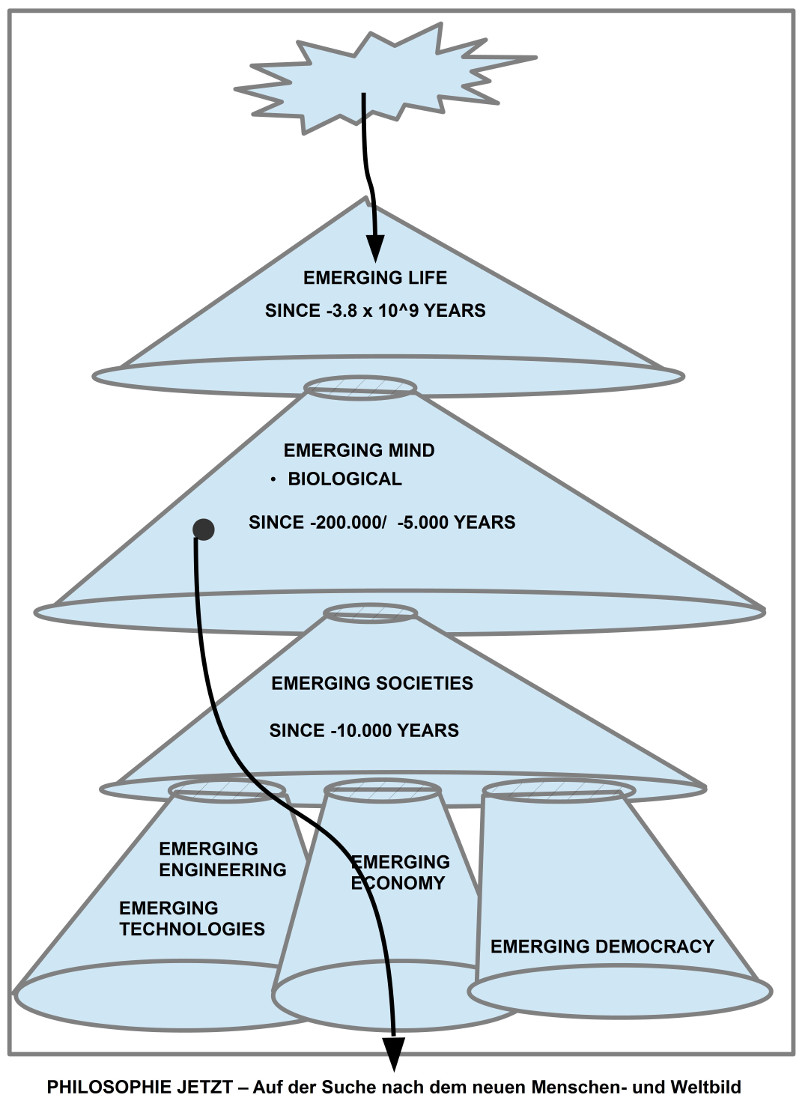

14) Nr. 418 vom Februar 2018: INFORMELLE KOSMOLOGIE – Und die Mensch-Maschine Frage

Man kommt nicht umhin sich Klarheit darüber zu verschaffen, was einerseits mit dem Begriff ’Mensch’ gemeint ist und andererseits mit dem Begriff ’intelligente Maschine’… Menschliches Denken sammelt Eindrücke der Welt ein, Kombiniert sie, und handelt danach, das kann schief gehen…. Zerklüftete Wissenschaften, Erfindung neuer Sprachen, insbesondere Mathematik, Schaubild Weltstruktur (Ontologie!)… Die Abfolge der Entstehung von Komplexitätsebenen geschieht NICHT rein zufällig…

Zauberwort ’Kooperation’… Werkzeuge, Technologie, Computer … Kognitive und emotionale Grenzen des Menschen … Welche Ziele – Präferenzen – Werte? Woher? Jenseits von Mutter Erde…

15) Nr. 419 vom Februar 2018: INFORMELLE KOSMOLOGIE. Teil 2. Homo Sapiens und Milchstraße Komplexität des menschlichen Körpers im Vergleich zur Milchstraße … Zusammenhang durch Funktionen… Gehirn so winzig… Bewusstsein: Paradox Physiologie – Qualia; Freier Wille und Freiheit.