Journal: Philosophie Jetzt – Menschenbild, ISSN 2365-5062

12.April 2018

URL: cognitiveagent.org

Email: info@cognitiveagent.org

Autor: cagent

DER BEOBACHTER

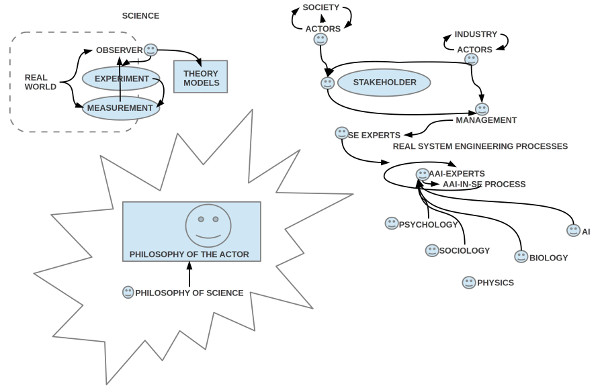

In den Wissenschaften ist klar, dass es ohne einen Beobachter nichts gibt: keine Experimente mit Messungen, die Daten generieren, und keine Modelle, Theorien, die Daten in Zusammenhänge setzen und damit Deutungs- oder gar Erklärungshypothesen liefern.

Weniger klar ist, dass und wieweit der Beobachter konstitutiv in eine Theorie eingeht und dass eine ’normale‘ Theorie nicht in der Lage ist, ihren eigenen Beobachter zu thematisieren.

Besonders krass ist der Fall in der Physik. Die standardisierten physikalischen Messeinheiten erlauben interessante Modellbildungen zu Strukturen und Dynamiken der realen Welt, es ist mit diesen Daten und Modellen jedoch nicht möglich, den physik- spezifischen Beobachter angemessen zu beschreiben.

Andere Disziplinen wie z.B. die Biologie, die Psychologie oder die Soziologie kommen den komplexen Phänomenen eines Beobachters zwar ’näher‘, aber auch diese – wenn sie denn als empirische Wissenschaften arbeiten – können ihre jeweiligen spezifischen Beobachter nicht mir eigenen ‚Bordmitteln‘ erschöpfend beschreiben. Würden sie es tun, würden sie ihr Wissenschaftsparadigma sprengen; dann müssten sie aufhören, empirische Wissenschaften zu sein.

IRREFÜHRUNG INTERDISZIPLINARITÄT

Im übrigen muss man auch fragen, ob nicht alle Disziplinen auf ihre spezifische Weise Sichten zum Beobachter entwickeln, die jeweils spezifisch ‚Recht‘ haben. Nur eine Zusammenschau aller dieser verschiedenen Sichten würde dem komplexen Phänomen ‚Beobachter‘ gerecht, wenngleich prinzipiell unvollständig. Allerdings wäre keine der einzelnen Disziplinen je für sich in der Lage, eine ‚Gesamtschau‘ zu organisieren. Das gibt der normale Theoriebegriff nicht her. Das Reden vom ‚Interdisziplinären‘ ist insofern eine Farce. Hier wird eine Disziplinen-Übergreifende Einheit angedeutet, die es zwischen Einzeldisziplinen prinzipiell nicht geben kann (und auch in der Praxis nie erreicht wird; das scheitert schon an den verschiedenen Sprachen der Disziplinen).

ROLLEN

In der Praxis der Gesellschaft und der Industrie manifestiert sich das Dilemma des versteckten Beobachters im Phänomen der unterschiedlichen Rollen. An einem Systems-Engineering Prozess (SEP) kann man dies verdeutlichen.

Die Manager eines SEP legen Rahmenbedingungen fest, geben Ziele vor, überwachen den Ablauf. Der Prozess selbst wird von unterschiedlichen Experten (Akteuren) gelebt. Diese Experten setzen den ‚durch die Manager gesetzten Rahmen‘ für die Dauer des Prozesses voraus, als gültiges Referenzsystem, innerhalb dessen sie ihre Problemlösung in Kooperation mit anderen Akteuren ‚leben‘.

Innerhalb eines SEP gibt es Akteure , z.B. die Mensch-Maschine Interaktions (MMI) Experten, heute auch schon Akteur-Akteur-Interaktions (AAI) Experten genannt (Akteure können Menschen (biologische Systeme) oder auch mittlerweile Roboter (nicht-biologische Systeme) sein. ‚Cyborgs‘ bilden neuartige ‚Zwitterwesen‘, wo noch nicht ganz klar ist, ob es ‚erweiterte biologische Systeme‘ sind oder es sich hier um eine neue hybride Lebensform als Ergebnis der Evolution handelt). Die MMI oder AAI Experten entwickeln Konzepte für ‚potentielle Benutzer (User)‘, also ‚andere Akteure‘, die in ‚angedachten Abläufen‘ mit ‚angedachten neuen Schnittstellen (Interface)‘ aktiv werden sollen. Werden die Pläne der AAI Experten akzeptiert und realisiert, entstehen für die angedachten Abläufe neue Schnittstellen, mit denen dann andere – dann ‚reale‘ – Akteure‘ arbeiten werden. Tritt dieser Fall ein, dann übernehmen die ‚Anwender (User)‘ einen ‚von anderen Akteuren gesetzten‘ Rahmen für ihr Handeln.

Vom Auftraggeber (Ebene 1) zum Manager eines SEP (Ebene 2) zu den Experten des SEP (Ebene 3) zu den intendierten Anwendern (Ebene 4). Wie sich dies dann wieder auf die umgebende Gesellschaft (Ebene 5) auswirkt, die sowohl Auftraggeber (Ebene 1) als auch Manager von Prozessen (Ebene 2) als auch die verschiedenen Experten (Ebene 3) beeinflussen kann, ist im Normalfall weitgehend unklar. Zu vielfältig sind hier die möglichen Verflechtungen.

Andere Querbeziehungen in einen SEP hinein (kleine Auswahl) treten dort auf, wo z.B. die AAI Experten andere Wissenschaften zu Rate ziehen, entweder über deren ‚Produkte‘ (Artikel, Bücher, Verfahren) oder direkt durch Einbeziehung der Akteure (Psychologie, Psychologen, Soziologie, Soziologen, usw.).

An keiner Stelle in diesem überaus komplexen Rollengeflecht gibt es normalerweise eine Rolle, die offiziell sowohl die spezifischen Aufgaben ‚innerhalb‘ einer Rolle wie auch die ‚Rolle selbst‘ beobachtet, protokolliert, untersucht. Eine solche Rolle würde jeweils vorgegebene Rollen ‚durchbrechen‘, ‚aufbrechen‘, ‚verletzten‘. Das verwirrt, schafft Unruhe, erzeugt Ängste und Abwehr.

HOFNARREN, PHILOSOPHEN

Andererseits gibt es historisch diese Formen in allen Zeiten. In der einen Form ist es der ‚Hofnarr‘, der kraft seiner Rolle grundsätzlich anders sein darf, dadurch feste Muster, Klischees durchbrechen darf, bis zum gewissen Grad wird dies auch erwartet, aber nur bis zu einem gewissen Grad. Unterschwellige Machtstrukturen dürfen in der Regel nicht angetastet werden.

In der anderen Rolle haben wir die Philosophen. Das philosophische Denken kann das einzelwissenschaftliche Denken ‚imitieren‘, es kann aber jederzeit aus diesem Muster ausbrechen und nach den Voraussetzungen des einzelwissenschaftlichen Denkens fragen. Ein Philosoph kann — von seinem Denken her — die immer und überall wirksamen ‚Voraussetzungen‘ von Verhalten und Denken ‚hinterfragen‘, ‚thematisieren‘ und auf diese Weise einer expliziten Reflexion und sogar bis zu einem gewissen Grade einer Theoriebildung zugänglich machen. Der Philosoph als Teil einer Gesellschaft mit seiner Nähe zum ‚Hofnarren‘ darf meistens aber nur soviel anders sein (Schulphilosophie), die die Gesellschaft ihm zugesteht. Vom Standpunkt eines philosophischen Denkens aus kann man unterschiedliche einzelwissenschaftliche Modelle und Theorien ‚als Objekte‘ untersuchen, vergleichen, formalisieren und man kann auf einer ‚Metaebene‘ zu den Einzelwissenschaften ‚integrierte Theorien‘ schaffen; nur so. Interdisziplinarität ist von hier aus betrachtet eine Form von Ideologie, die genau solche Integrationen verhindert.

WISSENSCHAFTLICHE EINZELSTAATEREI

Der Versuch der Einzelwissenschaften, sich der ‚Gängelei‘ eines philosophischen Denkens zu entziehen, führt bei aller Positivität der einzelwissenschaftlichen Erkenntnisse zu dem großen Wirrwarr, das wir heute um uns herum beobachten können. Ein komplexes Phänomen wie der Homo sapiens wird zwischen den einzelwissenschaftlichen Mühlsteinen zu Sand zerrieben; übrig bleibt nichts. Die verschiedenen biologischen, psychologischen, neurologischen, soziologischen usw. ‚Substrate‘ bilden unterschiedliche Zerrformen, die in keinem Gesamtbild integriert sind. Das kommt einer Abschaffung des Menschen durch den Wissenschaftsbetrieb gleich. Dies erinnert ein wenig an den kleinstaatlichen Flickenteppich, bevor Deutschland ein integrierter Staat wurde; jeder war sein eigener Fürst; sehr schön; komplexere Einheit fand nicht statt. Das menschliche Gehirn bevorzugt Vereinfachungen, und das subjektive Machtgefühl eines jeden fühlt sich geschmeichelt, wenn es sich als (wenn auch kleiner und beschränkter) ‚Fürst‘ fühlen kann.