ÜBERBLICK

Voraus ging ein anderer Beitrag, siehe HIER.

Im Folgenden weitere Aspekte zur Wiederentdeckung Gottes auf dem Planet Erde … Wir sind da. Die Dinge sind da. Wir selbst sind ein ‚Ding‘. Raum und Zeit. Konservierte Zeit.

WAS DA IST

Naturgesetz im Alltag

- Wenn etwas, was da ist, so da ist, weil es nach unserem Verständnis einem ‚Naturgesetz‘ folgt, dann ist es nach unserem alltäglichen Verständnis erzwungener Maßen da, notwendigerweise, deterministisch. Bei gleichen Voraussetzungen würde es immer genau so sich wiederholen. Der berühmte Apfel löst sich aus dem Baum, fällt ’nach unten‘ und bleibt liegen.

Gegenstand im Raum

- Und es ist auch wahr, dass in unserem alltäglichem Erleben der Apfel nicht isoliert vorkommt sondern als abgrenzbares Etwas in dem, was wir ‚Raum‘ nennen; an derselben Stelle, an der sich der Apfel befindet, kann kein zweiter Apfel sein, und der Apfel hat eine ‚Umgebung‘, die wir hemdsärmelig mit ‚Oben‘, ‚Unten‘, ‚links‘, ‚rechts‘, ‚vorne‘ und ‚hinten‘ usw. beschreiben. In unserem alltäglichen Raum fällt der Apfel immer nach ‚unten‘, nie nach ‚oben‘.

- Auf den Apfel können wir als Gegenstand, als Objekt hinweisen, ihn abgrenzen von seiner Umgebung; auf den Raum können wir nicht direkt hinweisen; der Raum ist kein Objekt wie der Apfel. Der Raum ist wie eine Art ‚Behälter‘ aber ohne Begrenzung. Für uns erscheint der Raum in der alltäglichen Erfahrung quasi ‚unendlich‘. Wir sprechen über den Raum relativ durch Bezug über das, was ‚in dem Raum‘ vorkommt. Wir kennen ‚Objekte‘ nur als ‚in einem Raum vorkommend‘. Die Erfahrung von Objekten und Raum ist simultan.

- Was ist, wenn jemand blind ist, absolut nichts sieht? Ist der Raum dann weg?

- Wenn wir unsere Augen schließen können wir (im Normalfall (was ist ’normal?)) mit unseren Händen Oberflächen spüren, denen wir durch Bewegung unserer Finger, Hände, Arme, eventuell auch des Körpers, folgen können. Die Bewegung unseres Körpers verändern die jeweilige ‚Stellung‘ von Körperteilen, Muskeln, Knochen… Diese ‚Stellungen‘ sind subjektiv, sie spiegeln sich ‚in uns selbst‘ wieder; wir können sie im Erleben unterscheiden. ‚In uns‘ versammeln wir alle diese Erlebnisse unterschiedlicher Stellungen und können sie ‚in Beziehung‘ setzen: wenn das Objekt selbst sich nicht verändert, dann sind diese Stellungen nicht beliebig. Das Verhältnis der verschiedenen erlebbaren Stellungen bildet ein Beziehungsgeflecht, das man auch als ‚räumlich‘ interpretieren kann, das dann auch ein ‚oben‘, ‚unten‘, ‚links‘ und ‚rechts‘ usw. zulässt. Die unterschiedlichen Stellungen markieren dann in diesem Beziehungsgeflecht eine ‚Position‘. Mit anderen Worten: auch ohne Sehen, nur mit unseren körperlichen Bewegungen zusammen mit den Tastempfindungen ist unser Erleben von etwas anderem, von Gegenständen, von Objekten, mit der ‚Vorstellung eines Raumes‘ verbunden.

- Wenn wir ‚Sehen‘ und ‚Tasten‘ können, dann lässt sich der ‚Seh-Raum‘ und der ‚Tast-Raum‘ miteinander in Beziehung setzen.

Wir sind auch ein Objekt

- Eine Besonderheit ist, dass wir in beiden Räumen ‚uns selbst‘, ‚unseren Körper‘ als Teil des Raumes, als Gegenstand neben anderen Gegenständen erleben können. Wir erleben uns als Gegenstand, als Objekt in einem ‚Raum‘ von vielen Objekten. Die Gegenstände erscheinen als ‚endlich‘, der Raum als ‚unendlich‘.

Sprache kann verbinden

- Wenn wir weder sehen noch tasten können, wird es schwierig. Mir persönlich versagt da die Vorstellung, und unsere Sprache verliert den Weltbezug, den sie braucht, um zwischen verschiedenen Menschen zu funktionieren. Was immer ein einzelner Mensch ‚in sich‘ erlebt, sofern jeder Mensch als Objekt in einem Raum von Objekten vorkommt, den er mit einem anderen Menschen teilt, so lange kann er mittels der Sprache ein gemeinsames Bezugssystem aufspannen, innerhalb dessen er sich selbst und sein Erleben ‚verorten‘ kann.

Zeit subjektiv

- Die Situation des fallenden Apfels lässt aber noch mehr erkennen. Es ist nicht nur ein ‚Raum‘, der sich mit dem Apfel zum Erleben bringt, es ist auch etwas, das wir ‚Zeit‘ nennen.

- Wie selbstverständlich sagen wir im Alltag, dass der Apfel ‚zuerst‘ am Baum war, und ‚dann‘, ’später‘ auf dem Boden lag. Wir verfügen (als Menschen) über die Fähigkeit, nicht nur den ‚jeweiligen Augenblick‘ erleben zu können, sondern wir können auch ‚vergangene Augenblicke erinnern‘, weil wir uns Erlebnisse ‚merken‘ können (nicht unbedingt 1-zu-1), und weil wir ‚vergangene Augenblicke‘ erinnern können, können wir zwischen einem ‚aktuellen Augenblick‘ und einem ‚erinnerten Augenblick‘ vergleichen. Im aktuellen Augenblick liegt der Apfel z.B. auf dem Boden, wir können aber erinnern, dass es einen Augenblick gab, da war der Apfel noch am Baum, also ‚vorher‘ an einer anderen Position im Raum als ‚jetzt‘.

Konservierte Zeit

- Diese Unterscheidung von ‚vorher‘ und ’nachher‘ relativ zu einem ‚jetzt‘ können wir erleben, weil wir erinnern können. In der Welt des Raumes für sich, ohne das menschliche Erleben, gibt es nur ein Jetzt! Die Raumwelt ist reine Gegenwart, allerdings, wenn man die Gegenwart der Raumwelt ‚lesen‘ kann, dann kann man in der Gegenwart der Raumwelt ‚Hinweise‘ finden, ‚Indizien‘, die auf eine ‚andere (vorausgehende) Gegenwart‘ hindeuten können. In der Gegenwart des Raumes ist die Zeit des Entstehens quasi ‚konserviert‘, ‚eingefroren‘, ‚eingebrannt‘ in die Welt. Die Raumwelt enthält ihre ‚Geschichte‘ quasi ‚in sich selbst‘, ‚an sich‘.

- Am Beispiel des fallenden Apfels ‚lernt‘ schon jedes Kind, dass Äpfel, die am Boden liegen, vorher am Baum hingen und dann irgendwann herunter fallen. Wenn also ein Kind einen Apfel liegen sieht, erinnert es sich an die ‚Regel‘ die es gelernt hat, und schließt vom Apfel am Boden mittels dieser Regel darauf, dass es ‚vorher‘ einen Zustand gegeben hat, bei dem der Apfel am Baum war. Mit der gelernten Regel wird der Apfel am Boden zu einem Anzeichen, einem Hinweis, einem Indiz, dass es vorher einen anderen Zustand gegeben hat.

- Es war eine große Sternstunde der menschlichen Wissenschaft, als die Geologen — wie jedes Kind — lernten, in der Gegenwart der Erde ‚Spuren‘, ‚Hinweise‘, ‚Indizien‘ zu entdecken, die darauf hindeuteten, dass aktuelle Erdschichten ‚Ablagerungen‘ sind aus vorausgehenden Zeiten, und dass diese Ablagerungen mit ihren spezifischen Eigenschaften Hinweise enthalten auf die Besonderheiten dieser vorausgehenden Zeiten.

- So konnten die Geologen durch Vulkane der Gegenwart lernen, wie ihre Ablagerungen aussehen, und dadurch auf Vulkane der Vergangenheit schließen. Durch die Meere der Gegenwart konnte man auf Meere der Vergangenheit schließen, die oft da waren, wo heute Land ist oder gar Wüste. Und sie entdeckten, dass die heutigen Kontinente in Bewegung sind; dass sie vor vielen Millionen Jahren anders angeordnet waren. Dass sich das Klima im Laufe von vielen Milliarden Jahren mehrfach dramatisch geändert hatte; es gab allein in den letzten 2.5 Millionen Jahren abwechselnd 50 Kalt- und Warmzeiten, und insgesamt gab es viele große Eiszeiten mit Dauern von Millionen von Jahren. Dabei schwankte die ‚Höhe‘ des Meeresspiegels um viele hundert Meter. Und vieles mehr.

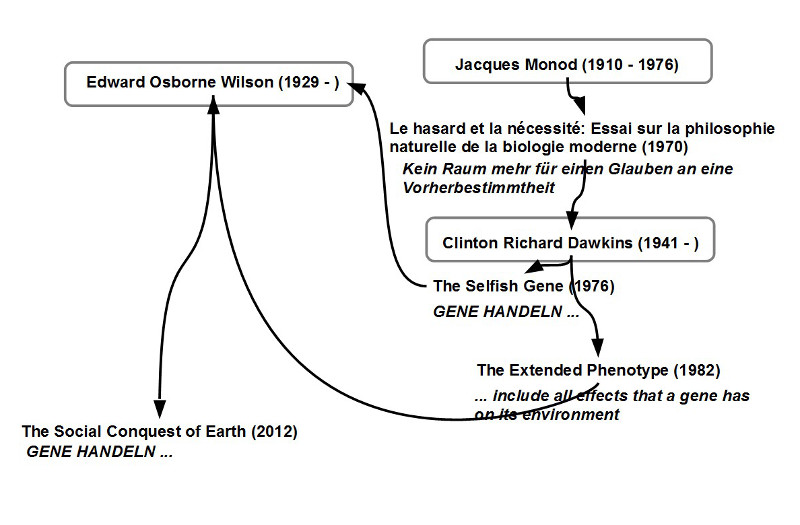

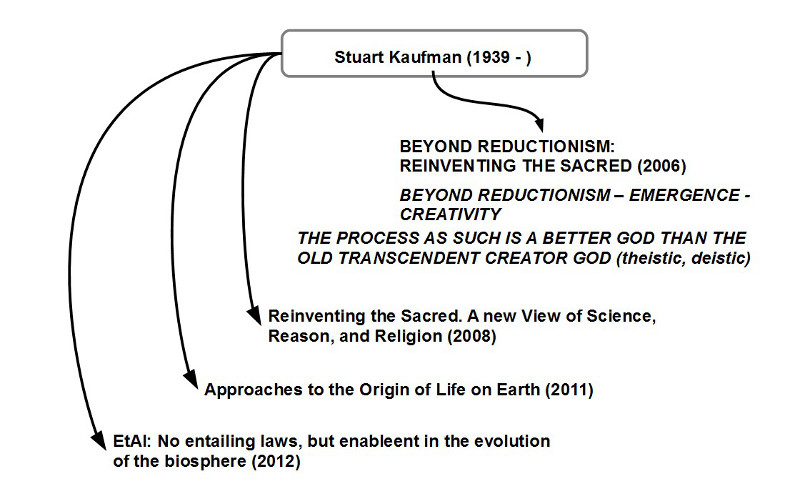

- Parallel zu den Geologen konnten dann auch die Biologen die Funde aus den verschiedenen Ablagerungen verschiedenen Zeiten zuordnen und so schrittweise entdecken, dass die Formen des Lebens sich seit mindestens 3.5 Milliarden Jahre beständig verändert haben. Von unfassbar klein und vielfältig bis immer komplexer, mit großen dramatischen Einbrüchen bedingt durch dramatische Veränderungen der Geologie und des Klimas (Supervulkanausbrüche, Asteroideneinfall auf der Erdoberfläche, lange Eiszeiten, Trockenheiten, …). Seit kurzem können die Biologen auch über die Struktur der Zellen und Moleküle Beziehungen zwischen den verschiedenen Lebensformen über ihre direkte biologische Abstammung aufgrund ihrer ‚Baupläne‘ untersuchen; vorher waren sie allein auf den Körperbau und das Aussehen (den Phänotyp) angewiesen.

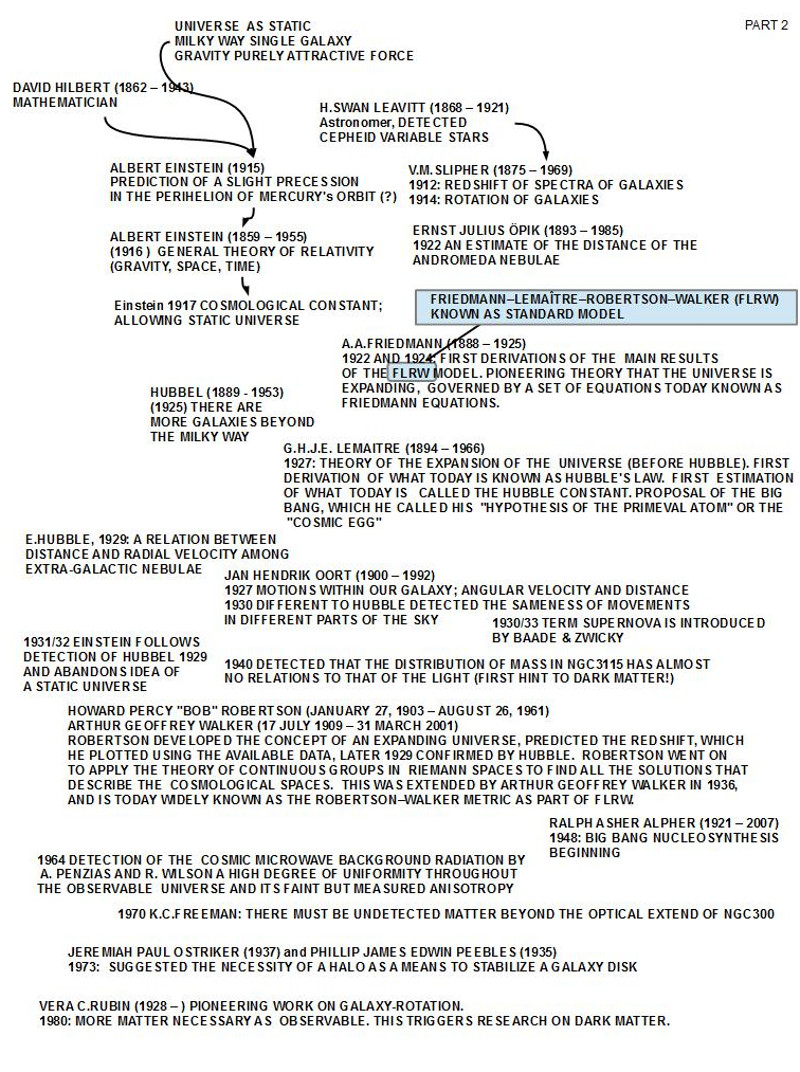

- Und noch mehr. Parallel zu Geologie und Biologie haben auch die Physiker entdeckt, dass es in der Gegenwart des physikalischen Universums Hinweise auf eine mögliche Vergangenheit gibt. Und, wie so oft, wenn erst einmal eine Entdeckung gemacht wird, zieht diese viele weitere nach sich. Schrittweise konnte man rekonstruieren, dass das Universum sich immer noch ausdehnt, von daher zurück verweist auf einen physikalischen Anfangspunkt, den man ‚Big Bang‘ nannte, von dem aus sich Energie in Teilchen verwandelte, Atome, Moleküle, dazu gigantische Gaswolken, Sternenbildung, Bildung von Galaxien und Superclustern, Neuwerdung von Sternen, aber auch das Sterben von Sternen, Verschmelzung von Galaxien, und vieles mehr.

- Zu beachten ist hier, dass die subjektive Zeit des Erlebens und die Zeit der Physik zwei verschiedene Sachverhalte bezeichnen.

Technische Zeit: Uhren

- Die subjektive Zeit des Erlebens basiert auf der Erinnerung von vorausgehenden Augenblicken und erlaubt durch Vergleich von aktuellem Jetzt und erinnertem Jetzt eine ‚relative‘ Bestimmung von ‚Vorher‘ und ‚Nachher‘. Dieses ‚Vorher-Nachher‘ lässt sich mit konkreten Objekten und deren Eigenschaften verknüpfen, z.B. auch mit periodischen Vorgängen in unserem Erlebnisraum wie ‚Wachen – Schlafen‘, ‚Tag und Nacht‘, ‚Jahreszeiten‘ oder auch Vorrichtungen zur künstlichen Erzeugung von periodischen Ereignissen, die wir ‚Uhren‘ nennen.

- In der Physik gibt es kein ’subjektives Erleben‘ (nur indirekt, über das Erleben der Physiker, das aber ausgeklammert werden soll). Wenn die Physik von ‚Zeit‘ spricht, dann nur als ein theoretischer Begriff innerhalb einer formalen Theorie, die sich mit einer definierten Messprozedur zur empirischen Welt in Beziehung setzen lässt. Und hier gibt es in der Physik mindestens zwei Szenarien.

- In dem einen Szenario hat die Physik z.B. die Zeitdauer von ‚1 Sekunde‘ an Eigenschaften einer technischen Vorrichtung gekoppelt, die man ‚Atomuhr‘ nennt. Innerhalb eines bestimmten Genauigkeitsgrades sind alle Atomuhren ‚gleich‘ (andererseits, wenn eine Atomuhr in Nordamerika steht, eine andere in Europa, wieder eine andere in Asien, usw., dann erfordert die Abstimmung der ‚Gleichzeitigkeit‘ eine Kommunikation zwischen den Betreibern der Atomuhren. Diese Kommunikation erfolgt mittels elektromagnetischer Wellen durch die Atmosphäre. Diese Kommunikation ist um Dimensionen langsamer und ungenauer als die Atomuhren selbst. Dennoch sprechen die zuständigen ‚Behörden für die Zeit‘ (meistens die nationalen metrologischen Institute) von einer gleichen Zeit. (Es ist eine interessante Aufgabe, zu verstehen, wie dies möglich ist). Ferner ist zu beachten, dass der Alltag der Menschen primär natürlich nicht von den Atomuhren bestimmt wird, sondern von den Tag-Nacht Perioden und den Jahreszeiten, auf die auch alle Kalender aufbauen. Die Physik muss also ihre Atomuhren-Zeit mit den Erdzeiten abgleichen. Da die Erdzeiten nicht vollständig exakt zu der Atomzeit passen, müssen immer wieder ‚Zeit-Ausgleiche‘ vorgenommen werden. Im Alltag haben wir die Kalender und unsere ‚Normaluhren‘, hinter der Oberfläche haben wir aber eine exakte Atomzeit, die den Physikern hilft, die Zeit des Alltags immer wieder auszutarieren.

Die Zeit des Lichts

- Mitten in einem schier unendlich erscheinenden Universums wird das Beobachten zu einem Problem: wenn alles in Bewegung ist, wo ist der gemeinsame, stabile Bezugspunkt? Im Alltag setzen wir voraus, dass die Situation, das Land, die Erde ’stabil‘ genug ist, so dass wir diese Umgebung als gemeinsamen Bezugspunkt benutzen können (Landkarten, Navis, …). Im Universum gibt es aber keinen festen Punkt; alles bewegt sich, auch der Beobachter auf der Erde, die sich um sich selbst dreht, die sich zur Sonne hin unterschiedlich neigt, die sich um die Sonne bewegt, und der Beobachter bewegt sich auf der Erde, vielleicht fliegt er mit einem Flugzeug, einem Raumschiff … Woran soll man sich hier noch festmachen?

- Glücklicherweise konnten die Physiker herausfinden, dass das Licht eine konstante Geschwindigkeit c hat (siehe: \url{https://de.wikipedia.org/wiki/Lichtgeschwindigkeit}). Je nach dem umgebenden Medium kann sich diese zwar verringern, aber man kann für jedes Medium ermitteln, wie stark das Licht verlangsamt wird, so dass man am Ende heraus rechnen kann, wie schnell das Licht unterwegs war und ist. Mit diesem Wissen kann man unter Berücksichtigung der verschiedenen Beobachter dann Entfernungen fixieren und eine Gleichzeitigkeit ermitteln. Im mathematischen Konzept der Raum-Zeit hat Einstein diesen Überlegungen mit seiner speziellen Relativitätstheorie (SRT) einen konzeptuellen Rahmen gegeben.

- Wie schon angemerkt, kann die Umgebung des Lichts dessen Geschwindigkeit verändern. Eine besondere Beeinflussung geschieht auch durch die sogenannte ‚Gravitation‘, die durch die Masse der Körper aufeinander stattfindet. Die Gravitation kann den Weg des Lichts im Raum beeinflussen, indem es dieses ‚ablenkt‘. Das Licht breitet sich dann nicht ‚gerade‘ aus, sondern wird ‚gebogen‘. Für einen Beobachter bewirkt dies, dass er die Lichtquelle (ein Stern) mit einer anderen Form/ Gestalt wahrnimmt, als sie tatsächlich hat. Um diese besondere Wirkung der Gravitation berücksichtigen zu können hat Einstein dann den begrifflichen Rahmen der speziellen Relativitätstheorie zur allgemeinen Relativitätstheorie (ART) erweitert. Das Konzept der Raum-Zeit wurde durch den Aspekt der Raum-Zeit-Krümmung erweitert, d.h. man gab dem physikalischen Phänomen der Beeinflussung der Lichtbahn durch die Gravitation eine mathematische Deutung als ‚Krümmung‘ in einem geometrischen Modell.

- Obwohl mit der speziellen wie mit der allgemeinen Relativitätstheorie bislang sehr viele physikalische Phänomene ‚erklärt‘ werden konnten, indem man sagen konnte, dass das B, was man im aktuellen Augenblick beobachten kann, von einem vorausgehenden A kommt, und der Weg von A nach B durch die spezielle oder der allgemeinen Relativitätstheorie beschrieben werden kann, herrscht in der Physik die Überzeugung, dass man noch nicht am Ende der theoretischen Erklärungen angekommen sei, da eine Vereinigung der Quantenphysik und der allgemeinen Relativitätstheorie noch ausstehe.

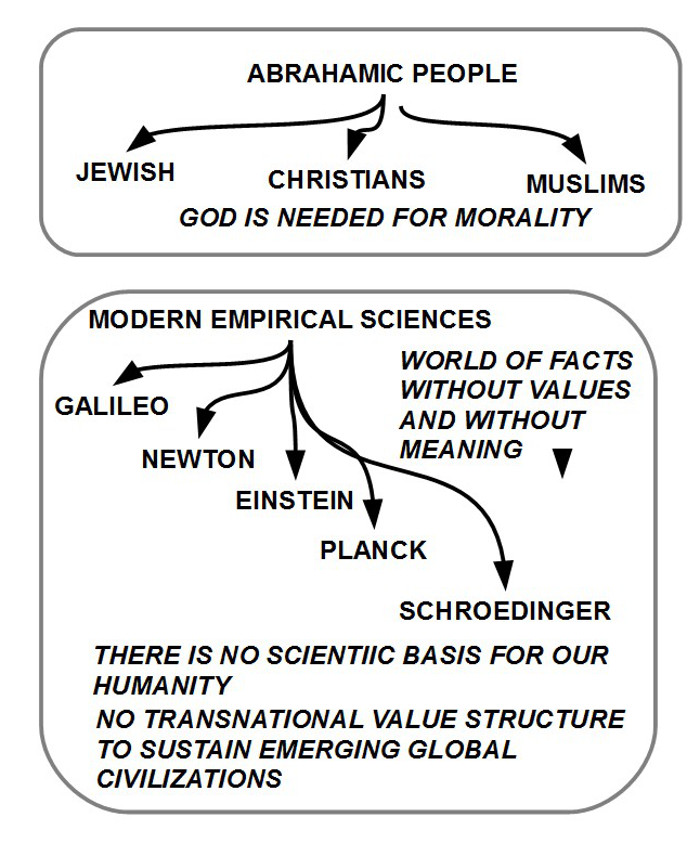

UND WIR?

- Wenn man den Gesprächen der Physiker lauscht, dann kann man ergriffen werden von einem großen Wundern und Staunen über dieses Universum, seinen unfassbaren Dimensionen, die uns umgeben. Zugleich kann es auch nieder schmettern, das Gefühl einer tiefen Verlorenheit erzeugen, wir, auf dieser Erde, so winzig in einer Galaxie, diese so winzig in einem Meer von Galaxien, alles auseinander fliegend … und man selbst so klein, so endlich in der Zeit. Was sind schon 100 Jahre Lebenszeit angesichts dieser Millionen, ja Milliarden von Jahren?

Fortsetzung folgt.

KONTEXT BLOG

Einen Überblick über alle Blogeinträge von Autor cagent nach Titeln findet sich HIER.

Einen Überblick über alle Themenbereiche des Blogs findet sich HIER.

Das aktuelle Publikationsinteresse des Blogs findet sich HIER