Vorgeschichte

Dieser Blogeintrag geht zurück auf einen Vortrag, den ich auf der Jahrestagung der deutschen Sektion von YPO (Young Presidents Organization) gehalten habe. Der ursprüngliche Titel lautete „Das Digitale als Synomym für berechenbare Prozesse“. Als der Text zu diesem Vortrag fertig war (am Tag davor) deutete sich schon an, dass der Vortrag eigentlich eine weitere, sogar eine weiterführende Botschaft enthielt, die sich im ursprünglichen Titel nicht so widerspiegelte. Während ich den Vortrag dann hielt wurde mir klar, dass – in der Tat – der eigentliche Inhalt ein anderer war; der ursprüngliche Titel war nicht falsch, aber zu ‚eng‘.

Da ich jeden Vortrag nur einmal halte und mir für den Vortrag immer eine Problemstellung vornehme, die ich selber gerne geklärt haben möchte ohne zum Zeitpunkt er Themenstellung schon zu wissen, ob es wirklich so gehen wird, gibt es immer diese fluktuierenden Überlegungen und Formulierungen vorher, in denen das mögliche Thema um seine finale Gestalt ringt. Bislang war es immer so, dass es unmittelbar vor dem Vortrag eine starke Klarheit gab, im Vortrag selbst und in den anschließenden Fragen das Ganze nochmals heftig ‚aufleuchtete‘ und in den nachebbenden Gedanken und Gesprächen sich dann der ‚finale Gedanke‘ gezeigt hat.

So auch hier. Die benutzten Diagramme sind mit denen im Vortrag identisch, der Wortlaut nicht genau, aber dem Inhalt nach.

Ankündigungstext ohne Leser

Der folgende Text wurde von mir als Ankündigungstext verfasst, wurde dann aber doch nicht publiziert. Er gibt so ein wenig den ‚Flair‘ im Vorfeld wieder:

Wir leben in einer Zeit, in der die Computertechnik immer mehr Bereiche des täglichen Lebens durchdringt, uns in eine Symbiose mit dem Digitalen zwingt, der wir uns nur schwer bis gar nicht entziehen können: Im Haushalt, in der Haustechnik, beim Entwerfen und Bauen von Häusern, in der Musik, beim Fernsehen, bei der Filmproduktion, in den Verwaltungen, in der industriellen Produktion, bei der Verkehrssteuerung, in jedem Auto, in jedem Flugzeug, bei der täglichen Kommunikation,…und, und, und,…. Wie ist dies möglich? Wie kann eine Technologie für uns zu einer Art ‚zweiten Natur‘ werden? Wie kann eine einzige Technologie nahezu alle Lebensbereiche durchdringen? Wie kann Technik Eigenschaften annehmen, die wir eigentlich nur dem Menschen zuschreiben: Wahrnehmen, Begriffe bilden, Schlüsse ziehen, Wiedererkennen, Kreativ sein, Gefühle haben, Ansätze von Selbstbewusstsein? Wo führt dies hin? Wird uns die Computertechnik irgendwann doch überflüssig machen?

In seinem Vortrag wird Prof. Doeben-Henisch diesen Fragen nachgehen. Er führt zurück zum Ursprung des Computers, ins Zentrum der mathematischen Dispute um die Jahrhundertwende, die dann in den Personen von Kurt Goedel und Alan Matthew Turing zum neuen philosophisch-mathematischen Begriff ‚endlicher Prozess‘ bzw. zum Begriff der ‚Berechenbarkeit‘ führten. Der Mensch selbst stand Modell für das mathematische Konzept der Turingmaschine (1936/7), das dann wenige Jahre später zu realen Maschinen führte, die mit Relais, dann Röhren, schließlich mit Halbleitern demonstrierten, dass und wie man ‚rechnende Maschinen‘ bauen kann. Innerhalb von 60 Jahren eroberte diese Technologie die ganze Welt. Die binären Zustände der Computer zeigten sich mächtig genug, sich nahezu alles einzuverleiben: Zahlen, Texte, Bilder, Geräusche, Musik, Objekte, Gebäude, Pflanzen, Tiere, Abläufe, ganze Städte. Zur Zeit versuchen Forscher weltweit, Maschinen mit ‚künstlichem Geist‘ zu schaffen. Als Vorlage dient das menschliche Gehirn. Prof. Doeben-Henisch wird zeigen, warum wir im Moment keine Argumente haben, warum dies nicht gehen könnte.

Die Überlegungen zu den Grundlagen des menschlichen Geistes führen auch hinein in die Frage nach der Natur des Menschen, in seine Geschichte, in die Geschichte der Entstehung des Menschen, in die innere Logik der Evolution des Lebens auf der Erde. Die Forschung hat uns in den letzten 80 Jahren aufregende neue Einblicke in die Struktur des Lebens vermittelt, die wiederum verschränkt sind mit der Entwicklung des bekannten Universums selbst. Man kann sehen, dass das Digitale als lingua universalis berechenbarer Prozesse sich schon im Inneren des Biologischen selbst als ‚Sprache des Lebens‘ findet. Das Leben selbst als großer ‚Computer‘ oder, umgekehrt, der ‚Computer‘ als neue Spielart jenes Prinzips, das wir als Leben bezeichnen?

Dies sind einige der zentralen Themen, die im Vortrag angesprochen werden. Der Vortrag endet mit dem offensichtlichen Faktum der Ko-Evolution von Universum – Erde – biologischem Leben und digitaler Technologie. Was bedeutet dies für uns?

VORTRAG

(Anmerkung: Der geschriebene Text entspricht natürlich nicht exakt dem Wortlaut des frei vorgetragenen Vortrags)

Meine sehr verehrten Damen und Herren,

nachdem Sie in den vorausgehenden Vorträgen schon einiges gehört haben zu den vielfältigsten Phänomenen, die das Digitale in unserem heutigen Alltag hervorbringt, möchte ich mich in meinem Vortrag mehr der Frage nach der Maschinerie hinter diesen Phänomenen widmen. Was sind das für Strukturen, die all dies möglich machen? Welches Prinzip ist so mächtig, dass es all diese verschiedenartigen Phänomene hervorbringen kann, die dem Menschen in seinen Lebensvollzügen immer näher kommen, ja, bisweilen sogar schon zu inneren Bestand von diesen werden?

Für die Beantwortung dieser Frage werde ich Sie mit drei Konzepten bekannt machen, die auf erstaunliche Weise untereinander zusammenhängen: das Konzept der rechnenden Maschine, das neue Bild des Menschen und die Einbettung beider Konzepte in den Gang der Evolution. Und sie werden dann sehen, dass diese Zusammenschau der drei Konzepte etwas ganz Neues aufscheinen lässt, nämlich das Konzept ‚Geist‘ als jene Größe, die in all diesen Prozessen als etwas ‚aufscheint‘, was ’schon immer da ist‘. Würde dieser erste Eindruck zutreffen, dann würde es bei den Versuchen der ‚Erschaffung‘ eines ‚künstlichen‘ Geistes weniger darum gehen, etwas ‚Neues‘ zu ‚erschaffen‘, sondern mehr darum, etwas, das ’schon immer da ist‘, mit neuen Methoden ’sichtbar‘ zu machen.

Ich werde zum Ende daher auch kurz auf ein Experiment hinweisen, in dem wir genau dies tun: den ‚Geist‘ in Form eines ‚künstlichen‘ Geistes sichtbar machen.

Beginnen wir mit uns selbst, dem dem Menschen, dem homo sapiens sapiens.

DER MENSCH

VIELSCHICHTIG

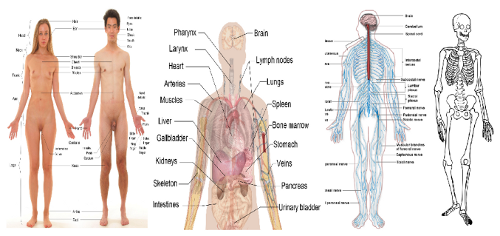

[Bild: vier Sichten des Menschen] Ich möchte mit einem Schaubild beginnen, das zeigt, wie vielschichtig wir Menschen bei näherer Betrachtung sind. Sie sehen einmal links die Oberfläche des Menschen, wie sie sich uns darbietet, wenn wir uns nackt zeigen. Doch bei der Frage, ob wir den Menschen mit dieser Oberfläche gleich setzen sollen, werden wir dies verneinen müssen. Wir wissen heute, dass hinter bzw. unter dieser Oberfläche eine Fülle von hochkomplexen Organen zu finden ist, die durch ihre kontinuierliche Arbeit alle unsere Lebensprozesse ermöglichen. Was wären wir ohne Herz, Nieren, Lunge, Leber, Magen, Darm usw.? Zugleich wissen wir, dass all diese wunderbaren Organe im Chaos enden würden, gäbe es nicht das Nervensystem mit dem Gehirn, das all diese Tätigkeiten – ergänzend zum Blutkreislauf und zum Immunsystem –– koordiniert, anregt, steuert. Und dann noch das augenfällige System von Knochen und Gelenken, in sich ein überaus lebendes System, ohne das alle Haut und Organe in einen Zellklumpen zusammenstürzen würden, der alsbald verenden würde. Vier überaus komplexe Systeme, die vielfach ineinander greifen und in diesem Zusammenwirken das Gesamtkunstwerk menschlicher Körper in seiner Grundstruktur ermöglichen. Wissen wir damit, was und wer der Mensch ist? Haben wir die Psyche, den Geist, die Seele vergessen?

Bevor ich darauf eine Antwort versuche, hier ein kurzer Szenenwechsel. Im Film würden man sagen, ein harter Schnitt.

FORMALISIERUNG DER VIELFALT ALS SYSTEM

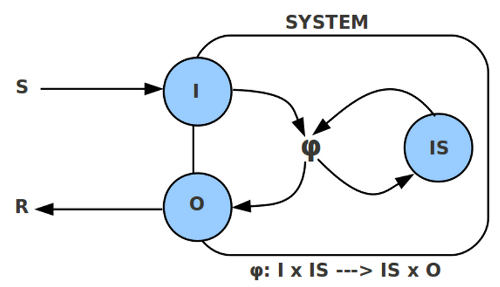

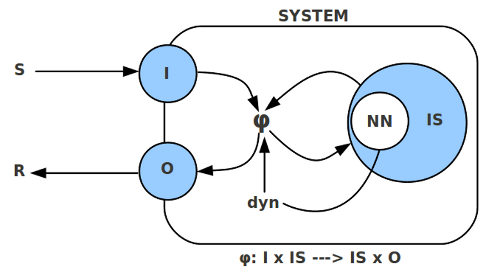

[Bild: Box mit Eingang/ Ausgang und Verhaltensfunktion] Was Sie auf diesem Bild sehen können, ist ein Diagramm und eine kleine Formel.

Dieses Diagramm und diese Formel entspricht ein wenig der Art, wie ein mathematisch geschulter Ingenieur die zuvor präsentierte Vielfalt des Menschen hinschreiben könnte.

Die Box mit Überschrift ‚System‘ kann einen Menschen repräsentieren, der aus seiner Umgebung Stimuli – abgekürzt ‚S‘ – als Input ‚I‘ empfangen kann (also Augen, Ohren, Tastempfindungen usw.) und der über seinen Output ‚O‘ Reaktionen ‚R‘ an die Umgebung abgeben kann, also diverse Bewegungen, Schallereignisse, usw. Im Innern des Systems gibt es verschiedene interne Zustände (internal states, IS), die zum Funktionieren des Systems wichtig sind. Z.B. die diversen Organe, das Nervensystem, die Knochen, usw. Und zwischen all diesen Elementen, dem Input, den internen Zuständen und dem Output, gibt es einen funktionalen Zusammenhang, der im Bild einfach mit dem griechischen Buchstaben ‚phi‘ (Φ, φ) benannt wird.

Alternativ zu solche einem Diagramm würde man aber auch einfach die kürzere Formel hinschreiben, die genau das gleiche zum Ausdruck bringt: der funktionale Zusammenhang ‚phi‘ nimmt Inputwerte und aktuelle Zustände als Ausgangspunkt und berechnet daraus mögliche Änderungen der inneren Zustände und einen Output. Also, Beispiel, sie sitzen in einem Auto und sehen (=Input) eine rote Ampel. Da sie gelernt haben, bei Rot tunlichst stehen zu bleiben (=IS), verändern sie ihre Fußstellung und bremsen (=IS, O).

Dieses kleine Beispiel mag auch ein wenig verdeutlichen, wie Ingenieure vorgehen, wenn sie die vielfältige Wirklichkeit mit der Sprache der Mathematik vereinfachen und dadurch all die wunderbaren Dinge bauen können, die Sie jeden Tag wie selbstverständlich benutzen. Ohne diese mathematische Sprache würden wir noch immer steinzeitlich leben.

Betrachten wir noch ein weiteres Beispiel im Kontext des Menschen, das uns helfen wird, die Brücke zur rechnenden Maschine zu bauen.

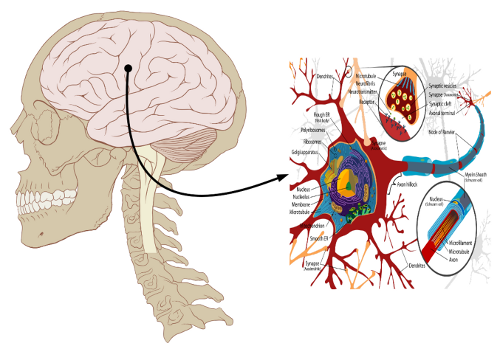

GEHIRN UND NERVENZELLE

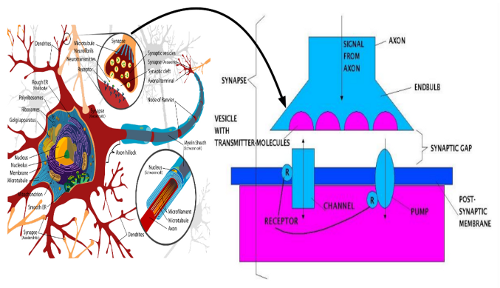

[Bild: Gehirn links, Nervenzelle rechts] Werden wir ein wenig bescheidener und nehmen uns nur einen Teil des Menschen vor, sein Gehirn. Nach neuen Schätzungen umfasst ein Gehirn etwa 100 Mrd Neuronen (Kandel et al. 2012:S.21). Diese sind in der Regel nicht direkt miteinander verbunden.

Die typische Struktur eines Neurons sieht man rechts vom Gehirn. Es gibt genau einen Ausgangs (das Axon), der sich vieltausendfach verzweigen kann, sowie viele tausend Eingänge. In dem kleinen hervorgehobenen Kreis kann man die Eigenart der neuronalen Verbindungen erkennen: das Endstück eines Axons endet kurz vor der Oberfläche des Neurons; es bleibt ein kleiner synaptischer Spalt.

NERVENZELLE UND MEMBRAN

[Bild: Neuron und Membran schematisiert] In dem nachfolgenden Bild ist dies schematisierend und vergrößert dargestellt. Die Oberfläche der empfangenden Zelle stellt eine Membran dar, die man postsynaptische Membran nennt, die zusammen mit dem Endstück des Axons eine Synapse bildet. Die Kommunikation zwischen Endstück und potsysnaptischer Membran wird über Moleküle (Transmittermoleküle) realisiert, die beim Auftreten eines elektrischen Potentials im Axon aus den Vesikeln entlassen werden. Diese diffundieren durch den synaptischen Spalt und können dort, falls sie ‚passen‘ an Rezeptormolekülen von Ionenkanälen andocken. Jede postsysnaptische Membran hat mehrere Tausend solcher Ionenkanäle. Docken diese Transmittermoleküle an den Rezeptoren an, öffnen sich die Ionenkanäle. Es findet dann ein schlagartiger Austausch von Ionen in und außerhalb der Membran statt. Dieser schlagartiger Austausch hat einen ebenso plötzlichen Wechsel des elektrischen Potentials zur Folge, was dann zu dem bekannten Ein-Aus-Signal eines Neurons führen kann.

Gäbe es nur Ionenkanäle, dann wäre mit dem einmaligen Öffnen der Kanäle – bildlich gesprochen – alles Pulver verschossen. Diese Membran würde nie mehr ein weiteres Signal erzeugen können. Das aber ist eigentlich ihre Aufgabe. Zu diesem Zweck gibt es noch einige tausend Ionenpumpen. Diese sind in der Lage Ionen gegen ein Konzentrationsgefälle von außen nach Innen oder umgekehrt zu pumpen. Dazu benötigen sie Energie. Da sie insgesamt langsamer arbeiten als der Ionenaustausch durch die Kanäle stattfindet, entstehen zwischen den einzelnen Signalereignissen Refraktionszeiten, in denen keine Schaltvorgänge möglich sind.

Sie sehen also, schon die vielen tausend Membranen einer einzigen Nervenzelle (es können bei einer Zelle mehr als 1 Mio sein!) bilden kleine, komplexe Maschinen, deren Funktion Signalerzeugung und Signalfluss im Gehirn ermöglicht.

Während ein Neurowissenschaftler zur Beschreibung einer Nervenzelle und des Gehirns auf alle diese unfassbar komplexen Details eingehen muss, kann ein Ingenieur, der ein künstliches Gehirn bauen möchte, sich fast entspannt zurücklehnen und die Frage stellen, welche Eigenschaften an einem Neuron denn wesentlich sind, um sein Schaltverhalten zu erfassen.

Eine typische Antwort würde so aussehen:

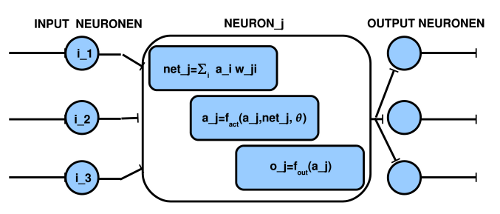

NERVENZELLE MATHEMATISCH

[Bild: Nervenzelle mathematisch] Sie sehen wieder ein Box, dieses Mal ‚Neuron‘ genannt. Der ‚Input‘ zu dieser Box bilden die Endstücke von anderen Neuronen. Im Bild sind es drei Eingänge, es könnten aber n-viele sein. Dazu ein Ausgang, das Axon, das sich auf n-viele viele andere Neuronen – letztlich auch auf sich selbst – verteilen kann. In der Box können Sie drei einfache Formeln erkennen, die drei aufeinander folgende Verarbeitungsstufen repräsentieren. In der ersten Stufe werden die mit wij gewichteten Aktionspotentiale aij der einzelnen Eingänge summiert zum Wert net_j. Dann wird mittels der Aktivierungsfuntkion f_act berechnet, ob diese summierten Eingangssignale zusammen mit dem letzten Aktionspotential a_j einen vorgegebenen Schwellwert theta (θ) überschreiten oder nicht. Falls der Schwellwert überschritten wird, wird ein neues Aktionspotential a_j erzeugt, das dann schließlich mit der Ausgabefunktion f_out in einen geeigneten Ausgabewert umgerechnet wird.

Genauso wenig wie eine einzelne Schwalbe bekanntlich einen Frühling macht, genauso wenig kann man mit einem einzelnen Neuron etwas interessantes anfangen. Der Ingenieur muss sich also noch etwas einfallen lassen, wie er die vielen Neuronen zusammenbringt. Vielleicht ahnen Sie schon, was jetzt kommt:

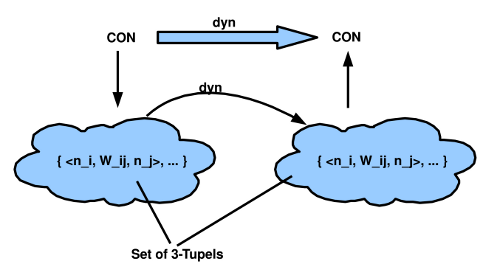

KÜNSTLICHES GEHIRN

[Bild: Mengen von Neuron-Verbindungen] Eine einfache Möglichkeit, die Gesamtheit aller Neuronen zu betrachten, besteht darin, jeweils zwei, die miteinander in Verbindung stehen, als ein Paar zu betrachten, das bestimmte Verbindungswerte besitzt, und dann die Menge aller dieser Paare als eine Einheit zu einem bestimmten Zeitpunkt. Im Bild ‚CON‘ genannt, die Menge aller Connections.

Was dann noch bleibt ist die Beschreibung der Dynamik dieser Zellen, die Art der Veränderungen von einem Zeitpunkt zum nächsten. Dieser Veränderungszusammenhang wird im Bild ‚dyn‘ genannt, eine mathematische Vorschrift, die sagt, wie ich vom Zustand der Zellen zu einem Zeitpunkt zum Zustand der Zellen beim nächsten Zeitpunkt komme.

Damit ist für den Ingenieur alles gesagt, was gesagt werden muss. Ob dieses künstliche Gehirn Bilder erkennen soll, Sprache sprechen, sich erinnern können soll, usw. all dies ist damit erfasst. Sollte der Ingenieur in der Praxis feststellen, dass er wichtige Eigenschaften übersehen hat, dann fügt er sie einfach in seine Formeln ein.

Gehen wir nach diesem Ausflug ins Gehirn nochmals zur Ausgangsbox mit dem Menschen zurück.

NOCHMALS SYSTEMBOX

[Bild: Nochmals die Systembox, jetzt mit Verfeinerungen] Soeben haben wir das Gehirn als eine Teilbereich des Körpers näher betrachtet. Wollen wir diese Erkenntnisse in der allgemeinen Box verorten, dann müssen wir sagen, dass die Menge CON eine Teilmenge der Menge IS der internen Zustände ist, und die Verarbeitungsvorschrift ‚dyn‘ ist ein Teil der allgemeinen Verhaltensfunktion φ des Menschen.

Sie können an diesem Beispiel einmal sehen, wie man mit der Sprache der Mathematik komplizierteste Sachverhalte auf einfache Strukturen zurückführen kann, und – und darauf kommt es in unserem Zusammenhang besonders an – dass der Mensch – also wir selbst – bei dieser Betrachtungsweise eine Struktur besitzt, die uns durch diese Struktur vergleichbar macht mit allen anderen Strukturen.

Eine der Strukturen, mit denen ich die Struktur des Menschen vergleichen möchte, ist die Struktur eines endlichen Prozesses.

Um zu beschreiben und zu erklären was ‚berechenbare Prozesse‘ sind, müssen wir einen kleinen Ausflug in die Welt der Logik und Mathematik machen.Ich hoffe dann zeigen zu können, warum die berechenbaren Prozesse und wir Menschen mehr gemeinsam haben, als die meisten vermuten, und warum das Reden vom ‚Geist‘, auch vom ‚künstlichen Geist‘ heute eine ganz andere Bedeutung bekommen hat, als es bislang üblich war.

DIGITALE MASCHINE

DISKUSSION DER MATHEMATIKER

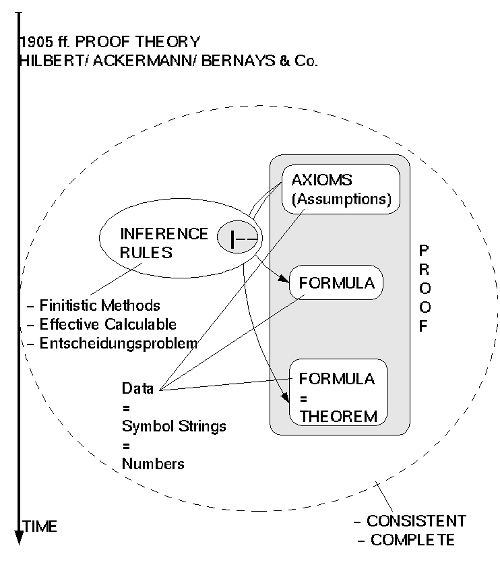

[Bild: Schema einer formalen Theorie] Natürlich werde ich hier nicht auf die Details der Diskussionen im Kontext der sogenannten Grundlagenkrise der Mathematik zum Ende des 19. und zu Beginn des 20.Jahrhunderts eingehen können. Nur so viel sei hier gesagt, dass die Logiker und Mathematiker dieser Zeit ein Problem damit hatten, die Grundlagen der Mathematik so zu beschreiben, dass keine Paradoxien entstehen konnten, erst recht keine direkten Widersprüche in den formalen Systemen und natürlich wünschte man sich vollständige Systeme, d.h. formale Systeme, in denen man alle Aussagen, die im Sinne des Systems wahr sein sollen, auch beweisbar sind.

Eine der wichtigsten mathematischen Schulen innerhalb dieser Diskussionen war die Schule um David Hilbert, der die Lösung des Problems einer befriedigenden Darstellung der Mathematik darin sah, eine Reihe von möglichst einfachen formalen Systemen zu schaffen (basierend auf einer endlichen Menge von Axiomen), deren Widerspruchsfreiheit und Vollständigkeit mit sogenannten ‚endlichen Mitteln‘ gezeigt werden kann. Alle komplizierteren Theorien sollten dann auf diese einfachen Systeme zurückgeführt werden.

Im Alltag mag es uns nicht als Problem erscheinen, von ‚endlichen Mitteln‘ zu sprechen. Aber wenn es darum geht, allgemein zu beschreiben, was hinreichend geeignete endliche Mittel sind, um eine mathematische Theorie als widerspruchsfrei und vollständig zu erweisen, dann zeigt sich plötzlich, dass dies nicht so einfach ist, wie sich dies Hilbert und seine Schule erhofft hatten.

GOEDEL – TURING

[Bild: Goedel und Turing historisch] Es war Kurt Goedel, der 1930-31 zeigen konnte, dass das Grundlagenprogramm von Hilbert und seiner Schule prinzipiell unmöglich war. Er zeigte, dass eine mathematische Theorie, die mindestens so stark wie die Arithmetik ist, aus prinzipiellen Gründen nur eines von beiden sein kann: entweder widerspruchsfrei (konsistent) oder vollständig, aber nicht beides zugleich. Dieses Ergebnis trifft in das Herz jeder mathematischen Theorie, bis heute. Es zeigt, dass es prinzipielle Grenzen in der Beweisbarkeit von mathematischen Wahrheiten gibt.

Diese Probleme treten immer dann auf, wenn es darum geht, innerhalb (!) einer formalen Theorie (mindestens so stark wie eine Prädikatenlogik erster Stufe) die Widerspruchsfreiheit und Vollständigkeit zu beweisen. Natürlich kann man das Problem dadurch zu umgehen versuchen (was sehr viele versucht haben), eine zusätzliche ‚Beschreibungsebene‘ einzurichten, von der aus sie dann ‚über‘ (Griechisch ‚meta‘) die Objekte der anderen ebene ‚reden‘. Solche Art von Hierarchisierungen oder Typisierungen oder Metaebenen entsprechen der üblichen Arbeitsweise des menschlichen Gehirns. Allerdings bildet diese Strategie bei näherem Hinsehen keine wirkliche Lösung. Zwar verschwinden in der Objekttheorie all jene Elemente, die ‚über sich selbst‘ reden können, aber die Metaebene selbst, die ja auch den Berechenbarkeitsforderungen mathematischer Beweise genügen müssen, enthalten dann genau all jene Elemente wieder, die zu der von Kurz Goedel aufgedeckten Schwachstelle führen.

Eine letzte philosophische Würdigung dieser Sachverhalte scheint mir noch auszustehen.

Mit diesen Überlegungen sind wir beim Thema Berechenbarkeit angekommen.

Die Diskussion unter Mathematikern hängt von Beweisen ab, die geführt werden. Diese Beweise müssen mit sogenannten endlichen Mitteln geführt werden, damit sie nachvollziehbar sind. Goedel selbst hatte ein geniales Verfahren ersonnen, um unter Benutzung von natürlichen Zahlen seine Beweise zu führen. Aber er war von seinem eigenen Beweis nie begeistert, obgleich niemand ihn bis heute widerlegen konnte.

Es war dann einem gewissen Alan Matthew Turing vorbehalten fünf Jahre später die Beweise von Goedel nochmals mit anderen Mitteln zu führen. Und diese Beweismittel – später Turingmaschine genannt – fanden nicht nur die Zustimmung von Goedel, sondern von nahezu allen nachfolgenden Generationen. Bis heute ist die Turingmaschine das wichtigste mathematische Konzept für alle Berechenbarkeitsbeweise – und damit der mathematische Referenzpunkt für alles, was wir heute Computer nennen.

Weil dem so ist, weil das Konzept der Turingmaschine eine solch eminente philosophische und mathematische Bedeutung zukommt, lassen Sie mich dieses Konzept kurz vorstellen. Es ist so einfach, dass die meisten, die es zum ersten Mal kennen lernen, sofort fragen: und das soll alles sein? Ich versichere Ihnen, das ist alles und – und das möchte ich dann zum Abschluss zeigen – das Konzept der Turingmaschine findet sich auch schon im Kern von allem Biologischen. Ein Befund, den man nun nicht unbedingt erwarten muß.

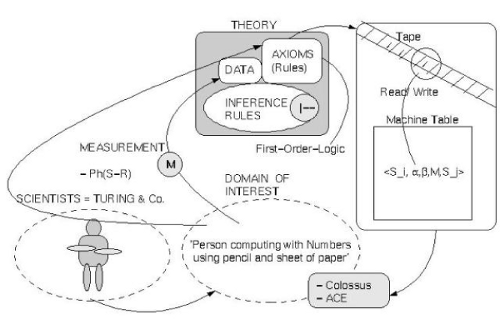

TURINGMASCHINE

[Bild: Theorieprozess TM] So wie Newton angeblich beim Fallen eines Apfels seine entscheidende Einsicht in das Wesen des Gravitationsgesetzes bekommen haben soll, so beschreibt Turing selbst in dem entscheidenden Artikel von 1936-7, dass es die Arbeit eines Buchhalters im Büro war, die ihn inspiriert hat. So, wie der Buchhalter mit einem Stift auf einem Blatt Papier Zahl an Zahl fügt, so stellte er sich eine ideale Maschine vor (siehe im Bild rechts oben), die auf einem Band mit lauter Kästchen, entweder über ein Schreib-Lese-Fenster lesen kann, was in dem Kästchen geschrieben ist oder ein neues Zeichen in das Kästchen schreiben kann. Darüber hinaus kann die ideale endliche Maschine den Schreib-Lesekopf nur um ein Feld nach links oder rechts bewegen. Das ist alles. Das Verhalten der idealen endlichen Maschine wird gesteuert über eine endliche Liste von Befehlen

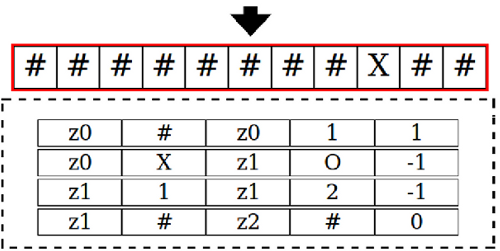

TM BEISPIEL

[Bild: TM mit vier Zeilen] In einem einfachen Beispiel einer TM können Sie solche Befehlszeilen erkennen: in der ersten Spalte steh der Name eines Zustandes (z0), dann folgt ein Feld mit dem Zeichen, das gelesen werden kann, dann eine Feld mit dem Namen des Folgezustandes (z0), dann das Zeichen, das in diesem Fall geschrieben werden soll, und schließlich ein Zeichen, welche Bewegung ausgeführt werden soll.

Im Beispiel würde man die erste Zeile etwa wie folgt lesen: Im Zustand z0 wird beim Lesen des Zeichens ‚#‘ der Zustand z0 beibehalten, für das Zeichen ‚#‘ würde das neue Zeichen ‚1‘ geschrieben und der Schreib-Lesekopf wird um 1 Feld nach rechts bewegt.

Im Beispiel umfasst das ganze Verhaltens-Programm 4 Zeilen.

Das ist alles. Das ist die berühmte Turingmaschine, die sich als weltweiter Standard zur Prüfung der Berechenbarkeit eines Prozesses durchgesetzt hat. Was immer bislang an anderen Formalismen gefunden wurde, sofern solch ein Formalismus endliche Berechenbarkeit beschreiben soll, war er niemals stärker als eine Turingmaschine.

Oder anders ausgedrückt:

Sofern es nicht möglich ist, zu zeigen, dass eine Turingmaschine, angesetzt auf ein Problem, nach endlichen vielen Schritten zu einem Ergebnis kommt, solange kann man nicht behaupten, dass dieses Problem (Turing-)berechenbar ist.

Auf der Basis der Turingmaschine wurden in den vergangenen Jahrzehnten eine ganze Reihe interessanter Unentscheidbarkeitsresultate bewiesen. Auf die kann ich hier jetzt nicht eingehen. In meinen Augen habe diese Ergebnisse alle eine sehr hohe philosophische Relevanz.

Wie eingangs festgestellt, sehe ich einen interessanten Zusammenhang zwischen der Turingmaschine, dem Menschen und der Evolution des Biologischen. Lassen Sie uns daher einen kurzen Blick darauf werfen.

EVOLUTION, KOEVOLUTION, …

GENOTYP UND PHÄNOTYP

[Bild: Genotyp und Phänotyp] Ausgangspunkt dieser Überlegungen ist das erstaunliche Faktum, dass die Vielfalt und Komplexität der Körper – der sogenannte Phänotyp – zurückführbar ist auf die zugrunde liegenden genetischen Informationen – auf den sogenannten Genotyp –. In einem Wachstumsprozess wird – ausgehend von einer einzigen Zelle – ein Körpergebilde mit vielen Billionen Zellen aufgebaut, die alle in einem sinnvollen funktionalen Zusammenhang enden.

Es lohnt, sich klar zu machen, dass dieses unfassbare Wunderwerke eine sehr lange, komplexe Entstehungsgeschichte hat, die selbst im universalen Maßstab ihresgleichen sucht.

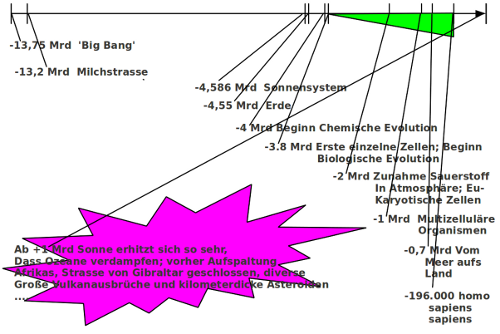

EVOLUTION ALS TEIL DER ENTWICKLUNG DES UNIVERSUMS

[Bild: Entwicklung des Universums mit Evolution] Das Schaubild zeigt maßstabsgetreu wichtige Entwicklungsstationen im bekannten Universum an. Unsere Position auf der Zeitachse ist unmittelbar dort, wo das grüne Dreieck endet. Das grüne Dreieck zeigt an, ab wann zellbasiertes Leben auf der Erde nachweisbar ist. Die Erde begann ca. vor 4.55 Mrd Jahren. Die chemische Evolution, die dann zu ersten einfachen Zellen führte, setzte ungefähr vor 4 Mrd. Jahren ein, 200 Mio Jahre später eben erste einfachste Zellstrukturen. Es dauerte dann etwa 2.8 Mrd Jahre bis es zu ersten multizellulären Lebensformen kam, die dann einige hundert Mio Jahre später zur Besiedlung des Landes führte. Von diesem Zeitpunkt bis zu uns dauerte es nochmals 700 Mio Jahre.

Nach heutigem Wissensstand wird es nur ca. 1 Mrd Jahre dauern, bis in der Zukunft das Leben auf der Erde wegen der beginnenden Aufblähung der Sonne praktisch unmöglich werden wird.

Sind schon diese zeitlichen Verhältnisse atemberaubend, so ist es noch spannender, wenn man der Frage nachgeht, wie es denn überhaupt zur Ausbildung dieser extrem komplexen Strukturen kommen konnte.

Das Schwierigste ist dabei nicht einmal die biologische Evolution, die mit dem Auftreten der ersten Zellen vor ca. 3.8 Mrd. Jahren begann, sondern die härteste, bis heute nicht geknackte Nuss, ist eine Erklärung, wie es überhaupt zu den ersten Zellen kommen konnte. Denn selbst bei den einfachsten Zellen wirken schon so viele komplexe Strukturen zusammen, dass eine Erklärung der schrittweisen Entstehung dieser Strukturen im Rahmen der sogenannten chemischen Evolution bislang nicht völlig aufgehellt ist.

Kehren wir zu den ersten Zellen zurück.

Ich hatte angekündigt, dass die TM als Grundmodell der Berechenbarkeit sich im Herzen des Biologischen wiederfindet.

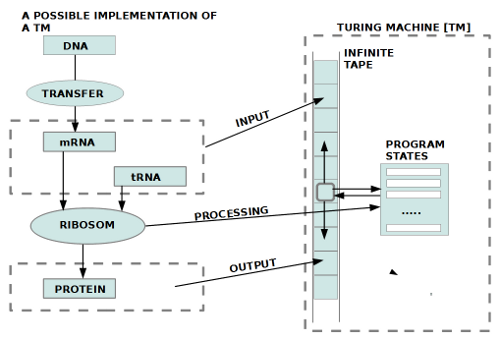

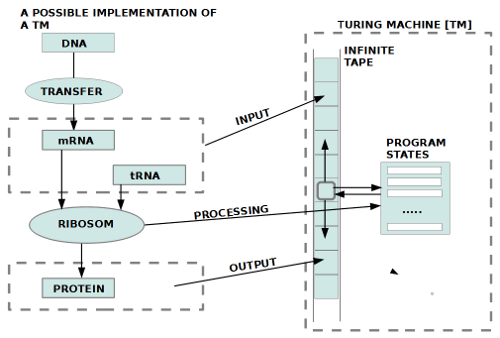

RIBOSOM ALS TURINGMASCHINE

[Bild: links Ribosom, rechts Turingmaschine] Dies können Sie hier sehen:

Links sehen sie das Prozeßmodell, wie ein Ribosom – ein spezielles RNA-Molekül – Proteine erzeugt, indem es Informationen von einem Boten-RNA-Molekül bekommt und zugleich Aminosäurebasteine von Transfer-RNA-Molekülen. Der Dirigent im Hintergrund ist ein DNA-Molekül, dessen Bausteine als Informationseinheiten auf das Ribosom einwirken.

Was sie hier sehen ist das Herzstück allen biologischen Lebens und – möglicherweise – eines der wahren Wunder des ganzen Universums. Das, was allen bekannten Gesetzen der Physik zuwiderläuft und sich jeder anderen bekannten Erklärung entzieht das ist dieses DNA-Molekül. Das DNA-Molekül repräsentiert eine frei kombinierbare Anordnung von Aminosäuren, für die es in den möglichen Kombinationen keinerlei zwingende Gründe gibt. Durch die Verknüpfung mit dem proteinerzeugenden Mechanismus mittels mRNA, tRNA und Ribosom stellt die DNA aber eine Quelle von unerschöpflich vielen Bauplänen für Körperstrukturen dar.

Im Lichte des Konzepts der Turingmaschine bieten sich folgende Interpretationen an. Wie im Bild eingezeichnet lässt sich das Ribosom als eine Turingmaschine interpretieren, die als Input Eingaben von der mRNA und der tRNA bekommt und diese dann in eine Ausgabe als Protein verwandelt. Da das Ribosom, wie wir wissen, aber bzgl. seiner Eingaben nicht rückwärts gehen kann, sondern immer nur vorwärts, schöpft es die Möglichkeiten einer Turingmaschine nicht einmal ganz aus; es entspricht damit eher noch einer abgeschwächten TM mit Namen ‚endlicher deterministischer Automat‘.

Zentral bleibt das Faktum, dass wir im innersten Kern des Biologischen berechenbare Prozesse finden, die von einem DNA-Molekül gesteuert werden, das mit seinen Eigenschaften dem Konzept eines Zeichens sehr nahe kommt.

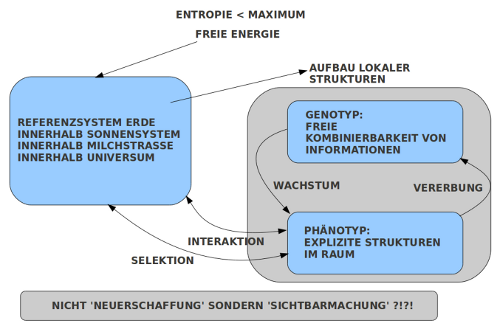

QUINTESSENZ des BIOLOGISCHEN

[Bild: Zusammenfassung Biologisches] Fassen wir diese verschiedenen Aspekte des Biologischen nochmals zusammen:

Ausgangspunkt aller biologischer Phänomene ist das kosmische Faktum, dass die Entropie bislang noch nicht maximal ist. Aus den lokalen Entropiegefällen ist daher ‚freie Energie‘ verfügbar, die in Gestalt von chemischen, biochemischen und dann biologischen Prozessen lokal Strukturen entstehen lassen, die immanent in Richtung immer größerer Komplexität drängen. Dafür gibt es bislang keine befriedigende naturwissenschaftliche Theorie.

In Gestalt der zellbasierten biologischen Evolution können wir ein komplexes Zusammenspiel zwischen Genotyp und Phänotyp einerseits beobachten, aber simultan genauso wichtig das Zusammenspiel zwischen Phänotyp und umgebender Welt. Während der zufallsgesteuerte Genotyp den Raum möglicher Strukturen frei absuchen kann, führt die Bindung des Genotyps an den Phänotyp über die Interaktion mit der umgebenden Welt zu einem übergeordneten Selektionsprozess, der nur jene Phänotypen und damit daran gekoppelte Genotypen akzeptiert, die zur Umgebung passen. Daraus ergibt sich, dass die biologische Evolution simultan und unausweichlich immer nur als Ko-Evolution funktionieren kann.

Damit stellt sich die Frage, ob wir es bei der Emergenz des Geistigen als Eigenschaft des Biologischen mit einer Neuerschaffung des Geistes zu tun haben, oder ’nur‘ mit der Sichtbarmachung des stehts schon vorhandenen ‚Geistigen‘?

Hält man sich diesen Gesamtzusammenhang vor Augen, dann kann der direkte Vergleich zwischen dem Menschen und einer Turingmaschine in einem neuen Licht erscheinen.

MENSCH und KÜNSTLICHER GEIST

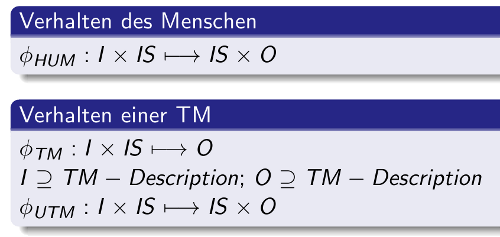

MENSCH TURINGMASCHINE

[Bild: Formel Mensch und (U)TM] Sie sehen auf diesem Schaubild nochmals die schon bekannte Verhaltensformel des Menschen, die sich dadurch auszeichnet, dass wir vom Menschen annehmen können, dass er sich innerhalb seines wissensbasierten Verhaltens bis zu einem gewissen Grade kontinuierlich verändern kann. Man nennt dies Lernen.

Die ’normale‘ Turingmaschine kann dies zunächst nicht. Sie ist vollständig determiniert. Allerdings nur auf den ersten Blick.

Schon Turing hat gezeigt, dass man eine deterministische Turingmaschine sehr leicht zu einer universellen sich selbst modifizierenden Maschine ‚umbauen‘ kann, indem man einen Teil des Bandes dazu benutzt, dort die Beschreibung einer beliebigen Turingmaschine (oder eines Gehirns, oder…) zu speichern. Die ursprüngliche deterministische Turingmaschine kann dann diese andere Turingmaschine simulieren bis dahin, dass sie diese andere Beschreibung in Abhängigkeit von Umgebungsereignissen abändern kann. Damit ist eine universelle Turingmaschine (UTM) voll lernfähig.

Zieht man diese Möglichkeit in Betracht, dann gibt es weder strukturell noch verhaltensmässig einen wesentlichen Unterschied zwischen einem Menschen (sofern er mit der obigen Formel adäquat erfasst wird) und einer universellen Turingmaschine.

Bei solch einer Betrachtungsweise verwundert es dann nicht, dass Turing selbst in verschiedenen Aufsätzen offen darüber spekuliert hatte, dass eine universelle Turingmaschine im Prinzip die vom Menschen her bekannte Geistigkeit nicht nur nachzuahmen sondern in bestimmten Bereichen sogar übertreffen könnte. Letztlich sah er nur praktische Hindernisse auf dem Weg dahin, insbesondere die Schwierigkeit, eine Maschine an all den Lernprozessen teilhaben zu lassen, die Menschen normalerweise durchlaufen.

Künstlicher Geist?

Wenn man sich all diese Gedanken in einer Gesamtschau nochmals vor Augen stellt, dann kann man den Eindruck gewinnen, dass all das, was wir traditionell ‚Geist‘ nennen, also diverse Eigenschaften, die wir mit dem Verhalten des Menschen zusammen bringen, möglicherweise so zu verstehen ist, dass hier Eigenschaften ’sichtbar‘ werden von jenen ‚impliziten‘ Eigenschaften der dynamischen Materie, aus dem alles ist. Die mit den bisherigen Gesetzen der empirischen Wissenschaften nicht erklärbaren biologischen Phänomene wären dann ’nur‘ ‚Ausfaltungen‘ von empirischen Eigenschaften, die genau wie alles andere impliziten ‚Gesetzen‘ folgen.

Wenn dies stimmen würde, dann müsste die ‚Konstruktion‘ eines künstlichen Geistes immer dann möglich sein, wenn man die ‚Randbedingungen‘ für das ‚Aufscheinen‘ (Emergenz?) der geistigen Phänomene bereitstellen würde.

In einer Diskussion in der Nacht des 9.Oktobers dieses Jahres entstand angesichts dieser Sachlage die Idee, in der Stadt Goethes, den künstlichen Geist unter Beteiligung der Öffentlichkeit offiziell entstehen zu lassen.

In einer öffentlich kontrollierten Entstehung des künstlichen Geistes hätten alle eine Chance, ein wesentliches Prinzip dieses unseres Universums und deren Anwendung bzw. Nutzung besser verstehen zu können.

Es geht nicht darum, den Geist neu zu erfinden, sondern das, was vor allem Denken schon da ist, sichtbar zu machen.

Erkennnis ist nicht nur ein Wissensproblem, sondern auch ein Akzeptanzproblem: sind wir bereit zu akzeptieren wer wir wirklich sind: Teil eines universalen Geistwerdungsprozesses, der uns eine immer größere Mitwirkungsmöglichkeit zuweist (womit nicht ausgeschlossen ist, dass es irgendwo in den unendlichen Weiten des Universums ähnliche Prozesse gibt).

An dieser Stelle höre ich jetzt auf, obgleich es ja gerade erst anfängt…

[Anmerkung (11.April 2015): Nach zwei Jahren Diskussion konnte im April die Webseite zum Emerging Mind Projekt eröffnet werden. Offizieller Start ist der 10.November 2015. In diesem Projekt geht es genau um das, was in dem vorausgehenden Beitrag diskutiert wurde, die öffentliche Erzeugung eines Künstlichen Geistes samt den dazugehörigen begleitenden philosophischen Diskussionen und künstlerischen Aktionen.]

LITERATURVERWEISE

- Davis, M. Computability and Unsolvability, New York – Toronto – London: McGraw-Hill Book Company, Inc.,1958

- Davis, M. (Ed.). (1965). The Undecidable. Basic Papers On Undecidable Propositions, Unsolvable Problems And Computable Functions. Hewlett (NY): Raven Press.

- Doeben-Henisch, G.; Beschreibung TM auf der Seite: http://www.doeben-henisch.de/fh/I-TI04/VL/VL3/i-ti04-vl-vl3.html

- Gödel, K. Über formal unentscheidbare Sätze der Principia Mathematica und verwandter Systeme I, In: Monatshefte Math.Phys., vol.38(1931),pp:175-198

- Gödel, K. Remarks before the princeton bicentennial conference on problems in mathematics, 1946. In: Martin Davis, 1965: pp.84-87

- Hilbert, D.; Ackermann, W. Grundzüge der theoretischen Logik, Berlin. J.Springer, 1928

- Hilbert in Wikipedia (en): Hilbert’s problems, URL: http://en.wikipedia.org/wiki/Hilbert%27sproblems (Last access Sept-30, 2012)

- Hilbert, D. Mathematische Probleme, Vortrag, gehalten auf dem internationalen Mathematiker-Kongreß zu Paris 1900, Göttinger Nachrichten 1900, S.253-297, URL:

http://www.mathematik.uni-bielefeld.de/ kersten/hilbert/rede.html, und

http://www.mathematik.uni-bielefeld.de/ kersten/hilbert/(Last Access Sept-30, 2012) - Kandel, E.R.; Schwartz, J.H.; Jessell, T.M.; Siegelbaum, S.A.; Hudspeth, A.J.; (Eds.) Principles of Neural Science, 5th.ed., New York et.al: McGrawHill, 2012

- TM – Beispiel aus dem Internet, vereinfacht. Siehe http://keinerspieltmitmir.de/turing/ (letzter Besuch: 12.Nov.2012)

- Turing, A.M.; Intelligence Service. Schriften, ed. by Dotzler, B.; Kittler, F.; Berlin: Brinkmann & Bose, 1987, ISBN 3-922660-2-3

- Turing, A. M. On Computable Numbers with an Application to the Entscheidungsproblem. In: Proc. London Math. Soc., Ser.2, vol.42(1936), pp.230-265; received May 25, 1936;

Appendix added August 28; read November 12, 1936; corr. Ibid. vol.43(1937), pp.544-546. Turing’s paper appeared in Part 2 of vol.42 which was issued in December 1936 (Reprint

in M.DAVIS 1965, pp.116-151; corr. ibid. pp.151-154).(an online version at:

http://www.comlab.ox.ac.uk/activities/ieg/e-library/sources/tp2-ie.pdf, last accesss Sept-30, 2012) - Wikipedia (en): Body Surface at http://en.wikipedia.org/wiki/Human body (letzter Besuch: 12.Nov.2012)

- Wikipedia (en). Brain at http://en.wikipedia.org/wiki/Human brain (letzter Besuch: 12.Nov.2012)

- Wikipedia (en): Human skeleton at http://en.wikipedia.org/wiki/Human_skeleton (letzter Besuch 12.Nov.2012)

- Wikipedia (en): Organs beyond the Body Surface at http://en.wikipedia.org/wiki/Human anatomy (letzter Besuch: 12.Nov.2012)

- Wikipedia (en): Neuron at http://en.wikipedia.org/wiki/Neuron (letzter Besuch: 12.Nov.2012)

Eine Übersicht über alle bisherigen Beiträge anhand der Titel findet sich HIER