Journal: Philosophie Jetzt – Menschenbild, ISSN 2365-5062, 23.Juli 2019

URL: cognitiveagent.org

Email: info@cognitiveagent.org

Autor: Gerd Doeben-Henisch

Email: gerd@doeben-henisch.de

KONTEXT

Nach einer längeren Schreibpause, hier ein kurzes Blitzlicht …

SCHWEIGEN IST VIELDEUTIG

Es ist ja ein beliebter Topos, über das Schweigen zu sinnieren. Korrespondiert es mit einem ‚Nichts‘ oder ist es nur ein Artefakt vielschichtiger, sich wechselseitig in Bann haltender Aktivitäten, die sich ’nach Außen quasi ‚aufheben’…

Dies ist ein Bild. Für mein Schweigen trifft weder das eine noch das andere zu. Tatsächlich ist bei mir die letzte Zeit extrem dicht angefüllt mit Aktivitäten, Denken, Schreiben, ja auch mit Programmieren, eine moderne Form des Schreibens. Letzteres leider in unserer Kultur von schöngeistigen Menschen wenig geachtet, tatsächlich aber der Stoff, aus dem das Meiste ist, was wir heute für unser Leben benutzen.

DENKEN – VIELFÄLTIG – IM DENKEN DENKEN

Die vielfältigen Formen des Denkens zu katalogisieren und zu bewerten, dann eventuell noch hierarchisch zu gewichten, ist sicher reizvoll. Bis zu einem gewissen Grade und in gewissen Situationen mag dies sogar notwendig sein (Gesetzestexte, Rezepten, Bauanleitungen, Sportberichte, Finanzberichte ….), aber man verliert die Wahrheit aus dem Blick wenn man übersieht, dass alle diese verschiedenen Spezialformen Ausdrucksformen einer einzigen Sache sind, nämlich der Bemühung des menschlichen Geistes — realisiert in den vielen einzelnen Menschen — sich im Hier und Jetzt zurecht zu finden; zu verstehen, wie denn das alles zusammenhängt. Warum das alles so ist, wie es ist. Gibt es irgendwie ein Ziel für die Zukunft? Mehrere? Welches ist am günstigsten? Für wen? Aus welchem Grund?

Für mich war das Schreiben in diesem Block seit ca. 10 Jahren mein Versuch, mich selbst in ein Gespräch zu verwickeln, das mich zwang, Eindrücken, Fragen nachzugehen, die ich ohne dies Schreiben eher achtlos beiseite gelassen hätte. Natürlich, neben viel Spaß, Lust an der Sache, Neugierde, Entdeckerfreuden usw. war es auch weite Strecken mühsam, quälend, mit der ständigen Frage: Muss das so sein? Bringt das was? Im Rückblick, nach ca. 9000 Seiten Text, würde ich sagen, es hat — zumindest für mich — sehr viel gebracht. Ich habe begonnen, Dinge zu verstehen, von denen ich vorher nicht wusste, dass es sie gibt, Zusammenhänge, die mir verborgen waren, überraschende neue Ausblicke, Glücksgefühle, noch mehr Neugierde, viel Hoffnung, ein wachsendes Vertrauen in dieses unfassbare Wunder genannt Leben. Ich bin jetzt soweit, dass ich zumindest ahnen kann, dass das Leben viel größer, tiefer, komplexer, reicher, gewaltiger ist, als alles, was uns die bekannten alten Traditionen — vor allem die alten Religionen, aber auch Einzelbereiche der Wissenschaften — bisher erzählt haben oder heute noch erzählen.

Insofern habe ich aus dem bisherigen Schreib- und Reflexionsprozess viel Kraft gezogen, viel Hoffnung, viel neues Vertrauen, Unternehmenslust, mit dabei zu sein, wenn es geht, die Unfassbarkeit unseres Lebens weiter zu gestalten.

MITGESTALTEN …

Je mehr man diesen Wunsch hegt, nicht nur passiv aufzunehmen, nicht nur zu verstehen, um so schwieriger wird dann die Frage, wo steigt man ein? Was kann man als einzelner mit seinen jeweiligen Möglichkeiten konkret tun?

Leute, die mit markigen Sprüchen durch die Welt laufen, die vielfarbige Slogans verteilen, die einfache schwarz-weiß Bilder austeilen, gibt es genug. Alles ist sehr einfach…

Aber, das Wunder des Lebens ist — nicht wirklich einfach. Wir selbst sind zwar zunächst als ‚Hineingeworfene‘ auf den ersten Blick einfach, weil wir etwas sehr Komplexes sind, das Komplexeste, was es im ganzen Universum gibt, aber wir haben keinen Finger dafür krumm gemacht, wir finden das alles einfach so vor, wir können sofort loslegen, ohne große umständliche Prozesse zu durchlaufen (OK, es gibt mittlerweile in den meisten Kulturen komplexe selbst definierte Lernprozesse in Kindergärten, Schulen, Betrieben, Hochschulen usw.), aber wir müssen nicht verstehen, wie wir funktionieren, um zu funktionieren. Unser Körper, das Äquivalent von ca. 450 Galaxien im Format der Milchstraße, funktioniert für uns, ohne dass wir verstehen müssen (und auch tatsächlich nicht verstehen können, bislang) wie er funktioniert. Wir sind ein Wunderwerk des Universums und können ‚funktionieren‘, obwohl wir uns praktisch nicht verstehen.

Da beginnt meine zweite Story: auf Ganze gesehen weiß ich so gut wie nichts, nah besehen weiß ich aber mittlerweile zu viel, als dass ich einfach so tun könnte, nichts zu wissen 🙂

EINZELTEILE ZUSAMMEN SUCHEN

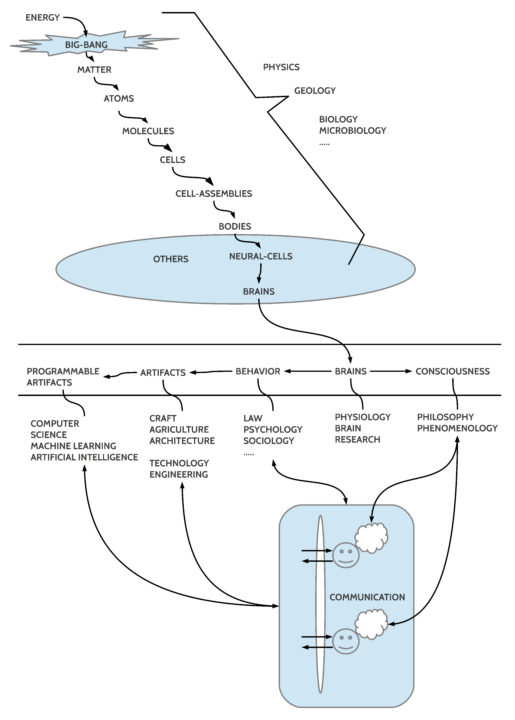

Im Rahmen meiner unterschiedlichen Lehr- und Forschungstätigkeiten, zwischendrin auch ’normale‘ berufliche Arbeiten, habe ich schrittweise viele wissenschaftliche Bereiche kennen lernen dürfen und dabei entdeckt, dass wir aktuell ein ‚Zusammenhangs-Problem‘ haben, will sagen, wir haben immer mehr einzelne Disziplinen,die je für sich hoch spezialisiert sind, aber die Zusammenhänge mit anderen Bereichen, ein Gesamtverständnis von Wissenschaft, gar doch noch mit dem ganzen Engineering, dies geht uns zusehends ab. Dies bedeutet u.a. dass ein neuer Beitrag oft gar nicht mehr richtig gewürdigt werden kann, da die Umrisse des Ganzen, für das etwas entdeckt oder entwickelt wurde, kaum noch greifbar sind. Dies ist das Fake-News-Problem der Wissenschaften.

Ob geplant oder spontan oder zufällig, ich kann es nicht genau sagen, jedenfalls habe ich vor einigen Jahren damit begonnen, zu versuchen, die Disziplinen, in denen ich tätig sein konnte, langsam, schrittweise, häppchenweise, zu systematisieren, zu formalisieren, und sie auf die mögliche Wechselwirkungen mit den anderen Bereichen hin abzuklopfen.

Zu Beginn sah dies alles sehr bruchstückhaft, eher harmlos aus.

Doch im Laufe der Jahre entwickelten sich Umrisse, entstanden immer deutlicher Querbezüge, bis dann so langsam klar wurde, ja, es gibt hier mögliche begriffliche Rahmenkonzepte, die sehr prominente und doch bislang getrennte Disziplinen auf eine Weise zusammen führen können, die so bislang nicht sichtbar waren.

MENSCH – MASCHINE – UND MEHR …

Mein Fixpunkt war das Thema Mensch-Maschine Interaktion (MMI) (Englisch: Human-Machine Interaction, HMI), von mir dann weiter entwickelt zum allgemeinen Actor-Actor Interaction (AAI) Paradigma. Mehr zufällig bedingt, genau genommen durch einen wunderbaren Freund, einem Südafrikaner, ein begnadeter Systems Engineer, habe ich auch sehr früh begonnen, das Thema Mensch-Maschine Interaktion immer auch im Kontext des allgemeineren Systems Engineerings zu denken (im englischsprachigen Raum ist das Paradigma des Systems Engineering sehr geläufig, im deutschsprachigen Bereiche gibt es viele Sonderkonzepte). Irgendwann haben wir angefangen, das Systems Engineering zu formalisieren, und im Gefolge davon habe ich dies ausgedehnt auf das Mensch-Maschine Paradigma als Teil des Systems Engineerings. Dies führte zu aufregenden Verallgemeinerungen, Verfeinerungen und letztlich auch Optimierungen. Es war dann nur eine Frage der Zeit, bis das ganze Thema Künstliche Intelligenz (KI) integriert werden würde. KI steht bislang theoretisch ein wenig verloren im Raum der vielen Disziplinen, kaum verortet im Gesamt der Wissenschaften, des Engineering, der allgemeine Kognitions-, Lern- und Intelligenztheorien der biologischen Disziplinen. Im Rahmen des AAI Paradigmas ist KI eine Subdisziplin, die eine spezielle Teilmenge von Akteuren in ihrem Verhalten beschreiben, modellieren und simulieren kann, aber eben nicht isoliert, sondern eingeordnet in den Gesamtrahmen von Engineering und Wissenschaft. Dies eröffnet viele aufregende Perspektiven und Anwendungsmöglichkeiten.

Und so wird es auch niemanden verwunden, dass mein Engagement für ein integriertes begriffliches System für Systems Engineering, MMI und KI zugleich auch ein starkes Engagement für die philosophische Dimension wurde.

Ein Leser dieses Blocks wird nicht verwundert sein, wenn ich feststelle, dass es gerade die intensive Beschäftigung mit dem Engineering und seiner Meta-Probleme waren, die mich zur Philosophie zurück geführt hatten. Nach meiner völligen Frustration mit der klassischen Philosophie während des ersten Anlaufs einer Promotion in Philosophie an der LMU München (ca. 1980 – 1983) — ein Roman für sich — fand ich viele wertvolle Erkenntnisse im intensiven Studium der Wissenschaftsphilosophie und einiger konkreter Wissenschaften. Das Engineering (mit Schwerpunkt Informatik) war dann noch bereichernder. Aber gerade hier, im Systems Engineering, bei dem Thema Mensch-Maschine, und ausgerechnet mitten in den Lerntheorien der KI, bin ich auf so viele grundlegende philosophische Fragen gestoßen, dass ich von da ab — fast notwendigerweise — wieder angefangen habe philosophisch zu denken. Eines der Hauptmotive für diesen Block.

Natürlich, das merkt man wohl auch schon beim Lesen, führt die Breite und Fülle dieser Aspekte dazu, dass man nicht schnell, und nicht immer konzise arbeiten kann. Man muss viele Fragen mehrfach bedenken, oft von verschiedenen Seiten aus, muss immer wieder von vorne anfangen, und wenn man dann meint, jetzt habe man man den Bogen doch gut hinbekommen, entdeckt man von einer anderen Seite so viele anderen Aspekte, Löcher, Unzulänglichkeiten, dass man gerade nochmals von vorne anfangen kann.

Wie schwierig es auch sein mag, die Umrisse eines Ganzen deuten sich doch mittlerweile immer stärker an, so stark, dass ich das Gefühl habe, dass dieser andere Block — uffmm.org–, mein Blog für das Engineering, ab jetzt mehr — oder gar die ganze — Aufmerksamkeit verlangt.

Denn, eine Folge von Zusammenhangs-Sichten ist, dass man — fast unaufhaltsam — immer weitere Zusammenhänge entdeckt. So ist natürlich eng verknüpft mit dem Mensch-Maschine Paradigma der gesamte Komplex der biologischen und psychologischen Verhaltenswissenschaften, dazu gehörig auch das, was man Kognitionswissenschaft nennt, und damit ganz viele weitere spezielle Disziplinen, die irgendwie den Menschen und sein Verhalten thematisieren (Semiotik, Linguistik, Soziologie, …).

Während das Lesen und Studieren einzelner Werke und Artikel aus diesen Bereichen ohne übergreifenden Zusammenhang oft so beliebig, und damit frustrierend, wirkt, gewinnen diese Werke bei einem expliziten begrifflichen Zusammenhang eine ganz andere Farbigkeit, leuchten auf, werden interessant. So ist mir dies z.B. in den letzten Monaten mit Büchern von Edelman, Gallistel und Gärdenfors gegangen (um einige Beispiele zu nennen).

Während es also einerseits darum geht, immer mehr prominente Beispiele aus den genannten Disziplinen in den neuen begrifflichen Rahmen einzuordnen, ist mir auch klar geworden, dass dies alles — so wunderbar das für sich genommen schon ist (obgleich noch im Prozess) — heute nicht mehr ausreichend ist, ohne eine hinreichende Softwareunterstützung, ohne Software-Modellierung und vielerlei Simulationsversionen. Schon ein rein empirisches verhaltenswissenschaftliches Buch wie das grundlegende Werk von Gallistel zur Organisation des biologischen Lernens bleibt ohne zugehörige Softewaremodelle irgendwie ein Torso, entsprechend auch die Werke von Gärdenfors zu Begriffs-Räumen (Conceptual Spaces). Ein positives Beispiel für Theorie und Computersimulation liefert Edelman in vielen Büchern, Artikeln und Programmen. Und ich weiß aus eigener Vorlesungserfahrung, dass die Vorlesungen zum dynamischen Lernen erste mit der zugehörigen Softwaremodellierung jene Farbe und Tiefe bekommen haben, die es heute braucht.

Für mich ergibt sich daraus, dass ich parallel zur Text-Version der Theorie — natürlich mit hinreichenden Formalisierungen — eine vollständige Softwareabdeckung brauche. Ohne diese wird das alles nur Stückwerk bleiben.

Damit entsteht ein ziemliches Aufgabenpaket: Systems Engineering mit Actor-Actor Paradigma, dazu KI integriert, bei AAI Kognitionswissenschaften integriert, und zu allem die notwendige Software.

Allerdings eine wichtige Dimension fehlt bei dieser Aufzählung noch: die allgemeine Philosophie und die Wissenschaftsphilosophie. Die allgemeine Philosophie und die Wissenschaftsphilosophie können zwar die Einzelwissenschaften nicht ersetzen, aber die Einzelwissenschaften ohne eine explizite allgemeine Philosophie und Wissenschaftsphilosophie gleichen einem Haufen gackernder Hühner, deren Einzelbeiträge schnell in Kakophonie umschlagen kann, wenn sie nicht integriert werden.

Also, im Prinzip ist sehr klar, wie es gehen soll, es konkret zu tun ist scheinbar unmöglich. Aber genau das ist es, worum es geht: das Leben als solches in diesem Universum ist die maximale Unmöglichkeit, aber dennoch ist es da, dennoch entwickelt es sich. Dieses Mysterium einer ungeheuren Kraft, das Unmögliche möglich zu machen, das ist das, was jeden Menschen, insbesondere jeden Wissenschaftler, antreiben sollte, ansonsten sind wir tatsächlich — möglicherweise — schlechter als alle denkbaren Roboter der Zukunft.

AUF DIE BAUSTELLE

Wie schon angedeutet, hat meine Theoriebaustelle einen Namen: uffmm.org . ‚uffmm‘ ist die Abkürzung eines ganzen Satzes. Ich verrate jetzt nicht, wie dieser Satz heißt. Schön wäre es, wenn er einmal wahr werden würde.

Wer will, kann die Ereignisse auf dem uffmm-Blog verfolgen, allerdings ist dort alles auf Englisch. Es ist nicht meine Sprache, ich fühle mich damit sprachlich amputiert, aber es ist die zur Zeit beste Arbeitssprache für den internationalen Raum.

Ich habe auch keine Ahnung, wie weit ich kommen werde.

Parallel betreibe ich noch ein Anwendungsprojekt mit Überschrift ‚Kommunalplanung als eGaming‚. Damit zielen wir auf alle ca. 11.000 Kommunen in Deutschland, mit einem neuen Ansatz für mehr Demokratie in einer digitalisierten Welt. Dieser Ansatz ist ein direkter Ausfluss der zuvor angedeuteten Theoriearbeit (plus Software).

Der Philosophie-Jetzt Block war der entscheidende Inkubator für diese Weiterentwicklung. Ob und wie sich dieser Blog weiter entwickelt, wird man sehen. Er war ganz und gar ungeplant, und so wird auch die weitere Zukunft sich ereignen 🙂

Einen Überblick über alle Blogeinträge von Autor cagent nach Titeln findet sich HIER.

Einen Überblick über alle Themenbereiche des Blogs findet sich HIER.