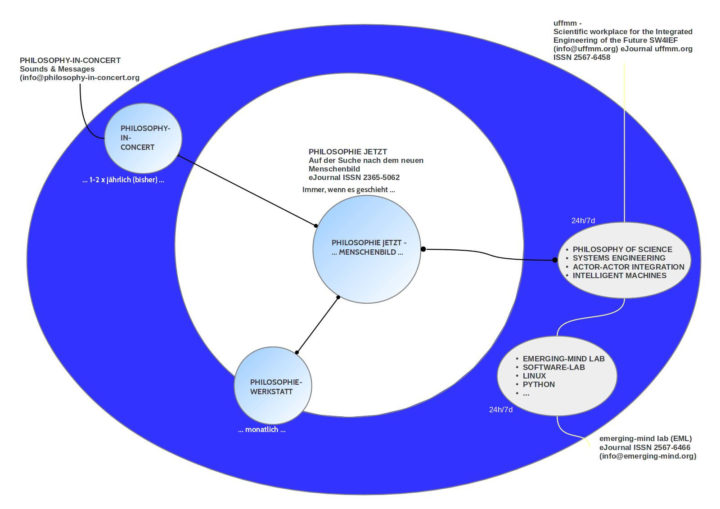

Journal: Philosophie Jetzt – Menschenbild

ISSN 2365-5062, 2.-5.Dezember 2021, 13:12h

URL: cognitiveagent.org, Email: info@cognitiveagent.org

Autor: Gerd Doeben-Henisch (gerd@doeben-henisch.de)

KONTEXT

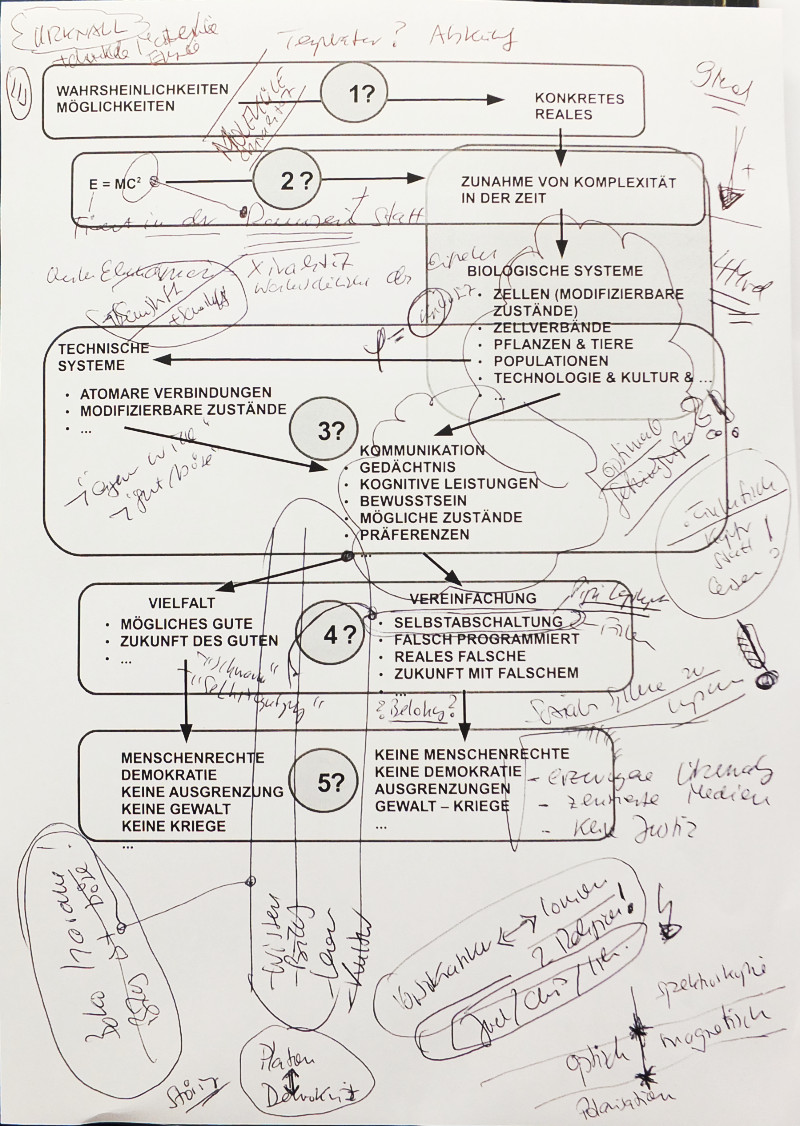

Der Autor dieses Textes ist involviert in die Ausarbeitung zur Theorie und zur praktischen Umsetzung eines neuen Konzeptes von ‚Kollektiver Mensch:Maschine Intelligenz‘, das unter dem Begriff ‚oksimo Paradigma‘ vorgestellt und diskutiert wird.[1] In diesem Zusammenhang ist es wichtig, den eigenen Standpunkt immer wieder mit anderen Positionen in der Literatur abzugleichen: Ist das Ganze letztlich doch nicht wirklich ‚Neu‘? Falls doch, in welchem Sinne neu? Interessant sind auch die Beziehungen zwischen den verschiedenen Konzepten, ihre historische Entwicklung.

In einer online-Veranstaltung am 30.November 2021 bekam der Autor von Jörn Lamla den Hinweis auf den Artikel ‚Social Machines‘. [2] Wie man in dem kurzen aber prägnanten Artikel in der englischen Wikipedia nachlesen kann [3], ist der Begriff ‚Social Machine‘ (‚Soziale Maschine‘) schon gut 150 Jahre alt, zeigt aber noch keine sehr klaren Konturen. Der Versuch, das ‚Soziale‘ mit der ‚Technologie‘, mit ‚Maschinen‘ — hier sind vernetzte Computer gemeint, letztlich der ‚Cyberspace‘ — begrifflich zu vernetzen, drängt sich auf, ist für Gesellschaftswissenschaften verführerisch, führt aber nicht automatisch zu präzisen Konzepten. Weder ‚das Soziale‘ noch ‚die Maschine‘ sind Begriffe, die aus sich heraus irgendwie klar sind. Umso gespannter kann man sein, was die Autoren meinen, wenn sie zum begrifflichen Konstrukt ‚Soziale Maschine‘ einen Text schreiben.

SOZIALE MASCHINEN

Im weiteren Text bekennen sich die Autoren zu der schwer fassbaren Semantik des Begriffs ‚Soziale Maschine‘, indem sie diverse Beispiele aus der Literatur zitieren, die ein viel schillerndes Bild bietet. Um für ihre Diskussion einen irgendwie gearteten begrifflichen Referenzpunkt zu gewinnen, führen sie dann ihrerseits eine ‚Definition‘ von ‚Sozialer Maschine‘ ein (ohne sich allerdings der Mühe zu unterziehen, die Vielfalt der bisherigen Positionen tatsächlich im einzelnen zu diskutieren).

Def 1: Social Machines

Ihre Definition lautet: „Social Machines sind soziotechnische Systeme, in denen die Prozesse sozialer Interaktion hybrid zwischen menschlichen und maschinellen Akteuren ablaufen und teilweise algorithmisiert sind.“

An dieser Stelle ist es eine offene Frage, ob diese Definition eine ‚adäquate Repräsentation‘ des vorausgehenden Diskurses zu Sozialen Maschinen darstellt, oder ob es sich nur um eine spezielle Setzung der Autoren handelt, deren Begründung nicht schlüssig aus dem bisherigen Diskurszusammenhang folgt.

Liest man die Definition der Autoren, dann fallen u.a. folgende Formulierungen auf: (i) dass die ‚Prozesse sozialer Interaktion‚ ‚hybrid‚ sein sollen; (ii) dass diese Prozesse zwischen ‚menschlichen und maschinellen Akteuren‚ ablaufen sollen, und (iii) dass diese ‚ teilweise algorithmisiert‚ sein sollen.

Hybrides Handeln

Angesichts des großen Bedeutungsspektrums des Ausdrucks ’soziale Interaktion‘ in der Literatur (dazu oft sehr theorieabhängig genutzt) ist an dieser Stelle nicht ganz klar, was mit sozialer Interaktion‘ gemeint sein soll. Dazu der Ausdruck ‚hybrid‘. Ab wann sind menschliche Handlungen hybrid? Handelt ein Mensch ‚hybrid‘ wenn er Werkzeuge benutzt? Handelt ein Mensch ‚hybrid‘, wenn er die Gegebenheiten der Natur nutzt, um Nahrung zu finden oder zu produzieren? Handelt ein Mensch ‚hybrid‘, wenn er andere Menschen ‚instrumentalisiert‘, um persönliche Ziele zu erreichen? Handelt ein Mensch ‚hybrid‘, wenn er eine Sprache benutzt, die er in einer Gesellschaft als Instrument der Kommunikation vorfindet? Warum sollte die Benutzung einer Maschine eine besondere Form von ‚hybridem Handeln‘ darstellen, wenn die Nutzung der Maschine für den ‚Inhalt der Aktion‘ ‚unwesentlich‘ ist?

Für die weitere Diskussion sei hier daher die Verabredung getroffen, dass immer dann, wenn ein Mensch in seiner Interaktion mit der Welt irgendwelche Umstände so benutzt, dass dieses Handeln ohne diese Bezugnahme nicht erklärbar wäre, von einer ‚allgemein hybriden Handlung‘ gesprochen werden soll. Da jede Interaktion mit der Umgebung ‚als Interaktion‘ in diesem Sinne ‚allgemein hybrid‘ ist, sagt der Ausdruck ‚allgemein hybrid‘ nicht allzu viel, außer, das er uns bewusst machen kann, dass wir im Handeln niemals nur ‚für uns‘ handeln, niemals nur ‚isoliert, autonom‘ handeln, sondern wir uns unausweichlich in einer ‚Wechselwirkung‘ mit ‚etwas anderem‘ befinden. Und dies liegt nicht am ‚Handeln als solchem‘ sondern in der Art und Weise, wie jegliches Handeln von Homo sapiens Exemplaren in der ‚inneren Struktur‘ eines Homo sapiens ‚verankert‘ ist.

Die Benutzung vieler Computerdienste (maschinelle Dienstleistungen) sind in diesem Sinne zwar ‚allgemein hybrid‘ insoweit ein Mensch zusätzliche Mittel für sein Handeln benutzt, aber ob man den die maschinelle Dienstleistung benutzt oder nicht, muss nicht notwendigerweise einen wesentlichen Einfluss auf den ‚Inhalt des Handelns‘ haben (außer dass diese Benutzung das Handeln ‚bequemer‘ oder ’schneller‘ oder … macht). Wenn die Autoren also die Bedeutung von ‚hybrid‘ in diesem Zusammenhang so betonen, stellt sich die Frage, was denn in dieser Interaktion so ‚besonders‘, so ’speziell‘ sein soll, dass es sich lohnt, dies hervor zu heben. Allein die Einbeziehung von ‚etwas anderem‘ in das menschliche Handeln geschieht seitdem es den Homo sapiens gibt, tatsächlich sogar schon viel länger, wenn man die evolutionäre Vorgeschichte des Homo sapiens berücksichtigt. Selbst unter Prä-Homo sapiens Lebensformen, die heute leben, ist ‚allgemein hybrides‘ Handeln verbreitet.

Menschliche und Maschinelle Akteure

Es fragt sich, ob mit der Konkretisierung des ‚technischen Anteils‘ im Ausdruck ’soziotechnische Systeme‘ zu ‚Maschinen‘ etwas gewonnen wird? Gibt es technische Systeme, die keine Maschinen sind? Was ist mit hochentwickelten Landwirtschaften, wie sie sich in der Zeit islamischer Besetzung in Spanien um und vor +1000 fanden: komplexe Bewässerungssysteme, komplexe Architektur, komplexe Organisationsformen machten aus Spanien eine blühende und fruchtbare Landschaft. Ist das auch Technologie, und dann sogar im eminenten Sinne soziotechnisch‘? Was ist mit den großartigen Bibliotheken in der Hochblüte des Islams mit vielen hundert Tausend Büchern? Was ist mit der Seeschifffahrt durch die letzten Jahrtausende, die Städte, den Bauwerken, den Straßen und Brücken, den … ? Der Begriff ‚technisches System‘ ist nicht besonders klar, genauso wenig der Begriff ‚Maschine‘. Wie ein kurzer Blick in die englische Wikipedia zeigt [8], hat der Begriff eine lange Geschichte mit einem starken Bedeutungswandel, der die Spuren vielfältiger kultureller Entwicklungen in sich aufgenommen hat. Welche Typen von Maschinen meinen die Autoren?

Durch die Kombination von ‚Maschine‘ und ‚Akteur‘ kommt auf jeden Fall eine besondere Note ins Spiel, da der Begriff des ‚Akteurs‘ — in sich auch nicht klar definiert! — die unscharfe Vorstellung assoziiert, dass damit ein ‚System‘ gemeint sein könnte, das ‚(selbständig?) handeln‘ kann — was immer genau ‚(selbständig) handeln‘ heißen mag –.

Im Englischen meint ‚Akteur‘ als ‚actor‘ schlicht Menschen, die als Schauspieler in einem Stück handeln [9]. Sie handeln aber tatsächlich nur partiell ’selbständig, aus sich heraus‘, insofern sie das vorgegebene Drehbuch zwar in den groben Linien ’nachspielen‘, im Detail der Rolle aber mit ihrem realen Verhalten diese Rolle ‚modifizieren‘ können; in der Art und Weise dieses ‚Modifizierens einer Rolle‘ meinen viele erkennen zu können, ob es sich um einen ‚großen Schauspieler‘ handelt.

In neueren technischen Kontexten gibt es viele Standards, u.a. auch UML (Unified Modeling Language). [10] In UML wird für den Bereich der Programmierung das Zusammenspiel, die Interaktion verschiedener ‚Rollen‘ in einem Interaktionsfeld strukturiert beschrieben. ‚Akteure‘ (‚actors‘) sind dann jene abgrenzbare Größen, die Ereignisse aus der Umgebung (Input) aufnehmen, wie auch auf die Umgebung durch Reaktionen (Output) reagieren können.[11]

Viele andere sprachliche Verwendungszusammhänge mit dem Begriff ‚Akteur‘ sind bekannt. Die Autoren bieten dazu keine Erläuterungen, weder für die Frage, warum sie den allgemeinen Begriff des ‚technischen Systems‘ auf ‚Maschinen als Akteure‘ einschränken noch, welche Art von ‚Akteuren‘ sie genau meinen.

Teilweise Algorithmisiert

Der heutige Begriff des ‚Algorithmus‘ im Kontext von programmierbaren Maschinen [12] hat eine lange Vorgeschichte im Kontext der Mathematik (von heute aus ca. 4.500 Jahre rückwärts), wird aber seit der Verfügbarkeit von real programmierbaren Maschinen (‚Computern‘) seit ca. 1930 vornehmlich für jene Befehlslisten verwendet, mit denen programmierbare Maschinen gesteuert werden.[13] Der Ausdruck der Autoren, dass ’soziale Interaktionen‘ ‚teilweise algorithmisiert‘ sind, wirft von daher mindestens eine Frage auf: Was an einer sozialen Interaktion soll algorithmisiert‘ sein, wenn doch nach allgemeinem Verständnis nur programmierbare Maschinen von einem Algorithmus gesteuert werden können?

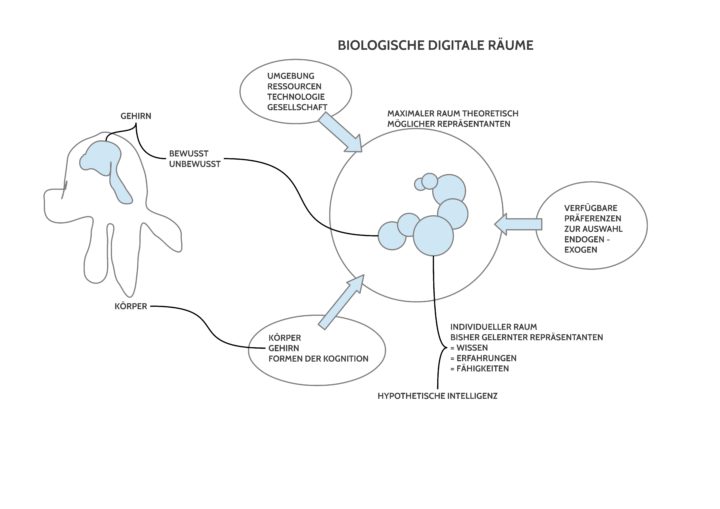

Nehmen wir an, dass hier soziotechnische Systeme gemeint sind, die — vereinfachend — aus Akteuren bestehen, die sowohl biologische und nicht-biologische Systeme sein können. Im angenommenen Fall sind diese Akteure auf der einen Seite weiter spezialisiert zu ‚biologischen System‘, die ‚Homo sapiens Exemplare‘ darstellen, und auf der anderen Seite ‚programmierbare Maschinen‘. Von den programmierbaren Maschinen ist bekannt, dass sie — per Definition — über ein ‚Programm‘ verfügen können, das die Eigenschaften eines ‚Algorithmus‘ besitzt. In einer ‚Interaktion‘ zwischen Homo sapiens Akteuren und programmierbaren Maschinen würden — Annahme — die Homo sapiens Akteure so handeln, wie sie immer handeln: Bezugnehmend auf ihre Wahrnehmung der Umgebung würden sie auf der Basis der bis dahin erworbenen Erfahrungen und aktuellen Motivationslagen auf diese Umgebung reagieren; dieses ‚Muster‘ von ‚Wahrnehmung + innere Zustände + Reagieren‘ würde dann einen groben Rahmen für den Begriff einer ‚Handlung‘ zur Verfügung stellen, die bezogen auf eine Situation mit einem anderen Akteur als ‚Gegenüber‘ dann als ‚Interaktion‘ bezeichnet werden könnte. [14] Jede Art von ‚Interaktion‘ in dieser Sicht wäre ‚allgemein hybrid‘, sofern das ‚Gegenüber‘ zu einem Homo sapiens Exemplar nicht wieder ein anderes Homo sapiens Exemplar wäre, also allgemein ‚kein biologisches System‘! Insofern ‚programmierbare Maschinen‘ sehr spezielle Formen von Maschinen — und generell von technischen Systemen — darstellen, die in er ‚Rolle eines Akteurs‘ auftreten können, hätten wir das Muster einer ‚allgemein hybriden‘ Interaktion, die sich zunächst nicht von irgendwelchen anderen Interaktionen des Homo sapiens Exemplars mit irgendwelchen nicht-biologischen Systemen unterscheidet.

An dieser Stelle könnte man dann die Frage stellen, ob und wie die Interaktion eines Homo sapiens Exemplars mit einer programmierbaren Maschine irgendwelche Besonderheiten aufweisen kann verglichen mit einer ‚allgemein hybriden Interaktion‘?

Nach diesen ersten Fragen an die Autoren hier die Interpretation, die die Autoren selbst zu ihrer Definition geben.

Def. 2: Soziotechnisches System

Interessant ist die Formulierung „… verstehen wir unter einem soziotechnischen System ein komplexes Gefüge, welches Menschen, Hard- und Software, organisationale und soziale Prozesse für gegebene Aufgaben oder Ziele miteinander interagieren lässt.“

Das zuvor ermittelte Schema von zwei Akteuren unterschiedlicher Art (biologisch und nicht-biologisch, im letzteren Fall ‚programmierbare Maschinen‘), wird hier in einem Bündel von vier Faktoren gesehen: (i) Menschen, (ii) Hard- und Software, (iii) ‚organisationale und soziale Prozesse‘, sowie (iv) ‚Aufgaben und Ziele‘. Diese vier Faktoren sind dynamisch so verknüpft, dass es ‚Aufgaben und Ziele‘ sind, bezogen auf diese die anderen drei Faktoren in Wechselwirkungen treten. Normalerweise würde man annehmen, dass es die Interaktionen von ‚Menschen‘ einerseits und ‚Hard- und Software‘ andererseits sind, durch die ‚Prozesse‘ stattfinden. In der Formulierung der Autoren liest es sich aber so, als ob ‚organisationale und soziale Prozesse‘ einen eigenständigen Faktor neben ‚Menschen‘ und ‚Hard- und Software‘ bilden, und zwar so, dass alle drei Faktoren interagieren. Also, ein ‚Prozess‘ interagiert mit einem Menschen oder einer Hard- und Software und umgekehrt. Eine sehr ungewöhnliche Vorstellung.

In einem sehr verbreiteten Verständnis von ‚Prozess‘ [15] ist ein Prozess eine Serie von Aktivitäten, die ineinandergreifen, um ein ‚Ergebnis‘ zu produzieren. Je nach Kontext (Disziplin, Anwendungsbereich) können die Aktivitäten sehr unterschiedlich aussehen, ebenso das erzielte Ergebnis.[15] Ergänzend ist es ein verbreitetes Verständnis von ‚Aktion’/’Aktivität‘, dass es sich um ein Ereignis handelt, das von einem ‚Agenten’/ ‚Akteur‘ für eine bestimmte ‚Absicht’/ ‚Ziel‘ herbeigeführt wird, das ‚in‘ dem handelnden Akteur ‚verankert‘ ist. [16]

In diesem Verständnishorizont sind es also Agenten/ Akteure, die unter dem Einfluss von Zielen bestimmte Ereignisse erzeugen — als handeln, indem sie Aktionen ausführen –, die zusammen genommen als ein ‚Prozess‘ verstanden werden können. In diesem Sinne sind ‚Prozesse‚ keine ’normalen Objekte‘ der realen Welt sondern begriffliche Konstrukte, die sich in den Köpfen von Akteuren bilden können, um eine Folge von konkreten Ereignissen — stark abstrahierend — als einen ‚Prozess‘ zu verstehen. Von einem ‚Prozess‘ zu sprechen verlangt daher von den Beteiligten, sich jeweils darüber zu vergewissern, welche Abfolge von Ereignissen (Handlungen) zum aktuellen Begriff eines Prozesses gehören sollen.

Bemerkenswert ist auch, dass die Ziele — die intendierten Ergebnisse — ebenfalls nicht als ’normale Objekte‘ vorkommen, sondern primär ‚in den Akteuren‘ verankert sind, und es eine der schwierigsten Aufgaben in jedem Prozess ist, zwischen allen beteiligten Akteuren zu klären, was man unter dem ‚gemeinsamen‘ Ziel — eventuell individuell ganz unterschiedlich gedacht — so zu verstehen hat, dass es zwischen allen Beteiligten ‚klar genug‘ ist. [17] Da Ziele keine realen Objekte sind, sondern immer nur ‚innere Objekte‘ der Akteure, ist eine vollständige Klärung der ‚gemeinten Bedeutung‘ generell nur annäherungsweise über aufzeigbare Beispiele möglich.

Versucht man der Intention der Autoren zu folgen, dann wären Prozesse Entitäten, die mit Menschen und/oder Hard- und Software interagieren können. Hierin klingt irgendwie an, als ob Prozesse soziale Realitäten sind, die als solche greifbar sind und mit denen Menschen interagieren können so wie mit anderen Gegebenheiten. Da die Autoren den Begriff der ‚Interaktion‘ bzw. der ‚Aktion‘ bislang nicht geklärt haben, bleibt der Versuch des Verstehens an dieser Stelle ‚mit sich alleine‘.

Im Lichte eines verbreiteten Verständnisses sind Prozesse höchstens in einem sehr abstrakten Sinne ’soziale Realitäten‘, die mit Menschen sowie Hard- und Software ‚interagieren‘. Nehmen wir z.B. einen beliebigen Planungsprozess in einer Firma oder einer Behörde. Ein Chef kann z.B. einen Mitarbeiter davon in Kenntnis setzen, dass er ab morgen in dem Planungsprozess Px mitarbeiten soll. Damit wird der Mitarbeiter Mitglied der Projektgruppe PGx zum Planungsprozess Px. Als Mitglied der Projektgruppe startet für das neue Mitglied ein Kommunikationsprozess, innerhalb dessen er sich ein ‚inneres Bild‘ von dem Projekt und seinen Aufgaben machen kann. In dem Maße, wie der Mitarbeiter aufgrund seines ‚inneren Bildes‘ versteht, was genau seine Aufgaben mitsamt einem spezifischen Aufgabenumfeld sind, kann der Mitarbeiter anfangen, ‚etwas zu tun‘, d.h. er kann ‚gezielt Handlungen vornehmen‘. Im ‚Stattfinden‘ seiner Handlungen und durch die möglichen ‚erfahrbaren Resultaten‘ können die anderen Mitglieder der Projektgruppe ‚wahrnehmen‘, was der neue Mitarbeiter tut und sie können die neuen ‚Wahrnehmungen‘ mit ihrem ‚inneren Bild des Projektes‘ ‚abgleichen‘: passen die Handlungen und Ergebnisse des neuen Mitarbeiters zu ‚ihrem inneren Bild‘ des Prozesses?

Im Lichte dieses Beispiels würde das Konzept einer ‚Interaktion zwischen Menschen und einem Prozess‘ letztlich zurück übersetzt werden müssen zu einer ‚Interaktion zwischen Menschen‘, da ein Prozess niemals als solcher als ein ‚erfahrbares Objekt‘ existiert, sondern immer nur als ‚abstraktes Konzept‘ im ‚Innern von Menschen‘, die über Kommunikation verbunden mit Handlungen und aufzeigbaren Artefakten miteinander interagieren. Kann man solchen Kommunikationen und Interaktionen mit Artefakten ein gewisses ‚Format‘ zuordnen, dann sprechen wir von einem ‚Prozess‘, der durch Akteure — hier Menschen — in einer Abfolge typischer Handlungen ’stattfindet‘.

Def. 2*: Soziotechnisches System

An dieser Stelle des Rekonstruktionsversuchs würde man die Formulierung der Autoren wie folgt ‚um-formulieren‘ können: „… verstehen wir unter einem soziotechnischen System ein komplexes Gefüge bestehend aus Menschen und Hard- und Software, die aufgrund von akzeptierten Zielen so miteinander interagieren können, dass organisationale und soziale Prozesse stattfinden, die zu Änderungen in der bestehenden Umgebung führen können.„

Möglicherweise meinen die Autoren auch, dass die Tatsache, dass eine Gruppe von Menschen aufgrund von festgelegten Zielen längere Zeit in einem bestimmten Format miteinander so interagieren, dass andere dieses Vorgehen ‚in ihrem Innern‘ als ein ‚Prozess‘ erkennen, und diese ‚Wahrnehmung und Interpretation‘ für die ‚Beobachter‘ eine irgendwie geartete ‚Wirkung entfaltet, dass solch eine ‚Wirkung im Innern‘ als ‚Teil einer Interaktion‘ der Beobachter mit dem beobachtbaren Prozess verstanden werden kann. Eine solche Ausweitung der Bedeutung von normalen ‚Wahrnehmungsprozessen‘ zu ‚Interaktionsprozessen‘ würde aber für eine Analyse wenig attraktiv erscheinen.

Der Ausdruck ‚Gefüge‚, den die Autoren benutzen, klingt ein wenig ‚altmodisch‘. Nach mehr als 100 Jahren diverse Strukturwissenschaften sollte man das Wort ‚Gefüge‘ doch vielleicht eher durch den Ausdruck ‚Struktur‚ ersetzen. [18] Eine ‚Struktur‘ liegt vor, wenn man verschiedene Komponenten unterscheiden kann, hier z.B. ‚Menschen‘ und ‚Hard- und Software‘, und diese Komponenten können in Form ‚typischer‘ Handlungen miteinander interagieren, also etwa

SOZIOTECHNISCHES SYSTEM (ST) gdw ST = <Menschen, Hard-/Software, …, Interaktionen, …>

Die Elemente ‚Absicht‘, ‚Ziel‘, ‚inneres Bild von…‘ usw. würden dann in einer eigenständigen Sub-Struktur ‚Mensch‘ oder ‚menschlicher Akteur‘ verortet, da ein Mensch als eine ‚eigenständige Struktur‘ aufgefasst werden kann, etwa:

MENSCH(M) gdw M = <Bilder, Ziele, …, Handlungen, …>

Die beiden Strukturen ST und M würden sogar eine kleine ‚Hierarchie‚ bilden: die Struktur M wäre eingebettet in die Struktur ST.

Offen ist dabei noch, in welchen Sinne ‚Hard- und Software‘ überhaupt interagieren können.

Def 3: Prozesse sozialer Interaktion

sind sich dynamisch ändernde Abfolgen sozialer Aktionen zwischen Individuen und/oder Gruppen.

Die Unklarheit, die durch Def. 2 noch darin gegeben war, als ob ‚organisationale und soziale Prozesse‘ quasi ‚gleichberechtigte‘ Faktoren neben Akteuren, Hard- und Software sind, wird durch Def. 3 aufgehoben. In der Formulierung von Def. 3 sind ‚Prozesse sozialer Interaktion‘ ‚Abfolgen sozialer Aktionen‘, die ‚zwischen Individuen und/oder Gruppen‘ stattfinden, und die sich ‚dynamisch ändern‘ können. Diese Lesart entspricht weitgehend dem Formulierungsvorschlag Def 2*.

Def. 4: Hybridität

Unter ihrer Hybridität schließlich verstehen wir, dass an diesen Prozessen inhärent sowohl maschinelle als auch menschliche Akteure wesentlich beteiligt sind.

Anders formuliert sagen die Autoren, dass ‚Prozesse sozialer Interaktion‘ dann hybrid sind, wenn in solchen Prozessen sowohl ‚maschinelle als auch ‚menschliche Akteure‘ beteiligt sind.

Mit Blick auf die Diskussion zum Ausdruck ‚hybrid‘ im Anschluss an Def. 1 beschränkt sich die Formulierung von Def. 4 zunächst darauf, nur zu fordern, dass im Rahmen von ‚Prozessen sozialer Interaktionen‘ neben dem Akteurstyp ‚Mensch‘ auch der Akteurstyp ‚Maschine‘ vorkommt. Wie solch eine Interaktion aussieht, welche Eigenschaften sie auszeichnen, bleibt hier noch offen. In der vorausgehenden Diskussion war ja schon thematisiert worden, dass menschliche Akteure andere nicht-menschliche Mittel — also auch Maschinen (welche Typen von Maschinen?) — ‚unwesentlich‘ benutzen können. Damit war gemeint, dass man zwar eine programmierbare Maschine (Computer) zum ‚Text schreiben‘ benutzen kann, dass der Computer hier aber keine ‚wesentliche‘ Rolle spielt; er macht das Erstellen von Texten vielleicht ‚einfacher‘, wäre aber generell nicht notwendig.

Den folgenden Text kann man grob als eine Serie von ‚Annahmen‘ über die Wirklichkeit bezeichnen, vermischt mit impliziten Folgerungen, in denen die bisherige Einleitung weiter ausdifferenziert wird.

Ziel der Diskussion bleibt es, zu klären, wie sich das Konzept der ‚kollektiven Mensch:Maschine Intelligenz‘ aus dem oksimo Paradigma zum Konzept der ‚Sozialen Maschine‘ verhält.

ANNAHME-Hybridisierung 1

Die Autoren benennen drei Komponenten ‚Webtechnologie‘ — mit dem Attribut ‚mobil‘ ergänzt –, ‚lernende Bots‘ und ‚KI‘, wodurch „Sozialität und Maschine“ zunehmend verschmelzen. Daraus ziehen sie den Schluss: „Die menschlichen und nichtmenschlichen Komponenten der Social Machine sind folglich immer schwerer voneinander zu unterscheiden und zu trennen, was als paradigmatischer Trend zur fortschreitenden Hybridisierung der Social Machine bezeichnet werden kann“.

Der Kern der Schlussfolgerung fokussiert in der Idee, dass der „Trend zur fortschreitenden Hybridisierung“ offensichtlich sei.

Wenn nach Def. 4 von den Autoren festgehalten wird, dass man unter „Hybridität“ verstehen sollte, „dass an diesen Prozessen inhärent sowohl maschinelle als auch menschliche Akteure wesentlich beteiligt sind“, dann fragt man sich, was man sich unter dem ‚Fortschreiten einer Hybridisierung‘ verstehen soll. Die bloße Vermehrung der ‚Anzahl‘ der beteiligten Faktoren ‚Menschen‘ oder ‚Maschinen‘ kann es wohl nicht sein. Zumindest gibt die Def. 4 dies nicht her.

Die Autoren sprechen vor ihrer Schlussfolgerung davon, dass „Sozialität und Maschine zunehmend verschmelzen„. Dies kann man so interpretieren, dass die ‚fortschreitende Hybridisierung‘ zusammenhängt mit einer ‚Verschmelzung‘ von Sozialität und Maschine. Der Ausdruck ‚verschmelzen‘ wurde von den Autoren zuvor nicht eigens definiert. Die eher sprachliche Deutung von ‚Verschmelzung‘ von Worten scheint nicht gemeint zu sein.[19] Der bedeutungsnahe Ausdruck ‚Fusion‘ bietet eine Vielzahl von Varianten. [20] Welche Variante meinen die Autoren. Dass so ungleiche Wirklichkeiten wie ‚Sozialität‘ und ‚Maschinen‘ ‚verschmelzen‘, dafür fehlt jeglicher Ansatzpunkt einer sinnvollen Interpretation.

Um dieses Dilemma aufzulösen könnte der Ausdruck „… sind folglich immer schwerer voneinander zu unterscheiden und zu trennen …“ einen Hinweis liefern. Wenn man das ‚unterscheiden‘ und ‚trennen‘ nicht auf reale Sachverhalte — wie Sozialität und Maschine — bezieht sondern auf die ‚Verarbeitung von Sinneseindrücken im Innern des Menschen‘, dann könnte man sich eine Interpretation vorstellen, in der durch die Art und Weise, wie Sozialität und Maschine in der Umwelt ‚vorkommen‘, im menschlichen Akteur ‚Vorstellungen‘ auslöst, in denen das menschliche Denken eine klare Unterscheidung immer weniger leisten kann. Dann wäre die angenommene Verschmelzung der Autoren ein rein kognitives/ mentales Problem der menschlichen Akteure, die sich in Interaktion mit einer Umwelt befinden, in der mindestens Menschen und Maschinen vorkommen, aber auf eine Weise, die eine klare Unterscheidung kognitiv/ mental schwer macht.

Dies führt zu folgendem Formulierungsvorschlag:

ANNAHME-Hybridisierung 1 *

Meine Formulierung würde dann lauten: „Menschliche und nichtmenschliche Akteure (hier Maschinen) können in einer Weise in der Umwelt vorkommen, dass es für die beteiligten Menschen in ihren mentalen/ kognitiven Bildern von der Welt immer schwerer wird, diese Akteure klar voneinander zu unterscheiden und zu trennen.„

Zu beachten ist auch, dass die Autoren zu Beginn des Abschnitts von drei unterschiedlichen Komponenten sprechen (‚Webtechnologie‘ — mit dem Attribut ‚mobil‘ ergänzt –, ‚Bots‘ und ‚KI‘), die im Gefolge dann offensichtlich dem Ausdruck ‚Maschine‘ zugeschlagen werden. Der Ausdruck ‚Maschine‘ wurde aber bislang nicht wirklich definiert. Auch sei der Ausdruck ‚Hard- und Software‘ erinnert, der in Def. 2 von den Autoren benutzt wird. Nach den Kontexten gehört dieser auch in das Bedeutungsfeld ‚Maschine‘, so wie es die Autoren praktizieren. Halten wir an dieser Stelle fest:

Def. 5 Maschine (indirekt abgeleitet):

Für die Autoren repräsentieren die Ausdrücke ‚Hard- und Software‘, ‚Webtechnologie (mit Aspekten der ‚Mobilität‘), ‚lernende Bots‘ und ‚KI‘ Aspekte des Bedeutungsfelds ‚Maschine‘, wie es im Kontext der Begriffe ’soziotechnisches System‘ bzw. ‚Soziale Maschine‘ implizit angenommen wird.

In der ‚realen Welt‘ beschreiben die aufgelisteten Ausdrücke (‚Hard- und Software‘, ‚Webtechnologie (mit Aspekten der ‚Mobilität‘), ‚lernende Bots‘ und ‚KI‘ ) ganz unterschiedliche Sachverhalte, deren Verhältnis zueinander keinesfalls trivial ist. Dies sei hier ganz kurz angedeutet:

Webtechnologie, Mobil, Hard- und Software

Der Begriff ‚Webtechnologie‚ ist in sich eher unklar, was mit dem unklaren Begriff ‚Web‚ zusammenhängt. Die englische Wikipedia listet mögliche Bedeutungsvarianten auf und verweist bei ‚web‘ auch auf das ‚World Wide Web [WWW]‘.[21] Die wichtige Botschaft ist [22], dass das WWW nicht das Internet ist, sondern das Internet als Basistechnologie voraussetzt. Das WWW selbst ist eine reine Softwareangelegenheit, wodurch es möglich ist, mittels eines speziellen Adresssystems (URLs) Signale zwischen diesen Adressen hin und her zu schicken. Die Art und Weise, wie dieser Signalaustausch formal stattfinden soll, regelt ein ‚Protokoll‘ (das ‚Hypertext Transfer Protocol‘ [HTTP]; mit zusätzlicher Sicherheit als HTTPS). Auf Seiten der Anwender benötigt man dazu eine Software, die ‚Browser‚ genannt wird, und innerhalb des Internets benötigt man einen Server, auf dem eine Software läuft, die ‚Webserver‚ genannt wird. Die ‚Mobilität‘ des WWW ist keine direkte Eigenschaft des WWW selbst sondern ergibt sich aus veränderten technischen Bedingungen des vorausgesetzten Internets: mobile Endgeräte, auf denen eine Browser Software installiert ist, erlauben eine Kommunikation innerhalb des WWWs.[23] Während das WWW eine reine Software ist, kann man fragen, was denn dann mit ‚Webtechnologie‘ gemeint sein soll? Wenn mit ‚Webtechnologie‘ auch ‚Software‘ gemeint ist, dann wäre der Begriff ‚Technologie‘ stark ausgeweitet. Das ‚Internet‘ — eine spezielle Kombination aus Hardware und Software — wird als ‚Netzwerk von Netzwerken‘ gesehen, innerhalb dessen ganz unterschiedliche Kommunikationsprotokolle am Werk sind, die ganz unterschiedliche Informationsquellen und Dienste ermöglichen. Das WWW ist eine Komponenten unter vielen.[24] Mit ‚Netzwerk‚ ist in diesem Kontext ein ‚Computernetzwerk‚ gemeint. Es besteht aus unterschiedlichen ‚Computern‚, die über geeignete ‚Verbindungen‘ und ‚Verbindungstechnologien‘ miteinander so verknüpft sind, dass Signalpakete entsprechend vereinbarten Protokollen hin und her gesendet werden können. Computer verstehen sich hier immer als Kombinationen aus Hard- und Software.[25] Als umfassender Begriff für die Vielfalt der Technologien und Anwendungen, die durch das ‚Internet‘ möglich sind, gibt es schon sehr früh — zumindest im Englischen Sprachraum — den Begriff ‚Cyberspace‚.[26]

Lernende Bots

Generell gibt es verschiedene Typen von bots. [27] Im allgemeinen ist ein bot im Internet eine Softwareanwendung, die automatisch bestimmte Aufgaben ausführt.[28] Wikipedia selbst benutzt z.B. über 2500 Wikipedia-typische Bots, um die mehr als 54 Mio. Wikipedia-Seiten zu verwalten.[29] Für die Interaktion mit Menschen gibt es u.a. den Typ des ‚Chatbots‘ [30]: die Software eines Chatbots versucht das Verhalten von Menschen anzunähern. Dies gelingt bislang aber nicht wirklich gut.[30] Ein spezielles, aber schon viele Jahre andauerndes Einsatzfeld von künstlicher Intelligenz Techniken sind Computerspiele, in denen ‚Nicht-Spieler Charaktere‘ (’non-player characters‘ [NPCs) das Spielgeschehen anreichern. Diese erledigen sehr vielfältige Aufgaben und sind keineswegs mit einem ‚menschenähnlichen‘ Spielcharakter zu vergleichen.[31] Insgesamt ist der Begriff ‚lernend‘ im Kontext von ‚Bots‘ generell sehr unscharf: einmal, weil der Ausdruck ‚bot‘ nicht einheitlich definiert ist, und zum anderen, weil der Begriff ‚lernend‘ im Kontext von ‚Künstlicher Intelligenz [KI]‘ bzw. ‚Maschinellem Lernen [ML]‘ keinesfalls klar ist. Das Feld ist zu uneinheitlich. [32]

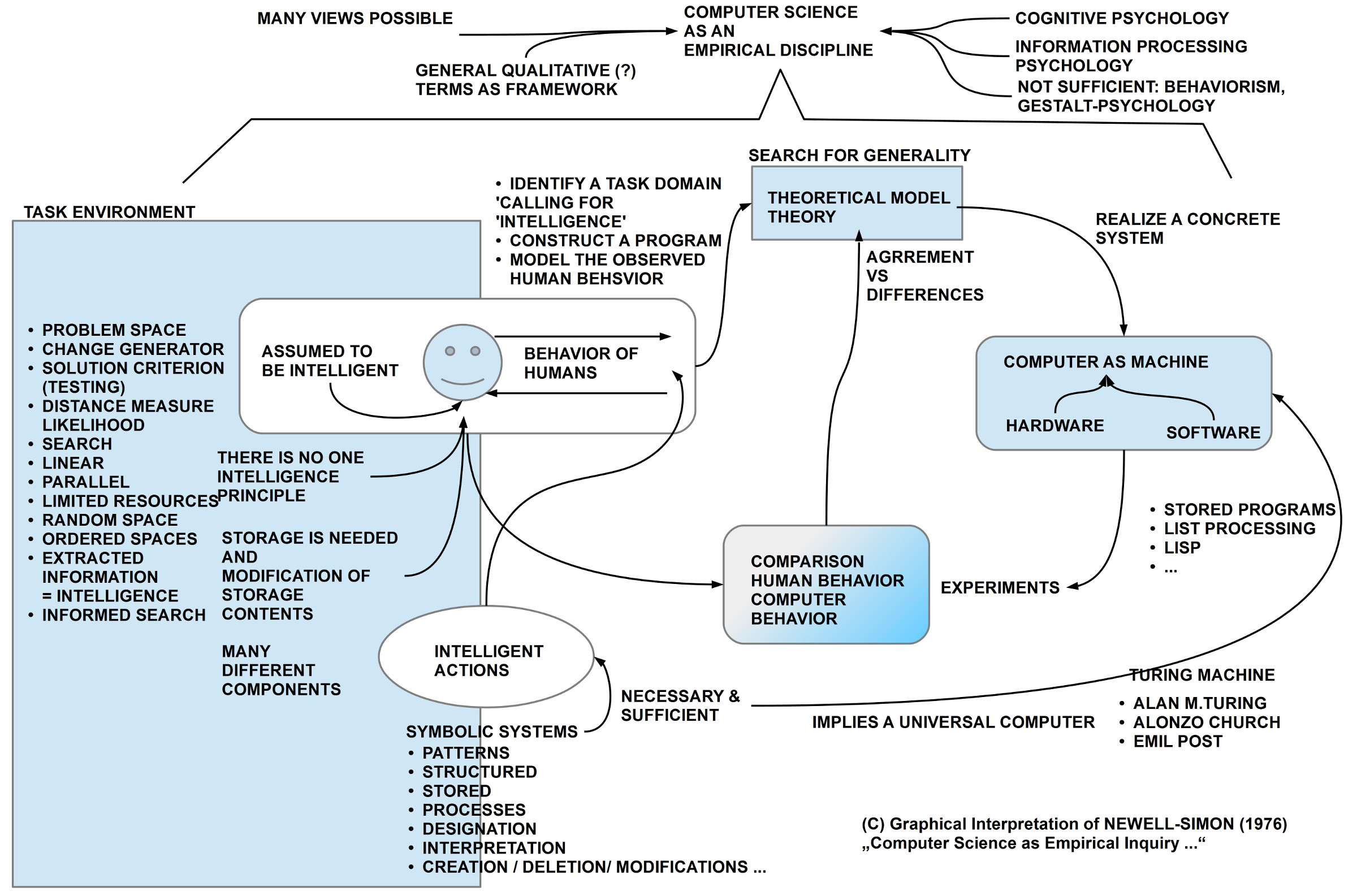

KI (Künstliche Intelligenz)

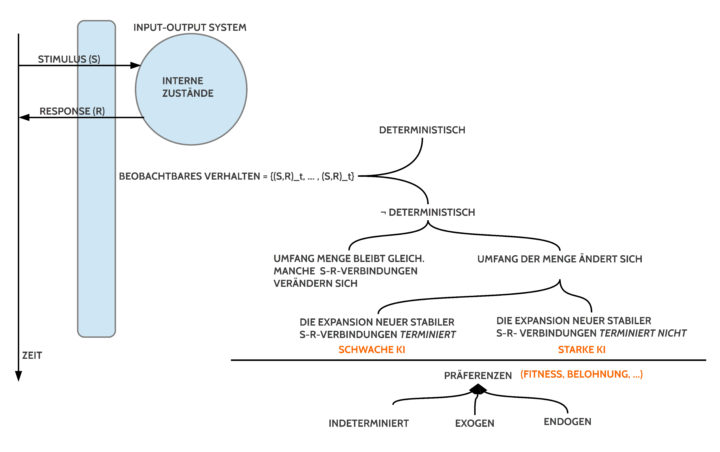

Der Ausdruck ‚KI‘ — Abkürzung für ‚Künstliche Intelligenz‘ (heute oft auch einschränkend ‚ML‘ für maschinelles Lernen) — bezeichnet ein Teilgebiet der Informatik, das bislang keine klare Definition bietet, da schon der Begriff der ‚Intelligenz‘ selbst nicht klar definiert ist.[32], [33] Aufgrund der Unklarheit im Zusammenhang mit dem Begriff der ‚Intelligenz‘ bei biologischen Systemen — obgleich es hier einige Definitionen gibt, die für eingeschränkte Bereiche sehr brauchbar sind — versucht die Englischsprachige Informatik das Problem dadurch zu lösen, dass sie den Begriff AI nur für den Bereich nicht-biologischer Systeme — hier speziell für programmierbare Maschinen — definieren will. Programmierbare Maschinen mit KI können sowohl ihre Umwelt partiell wahrnehmen als auch dann — meist unter Zuhilfenahme systeminterner Zustände — wieder auf die Umwelt reagieren. Zusätzlich wird für solche Systeme mit künstlicher Intelligenz postuliert, dass sie ‚Zielen (‚goals‘) folgen können.[34]

Diese scheinbare Erleichterung, sich vom ursprünglichen Phänomenfeld der Intelligenz bei biologischen Systemen abzukoppeln, weil eine befriedigende Definition von Intelligenz hier schwierig ist, hat aber tatsächlich zu keiner befriedigenden Situation geführt. Sowohl der Intelligenzbegriff eingeschränkt auf programmierbare Maschinen ist heute nicht wirklich klar, noch ist es bislang möglich, zwischen dem Verhalten biologischer und nicht-biologischer Systeme dadurch eine brauchbare Verhältnisbestimmung aufzubauen. Dies führt dann z.T. zu der bizarren Situation, dass spezielle Leistungen von programmierbaren Maschinen für Bereich X, wo Maschinen dem Menschen überlegen sind, als generelle Aussage über das Verhältnis von Maschinen und Menschen benutzt werden, ohne dass man jene Bereiche, in denen biologische Systeme den programmierbaren Maschinen haushoch überlegen sind, überhaupt noch thematisiert. Es ist dem ai100-Report zu verdanken, dass er neu darauf aufmerksam macht, dass es durch diese asymmetrische Diskussion bislang unmöglich ist, genauer zu bestimmen, wie maschinelle Intelligenz der menschlichen Intelligenz konstruktiv unterstützen könnte.[32]

FORTSETZUNG folgt…

ANMERKUNGEN

Hinweis: Wenn in den Anmerkungen Quellen aus dem Internet angegeben werden, dann ergibt sich die Zeit des letzten Aufrufs aus dem Datum der Abfassung dieses Beitrags, die im Kopf des Artikels angegeben ist.

[1] Dazu gibt es einige Beiträge in diesem Philosophie-Jetzt- Blog, und in zwei anderen Blogs uffmm.org mit dem Schwerpunkt ‚Theorie‘ und dem Blog oksimo.org mit dem Schwerpunkt ‚Anwendungen‘.

[2] Claude Draude · Christian Gruhl · Gerrit Hornung · Jonathan Kropf · Jörn Lamla · JanMarco Leimeister · Bernhard Sick · Gerd Stumme , 2021, „Social Machines„, Informatik Spektrum, https://doi.org/10.1007/s00287-021-01421-4, Springer

[3] Social Machine, Wikipedia [EN]: https://en.wikipedia.org/wiki/Social_machine

[4] Berners-Lee, Tim; J. Hendler (2009). „From the Semantic Web to social machines: A research challenge for AI on the World WideWeb“ (PDF). Artificial Intelligence. 174 (2): 156–161. doi:10.1016/j.artint.2009.11.010.

[5] Markus Luczak-Roesch, Ramine Tinati, Kieron O’Hara, Nigel Shadbol, (2015), Socio-technical Computation, CSCW’15 Companion, March 14–18, 2015, Vancouver, BC, Canada. ACM 978-1-4503-2946-0/15/03, http://dx.doi.org/10.1145/2685553.2698991

[6] Luczak-Roesch, M.; Tinati, R.; Shadbolt, N. (2015). When Resources Collide: Towards a Theory of Coincidence in Information Spaces (PDF). WWW 2015 Companion. ACM. pp. 1137–1142. doi:10.1145/2740908.2743973. ISBN9781450334730. S2CID17495801.

[7] Cristianini, Nello; Scantamburlo, Teresa; Ladyman, James (4 October 2021). „The social turn of artificial intelligence“ (PDF). AI & Society: 0. doi:10.1007/s00146-021-01289-8.

[8] Der Begriff ‚machine‘ (Maschine) in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Machine

[9] Der Begriff ‚actor‘ in der Wikipedia [EN] für die Rolle des Schauspielers: https://en.wikipedia.org/wiki/Actor

[10] Der Begriff ‚UML (Unified Modeling Language)‘ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Unified_Modeling_Language

[11] Der Begrifff ‚actor‘ in der Wikipedia [EN] im Rahmen des technischen Standards UML: https://en.wikipedia.org/wiki/Actor_(UML)

[12] Nicht alle Maschinen sind programmierbar, können aber meistens — im Prinzip — nach Bedarf mit programmierbaren Maschinen erweitert werden.

[13] Der Begriff ‚algorithm‘ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Algorithm

[14] Wenn man den Begriff ‚Interaktion‘ auf solche Situationen beschränken würde, in denen ein Homo sapiens Akteur mit einem anderen Akteur (biologisch oder nicht-biologisch) handelt, dann würde es auch Handlungen geben, die keine typische Interaktion mit anderen Akteuren repräsentieren, z.B. wenn ich einen Kaffee oder Tee oder … trinke, oder ich esse einen Apfel, ich fahre mit dem Fahrrad, ….

[15] Der Begriff ‚process‚ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Process

[16] Der Begriff ‚activities‚ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Action_(philosophy)

[17] Im Systems Engineering wird dieser Sachverhalt als ’semantic gap‘ bezeichnet, siehe z.B.: Doeben-Henisch, G., Wagner, M. [2007] Validation within Safety Critical Systems Engineering from a Computation Semiotics Point of View, Proceedings of the IEEE Africon2007 Conference, ISBN 0-7803-8606-X, Paper-ID 701

[18] Der Begriff ‚structure‚ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Structure

[19] Der Ausdruck ‚Verschmelzung‚ in der Wikipedia [DE]: https://de.wikipedia.org/wiki/Verschmelzung_(Grammatik)

[20] Der Ausdruck ‚Fusion‚ in der Wikipedia [DE]: https://de.wikipedia.org/wiki/Fusion

[21] Der Ausdruck ‚web‚ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Web

[22] Der Ausdruck ‚World Wide Web‚ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/World_Wide_Web

[23] Der Ausdruck ‚mobile‚ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Mobile

[24] Der Ausdruck ‚Internet‚ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Internet

[25] Der Ausdruck ‚Computer network‘ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Computer_network

[26] Der Ausdruck ‚cyberspace‚ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Cyberspace

[27] Der Ausdruck ‚bot‚ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Bot

[28] Der Ausdruck ‚Internet bot‘ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Internet_bot

[29] Der Ausdruck ‚bots‚ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Wikipedia:Bots

[30] Der Ausdruck ‚chatbot‚ in der Wikipedia [EN] : https://en.wikipedia.org/wiki/Chatbot

[31] Der Ausdruck ‚Artificial intelligence in video games‚ in der Wikipedia [EN]: https://en.wikipedia.org/wiki/Artificial_intelligence_in_video_games

[32] Michael L. Littman, Ifeoma Ajunwa, Guy Berger, Craig Boutilier, Morgan Currie, Finale Doshi-Velez, Gillian Hadfield, Michael C. Horowitz, Charles Isbell, Hiroaki Kitano, Karen Levy, Terah Lyons, Melanie Mitchell, Julie Shah, Steven Sloman, Shannon Vallor, and Toby Walsh. “Gathering Strength, Gathering Storms: The One Hundred Year Study on Artificial Intelligence (AI100) 2021 Study Panel Report.” Stanford University, Stanford, CA, September

2021. Doc: http://ai100.stanford.edu/2021-report. Report: https://ai100.stanford.edu/sites/g/files/sbiybj18871/files/media/file/AI100Report_MT_10.pdf

[33] Der Ausdruck ‚KI (Künstliche Intelligenz)‚ — auch ‚ML (Maschinelles Lernen)‘ in der Wikipedia [DE] : https://de.wikipedia.org/wiki/K%C3%BCnstliche_Intelligenz

[34] Der Ausdruck ‚Artificial intelligence [AI]‘ in der Wikipedia [EN] : https://en.wikipedia.org/wiki/Artificial_intelligence

DER AUTOR

Einen Überblick über alle Beiträge von Autor cagent nach Titeln findet sich HIER.